- 1Git常用命令:git stash 暂存,代码草稿本(持续更新中)_git暂存代码

- 2基于STM32的SYN6288语音播报模块驱动实验(代码开源)_syn6288语音模块_基于stm32的语音播报模块

- 3java的tcp实时接收json格式报文_tcp - 如何使用带有rsocket Java的TcpClientTransport将自定义数据格式转换为JSON - 堆栈内存溢出...

- 4SAP常用TCODE_sap tcode 功能对照表

- 5数据治理CDGA证书含金量为什么这么高?_cdga0

- 6hadoop之hdfs与yarn界面功能介绍_hdfs原生界面overview

- 7openGauss数据库源码解析系列文章——AI技术(2.1)_opengauss源码分析

- 8ChatGPT流式输出实现原理

- 9安卓Clean Architecture:实现模块化与可测试性的软件设计方法

- 10【Python+百度API】 文本情感倾向分析_百度情感分析api

AIGC之图像生成内容介绍_aigc图文一致性

赞

踩

AIGC(Artificial Intelligence Generated Content)是一种基于人工智能技术生成内容的方法,它在图像生成领域有广泛的应用。图像生成是指通过计算机算法和模型生成新的图像,这些图像可能是完全虚构的、艺术创作的、或者是根据现有图像进行修改和增强的。下图的人物则是由图像生成技术生成的假人脸,也就是世界上完全不存在的人脸。

一、技术发展方向介绍

人工智能生成图像的技术方向主要包括基于规则、基于生成对抗网络(GANs)、基于变分自编码器(VAEs)、扩散过程生成模型(diffusion)等几个方面。

1. 流模型(Flow)

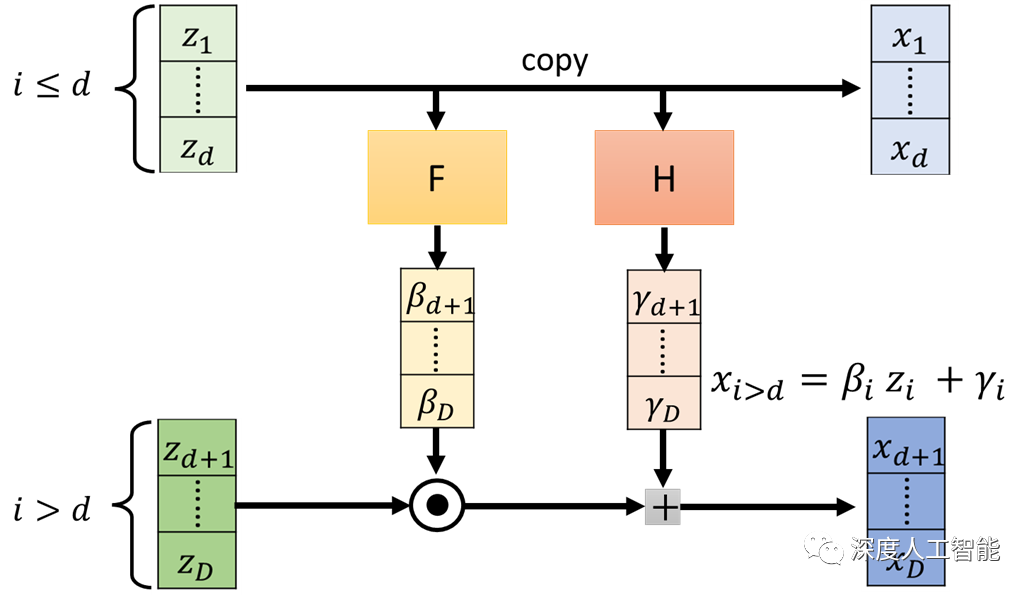

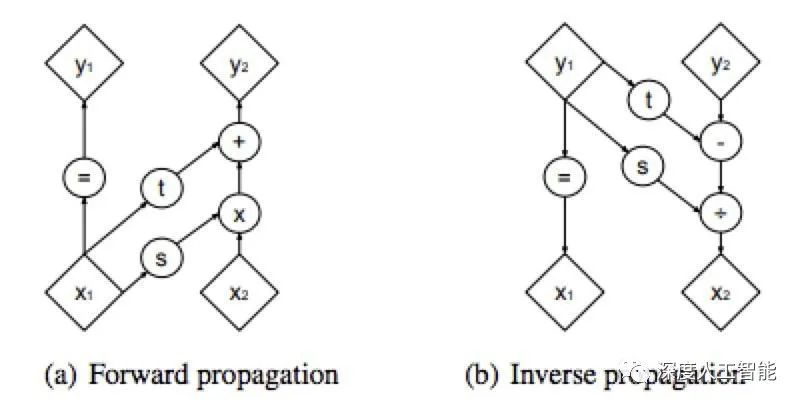

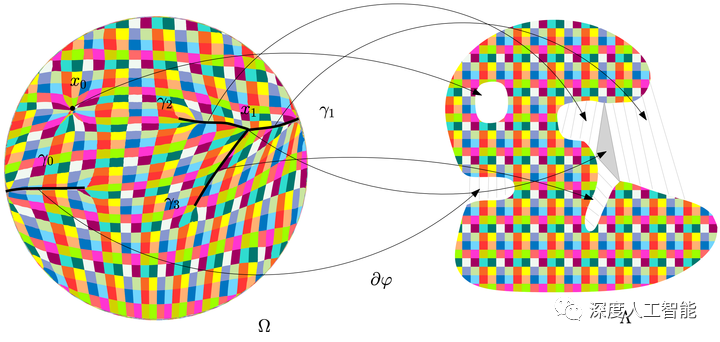

Flow模型是一种用于建模概率分布和生成样本的生成模型。它通过定义一系列可逆的变换来实现从一个已知分布(例如高斯分布)到目标分布的映射。

在Flow模型中,生成过程是通过将输入样本通过一系列可逆变换来生成目标样本。每个可逆变换包含一个前向传播函数和一个反向传播函数。前向传播函数将输入样本映射到另一个空间,而反向传播函数将映射后的样本逆向映射回原始空间。这样,通过连续应用多个可逆变换,就可以逐步地将输入样本映射到目标分布中,从而实现样本的生成。

2. 生成对抗网络(GANs)

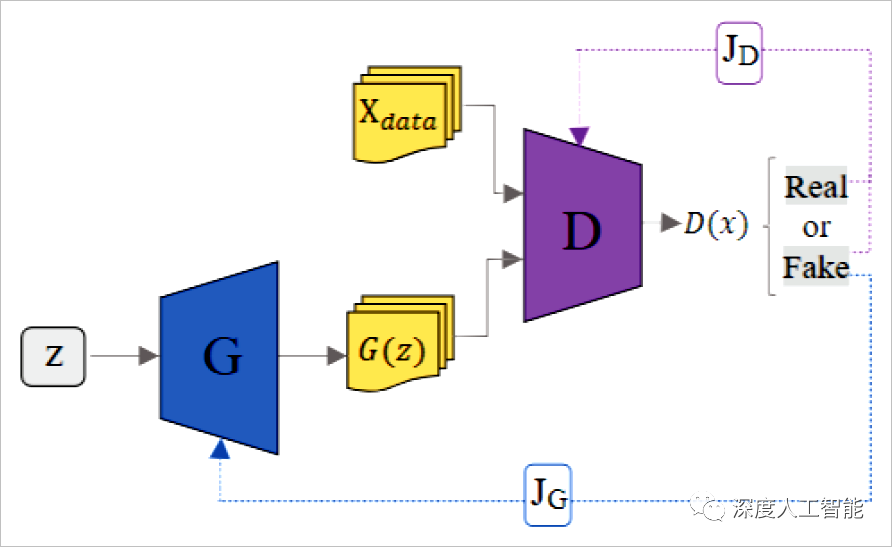

GAN是一种深度学习模型,它由一个生成器和一个判别器组成。其中,生成器的目标是生成逼真的图像,而判别器的目标是尽可能准确地判断真实图像和生成图像。生成器和判别器在对抗的过程中不断优化自身,最终达到一个平衡状态,生成器能够生成逼真的图像。

GAN最常见的应用是图像生成,尤其是生成逼真的人脸图像。例如,StyleGAN是一种GAN的改进版本,它可以生成高质量、多样化的人脸图像。StyleGAN在游戏、虚拟现实、电影等领域得到了广泛的应用。

3. 变分自编码器(VAEs)

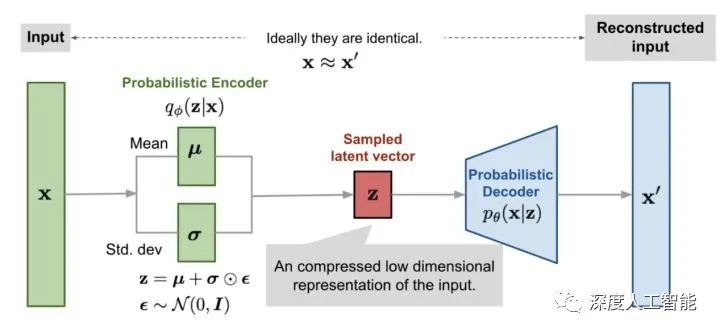

VAE(Variational Autoencoder)是一种无监督学习算法,主要用于数据降维、生成和重建。VAE是由自编码器(Autoencoder)发展而来的一种概率生成模型,使用了向量空间中的方法对数据进行建模,旨在学习数据分布的潜在维度,并使用这些维度生成新的样本数据。

在VAE的基础上,还有一些变种模型,例如Conditional VAE(CVAE),用于针对特定条件或标签进行数据生成;Disentangled VAE(D-VAE),用于学习数据表示的潜在因素,并将其隔离以实现更加有效和可解释的数据生成。

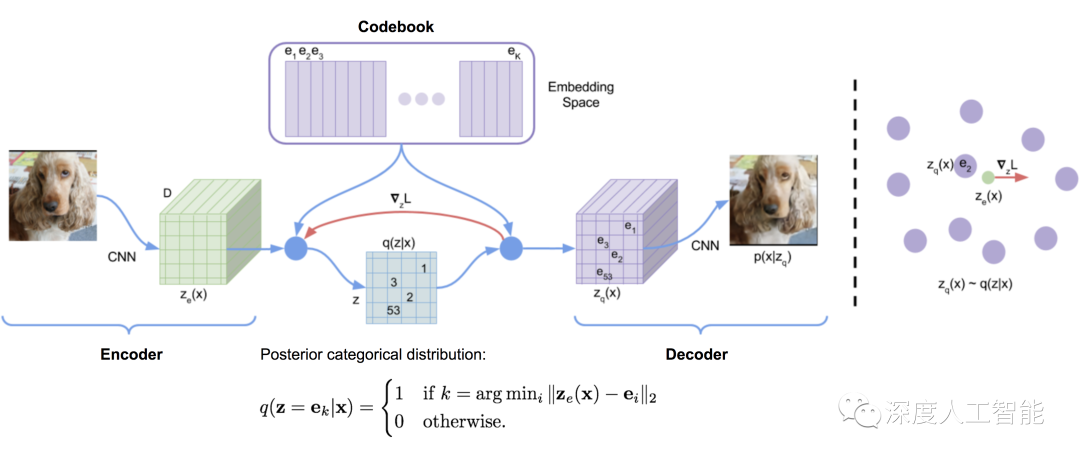

以及可以将向量量化处理的VQVAE模型,它是一种将向量量化引入VAE进行改进的变种模型,主要用于图像、视频等数据的压缩和生成。它的基本原理是将输入数据分成若干个抽象的离散化表示,并在这些表示中学习数据的结构,从而真正地实现数据的压缩和重构。

4. 扩散生成模型(diffusion)

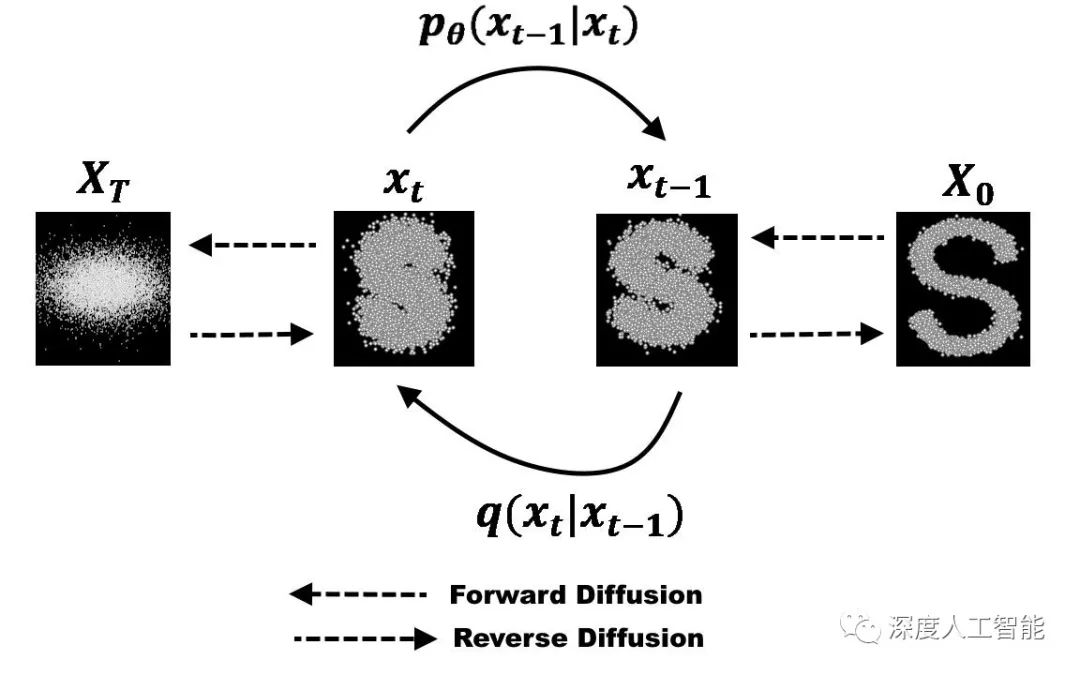

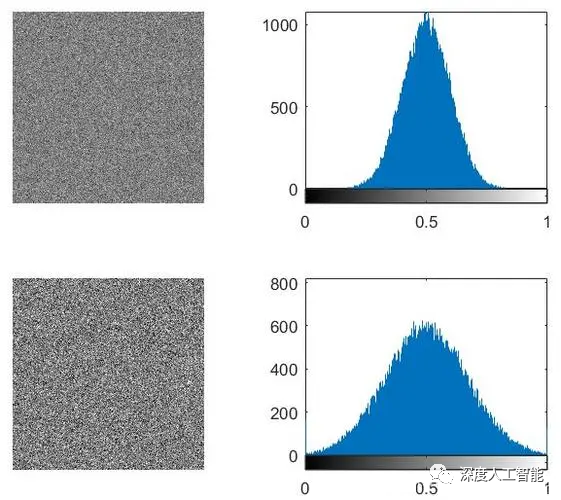

扩散过程生成模型是一种生成模型,它可以模拟随机过程,从而生成高质量的图像。该模型使用了一个反向扩散方程,通过多次迭代来生成图像。每次迭代,图像中的每个像素都会扩散一些噪声,并在下一次迭代中逐渐消失。

扩散过程生成模型最常见的应用是图像生成和修复。例如,DDIM是一种基于扩散过程生成模型的图像生成方法,它可以生成高质量的自然图像。另一个例子是Noise2Self,它使用扩散过程生成模型来恢复噪声图像。

各个技术方向之间各有优缺点,基于Flow的生成模型由于生成过程可逆,生成样本的速度较快,但是计算复杂度高,有很多约束限制。GANs生成的图像逼真度高,但是有可能存在模式崩溃等问题。VAEs生成的图像通常更加平滑,但是可控性较弱。Diffusion模型则可以用于图像生成和修复,也可以解决某些噪声图像的恢复问题。它的优点在于可以生成高质量的图像,并且具有良好的图像重建能力。但其缺点在于迭代次数较多,计算成本较高,且需要精细调参。

二、应用场景和技术变种

AIGC在图像生成领域中能够模拟和学习现实世界中的图像特征,并生成逼真、具有创造性的图像内容。比如:

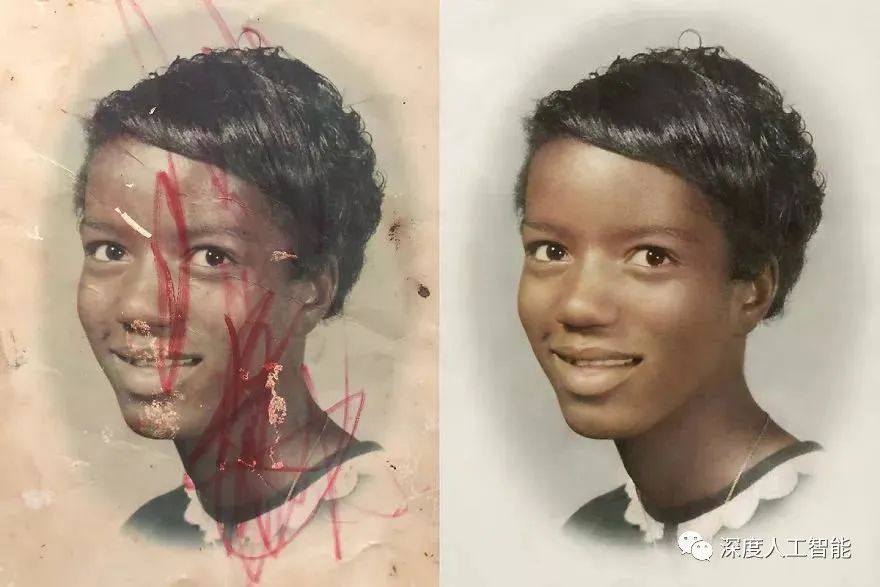

1. 图像修复和增强:AIGC可以根据输入的图像,自动修复或增强图像的质量。它可以修复损坏的图像、去除噪声、调整亮度和对比度、改变颜色等,使图像看起来更加清晰和美观。

2. 艺术创作和风格转换:AIGC可以通过学习艺术作品的风格和特征,生成新的艺术创作。它可以将一幅图像转换成具有不同艺术风格的图像,例如将一张照片转换成油画风格或印象派风格的图像。

3. 图像生成和合成:AIGC可以生成完全虚构的图像,包括人物、风景、物体等。它可以生成逼真的人脸图像、虚拟场景、角色设计等,为游戏、电影和虚拟现实等领域提供内容生成的解决方案。

4. 图像编辑和转换:AIGC可以通过修改图像的特定属性或进行内容转换,实现图像编辑的功能。例如,它可以将一张夏季风景的图像转换成冬季风景,或者将一张人物照片中的发型和服装进行修改。

AIGC在图像生成方向不仅可以用于实现图像修复和增强,还可以创造出新颖的艺术作品、生成逼真的虚拟图像,以及进行图像编辑和转换,为各种领域提供了丰富多样的内容生成能力。

AI生成图像的技术方向包括Flow、GAN、VAE和Diffusion生成模型等。每种技术都有其特定的应用场景和优缺点。选择适当的技术需要根据实际应用情况进行综合考虑。

选择适当的AI生成图像技术需要结合具体应用场景和实际需求进行综合考虑。以下是对每种技术变种的简要分析和举例说明:

1、Flow模型:它是通过学习数据的概率密度函数来进行样本生成和概率推断。虽然原始的Flow模型是基于可逆变换的,但在实际应用中,有一些变种和改进的Flow模型出现。以下是一些常见的Flow模型的变种和应用:

- Real NVP (Real-valued Non-Volume Preserving): Real NVP是Flow模型的一种变种,它使用了可逆变换,并且特别适用于处理实值数据。它通过将输入分为两个子集,其中一个子集用于参数化变换,另一个子集用于选择变换的应用位置。Real NVP在图像生成、图像重建和密度估计等任务中表现出色。

- Glow (Generative Flow with Invertible 1x1 Convolutions): Glow是一种基于可逆1x1卷积的Flow模型,它在Real NVP的基础上进一步改进。它使用了可逆1x1卷积层来增加模型的表达能力,并且能够处理更大尺寸的图像。Glow在高分辨率图像生成和图像生成任务中具有出色的性能。

- Neural Autoregressive Flow (NAF): NAF是一种基于神经网络自回归模型和Flow模型的结合,它利用自回归模型的顺序生成特性来定义可逆变换。NAF使用逐步生成的方式,每一步都通过神经网络生成一个随机变量,并将其与先前的随机变量组合成下一步的输入。NAF在图像生成、文本生成和序列建模等任务中具有应用潜力。

- Variational Inference with Normalizing Flows (VINF): VINF是将Flow模型与变分推断相结合的方法,用于近似后验分布的推断。它使用Flow模型来定义一个可逆变换,将先验分布变换为近似的后验分布。VINF在概率推断、生成模型和变分自编码器等领域中具有应用潜力。

2、GAN(Generative Adversarial Network):它是由生成器网络和判别器网络组成,通过对抗训练的方式实现生成样本的能力。除了传统的GAN模型外,还有一些变种和扩展的模型,以及各种应用场景。以下是一些常见的GAN模型的变种和应用:

- Conditional GAN (CGAN): CGAN是对标准GAN的扩展,它引入了条件信息,使模型能够生成特定条件下的样本。这在生成有条件的图像、文本生成和图像编辑等任务中非常有用。

- Wasserstein GAN (WGAN): WGAN是对GAN的改进,通过引入Wasserstein距离来替代原始GAN的JS散度,解决了GAN训练过程中的训练不稳定和模式崩溃等问题。WGAN在生成高质量样本和训练稳定性方面表现出色。

- CycleGAN: CycleGAN是一种用于图像转换的GAN模型,它可以在两个不同领域之间进行无监督的图像转换。它通过引入循环一致性损失来实现图像的转换,例如将马转换成斑马、将夏季景色转换成冬季景色等。

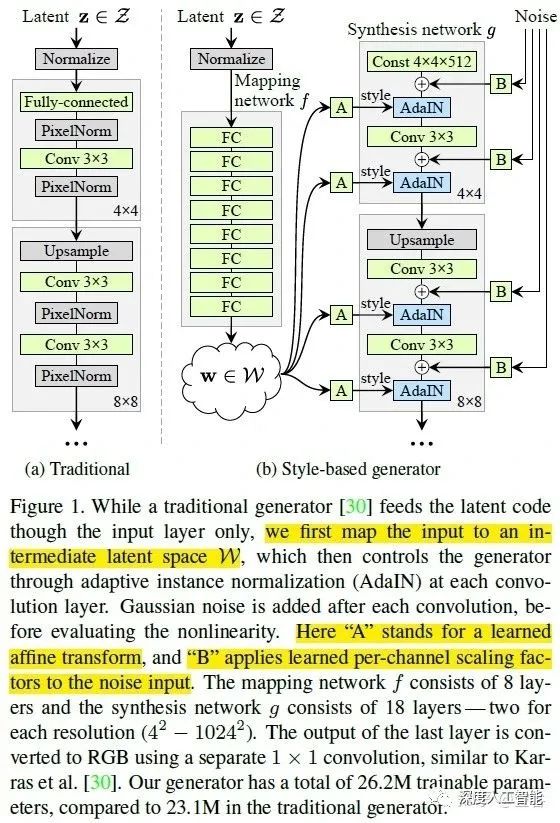

- StyleGAN: StyleGAN是一种用于生成逼真图像的GAN模型,它引入了Style-Based Generator架构,使得生成的图像具有高度的逼真性和可控的样式特征。StyleGAN在图像生成、图像编辑和人脸合成等任务中取得了显著的成果。

- ProgressiveGAN: ProgressiveGAN是一种渐进式训练的GAN模型,它通过逐渐增加生成器和判别器的复杂性来提高模型的稳定性和生成质量。它在生成高分辨率图像和细节保留方面具有优势。

3、VAE(Variational Autoencoder):它结合了自动编码器和变分推断的思想。除了传统的VAE模型外,还有一些变种和扩展的模型,以及各种应用场景。以下是一些常见的VAE模型的变种和应用:

- Conditional VAE (CVAE): CVAE是对标准VAE的扩展,它引入了条件信息,使模型能够根据给定条件生成特定类别的样本。这在生成有条件的图像、文本生成和图像修复等任务中非常有用。

- β-VAE (Beta-VAE): β-VAE是对标准VAE的改进,通过调整重构误差和KL散度之间的权重参数β,可以控制潜在表示的连续性和独立性。β-VAE在学习可解释的表示和对抗因果关系等任务中具有应用潜力。

- VQ-VAE (Vector Quantized VAE): VQ-VAE通过使用离散的潜在表示,即向量量化(Vector Quantization),来改进VAE的生成质量和表示能力。它在图像生成、音频合成和自监督学习等领域中表现出色。

- Adversarial Variational Bayes (AVB): AVB是将GAN的思想与VAE相结合的模型。它引入了判别器网络来评估潜在表示的质量,并通过对抗训练提高生成样本的质量。AVB在生成高质量样本和潜在表示学习中具有应用潜力。

- Disentangled Variational Autoencoder (DVAE): DVAE旨在学习具有解释性和可控因素的潜在表示。它通过引入额外的正则化项或特定的模型结构来促进潜在表示的分离和可解释性。DVAE在因果推理、图像编辑和生成可控样本等任务中具有应用价值。

4、Diffusion模型:它通过逐步迭代地添加噪声来生成样本。在实际应用中,一些变种和改进的Diffusion模型被提出。以下是一些常见的Diffusion模型的变种和应用:

- Denoising Diffusion Probabilistic Models (DDPM): DDPM是Diffusion模型的一种变种,它利用迭代添加噪声的方式来建模数据的概率分布。DDPM引入了一组噪声水平,每个水平对应一个迭代步骤,通过最小化噪声后样本与真实样本之间的误差来训练模型。DDPM在图像生成、图像修复和图像去噪等任务中取得了良好的效果。

- Score-Based Diffusion Models: Score-Based Diffusion Models是一类基于梯度的Diffusion模型,它们通过估计数据分布的梯度来进行样本生成。这些模型利用梯度的信息来指导噪声的添加过程,从而生成更高质量的样本。Score-Based Diffusion Models在图像生成和图像修复等任务中具有应用潜力。

- Continuous-Time Diffusion Models: Continuous-Time Diffusion Models是一种对Diffusion模型的改进,它引入了连续时间的概念,使模型能够在连续时间下进行样本生成。这种模型将噪声逐渐添加到样本中,并通过最小化噪声后样本与真实样本之间的差异来训练模型。Continuous-Time Diffusion Models在图像生成和样本插值等任务中表现出色。

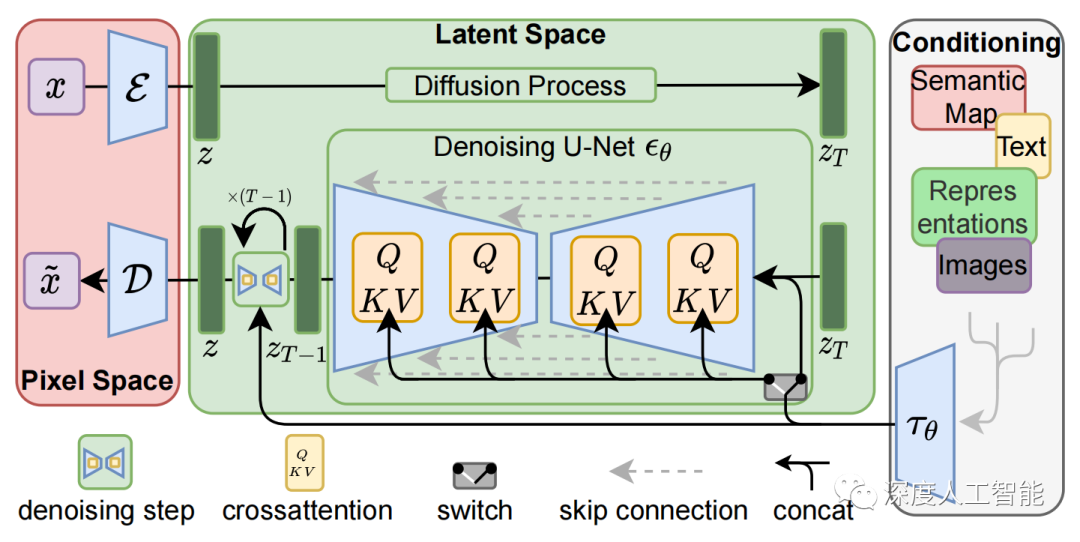

- Latent Diffusion Models: Latent Diffusion Models是一种将Diffusion模型与潜在空间建模相结合的方法。它在潜在空间中建模样本的分布,并通过将噪声逐渐添加到潜在变量中来生成样本。Latent Diffusion Models在生成高质量样本和潜在表示学习等任务中具有潜力。

综合来看,各种生成图像的技术都有自己的优点和局限性,在不同的应用场景中需要选择适合的技术。Flow模型适用于图像生成和合成,特别是在高分辨率图像的生成和动态图像合成等领域具有较好的性能。GAN模型广泛应用于图像生成、图像编辑和增强等领域,例如风格迁移、图像修复、超分辨率图像生成等。VAE模型主要应用于图像重建和特征学习等任务,例如图像去噪、压缩和生成等。Diffusion模型则适用于高质量图像生成和修复,特别是对复杂图像的生成和重建具有较好的性能。不同的模型具有不同的优势和适用范围,根据任务需求和数据特点选择合适的模型可取得更好的效果。

值得一提的是,在实际应用案例和产品的研发过程中,所使用的技术可能不止一种,经常会将多种成熟的技术进行联合使用,从而使得最终呈现出的结果达到更加令人满意的效果。下面以当下比较热门的几个图像生产类产品应用为例介绍其所使用的技术:

1、DALL-E:它使用了两种关键技术:Transformer和自动编码器。

- Transformer:Transformer是一种基于自注意力机制的神经网络架构,它在自然语言处理任务中取得了巨大的成功。DALL-E将Transformer模型扩展到图像生成领域,使其能够处理和生成图像数据。Transformer的自注意力机制能够对输入图像中的不同位置进行建模,捕捉全局上下文信息,并生成逼真的图像。

- 自动编码器:DALL-E使用了一种变种的自动编码器,称为VAE(Variational Autoencoder)。VAE由编码器和解码器组成,编码器将输入图像编码为潜在向量表示,解码器将潜在向量解码为生成的图像。VAE在图像生成中具有重要作用,它能够学习数据的潜在表示,并通过解码器生成具有多样性的图像样本。

通过结合Transformer的全局建模能力和VAE的潜在表示学习能力,DALL-E能够生成高质量且多样化的图像。它可以接收文本描述作为输入,并生成与描述相匹配的图像,展示了在图像生成领域中的创新应用。

2、Stable Diffusion: 它是一个使用高斯噪声进行图像生成的 AI 画图项目,其主要使用了以下三种技术:

- 高斯噪声生成技术:Stable Diffusion 使用高斯分布的随机数来生成高斯噪声,这些随机数通过一个叫做 Gaussian Process 的过程进行建模和调整,以确保噪声具有合适的统计特性,同时也能够保持一定的复杂性和随机性。

- 迭代扩散算法:Stable Diffusion 采用了一种名为 Diffusion Tensor Imaging (DTI) 的算法,该算法基于流体力学中的迭代扩散原理,通过对高斯噪声进行多次迭代的传输和适应,生成具有真实感和细节的图像。

- DSTD深度学习模型:Stable Diffusion 还使用了一种名为 Deep Stable Diffusion (DSTD) 的深度学习模型,该模型结合了神经网络和 stable diffusion 算法,能够自动学习和调整噪声的统计特性,从而生成更加真实和细致的图像。

Stable Diffusion 项目主要使用了高斯噪声生成技术、迭代扩散算法和深度学习模型等三种技术,通过相互作用和协同,生成具有真实感、细节和动态效果的图像。

3、Midjourney:它使用了图像识别、生成对抗网络(GAN)等技术,具体如下:

- 图像识别技术:Midjourney 通过使用深度学习技术中的图像识别技术,如卷积神经网络(CNN)和生成对抗网络(GAN)等,来识别输入的图像。这些技术可以帮助 Midjourney 理解用户输入的图像内容,并将其转化为可视化的作品。

- 生成对抗网络(GAN)技术:Midjourney 使用了生成对抗网络(GAN)技术来生成新的图像。GAN 是一种无监督学习方法,它可以从一组无标签数据中学习出一组标签数据,从而生成与训练数据类似的新数据。在 Midjourney 中,GAN 被用于生成与用户输入的图像风格相似的新图像。

- 图像风格迁移技术:Midjourney 还使用了图像风格迁移技术来将某种艺术风格应用到生成的作品中。这种技术可以帮助 Midjourney 快速生成具有指定艺术风格的作品,并且生成的作品与原始输入的图像具有相似的外观和情感。

Midjourney 在其生成的作品中综合运用了多种技术,如图像识别、生成对抗网络、图像风格迁移等,从而实现了高质量、高真实感的绘画效果。

三、不同技术的优缺点和改进方向

不同的技术有其不同的优缺点,下面将分别介绍Flow(流模型)、GAN(生成对抗网络)、VAE(变分自编码器)和Diffusion(扩散模型)这四种不同生成技术的优缺点和改进方向。

1.Flow模型

优点:

- 真实概率密度建模:Flow模型能够对复杂的概率分布进行建模,包括多峰分布和高维分布。它可以准确地估计样本的概率密度,并提供精确的概率计算。

- 可逆性和精确推断:Flow模型的生成过程是可逆的,可以精确地计算样本的对数似然和梯度。这使得模型的训练和推断过程更加稳定和高效。

- 生成速度较快:由于生成过程是通过一系列可逆变换进行的,Flow模型在生成样本时可以快速进行,不需要迭代采样或优化过程。

缺点:

- 高计算复杂度:每个可逆变换都需要计算其雅可比矩阵的行列式,这可能导致计算复杂度较高,尤其对于大规模和高维数据。

- 建模能力受限:对于高维数据,Flow模型的建模能力可能受到限制。设计复杂的变换和模型结构以适应高维数据仍然是一个挑战。

- 可逆性约束限制:Flow模型的可逆性约束对变换的选择和设计产生一定的限制,可能影响生成样本的质量和多样性。

改进方向:

- 提高计算效率:改进Flow模型的计算效率是一个重要的方向。可以通过减少变换层数、设计更高效的变换结构或引入近似推断方法来降低计算复杂度。

- 处理高维数据:改进Flow模型的建模能力,使其能够更好地处理高维数据。可以探索更复杂的变换结构、引入注意力机制或结合其他生成模型的思想,如GAN和自编码器。

- 改善生成质量和多样性:改进Flow模型的生成质量和多样性是一个重要的目标。可以通过设计更复杂的变换和模型结构、引入噪声或探索不同的训练策略来提高生成样本的质量和多样性。

- 扩展到序列和图结构数据:Flow模型在序列和图结构数据上的应用还有待发展。可以探索适应序列和图结构数据的变换和模型结构,以扩展Flow模型在这些领域的应用。

2. 生成对抗网络(GAN):

优点:

- GAN 能够生成逼真的图像,通过训练生成器和判别器之间的博弈过程,生成器可以学习生成与真实图像相似的样本。

- GAN 的生成过程是无监督的,不需要对输入数据进行标记或类别信息,因此适用于无监督学习任务。

- GAN 可以生成多样化的图像样本,不仅能够生成真实图像,还能生成新颖的艺术作品。

缺点:

- GAN 的训练过程相对不稳定,生成器和判别器之间的平衡很容易打破,可能导致模式崩溃或模式坍塌的问题。

- GAN 的训练通常需要较长时间和大量的数据集,而且对超参数的选择和调整非常敏感。

- GAN 生成的图像可能存在一些不真实或模糊的细节,尤其在细节丰富的图像生成上仍有改进空间。

改进方向:

- GAN 的稳定性和收敛性仍是改进的热点,研究人员提出了各种改进的GAN变体,如WGAN、LSGAN等,来解决训练不稳定的问题。

- 提出了条件GAN(cGAN)来引入条件信息,使生成器能够控制生成特定类别的图像。

- GAN的生成结果仍存在模糊和细节不足的问题,改进方向包括增加网络层数、引入注意力机制以及融合其他模型,如自编码器。

3. 变分自编码器(VAE):

优点:

- VAE 是一种生成模型,能够学习输入数据的潜在分布,可以生成具有一定连续性的新样本。

- VAE 提供了一个潜在空间(latent space),可以对样本进行插值和重构,具有较强的可解释性。

- VAE 训练相对稳定,使用变分推断和重参数化技巧,可以通过最大化下界来有效地学习模型参数。

缺点:

- 潜在空间的连续性:VAE假设潜在空间是连续且均匀分布的,但实际上这并不一定成立。潜在空间的连续性假设可能限制了模型对真实数据分布的准确建模能力,尤其是在存在离散性或复杂分布的数据情况下。

- 潜在空间的信息损失:VAE通过最大化概率下界(ELBO)来训练模型,这可能导致潜在空间中的信息损失。ELBO包含了重构误差和KL散度项,当KL散度项过大时,会强制潜在变量服从先验分布,但可能会丢失一些有用的信息。

- 先验分布的假设:VAE假设潜在变量服从先验分布,通常是高斯分布或均匀分布。然而,在某些情况下,这种假设可能不合适,导致对数据分布的建模不准确。

改进方向:

- 改进潜在空间表示:为了提高潜在空间的连续性和表示能力,一些方法引入了更复杂的潜在分布,例如使用流模型(如Flow-based models)或非参数方法(如Variational Inference with Normalizing Flows)。这些方法可以更好地捕捉数据分布的复杂性,并提供更丰富的潜在表示。

- 引入非均匀分布的先验:除了传统的均匀或高斯先验分布,一些方法尝试引入非均匀分布的先验,例如使用更复杂的分布(如混合分布)或通过学习先验分布的参数。这样可以更好地对数据分布进行建模,并在潜在空间中提供更多的灵活性。

- 改进训练过程:一些改进方法着重于改进VAE的训练过程,以减轻信息损失问题。这包括使用更复杂的优化算法(如使用重要性采样)或设计更适合数据分布的损失函数(如使用自适应权重的重构损失)。此外,一些方法结合了对抗训练(GAN)和VAE的思想,以更好地平衡重构和采样能力。

4. 扩散模型(Diffusion Model):

优点:

- 生成高质量样本:Diffusion模型在生成样本方面表现出色,能够生成逼真、高质量的图像或数据样本。

- 灵活的生成过程:Diffusion模型的生成过程是可控的,可以通过调整噪声的扩散步骤来控制生成图像的质量和清晰度。

- 保留全局一致性:Diffusion模型在生成过程中保持全局一致性,即生成的样本在整体上保持一致,不会出现片段或局部不协调的情况。

- 对潜在分布的建模:Diffusion模型可以通过逆向推导的方式,从数据样本反向推断潜在分布,从而对数据的潜在结构进行建模。

缺点:

- 计算复杂度高:Diffusion模型的训练和推断过程通常比较复杂和耗时,特别是在处理大规模数据集时。

- 难以调优参数:Diffusion模型的参数调优相对困难,需要仔细选择合适的学习率、步长和迭代次数等参数。

- 受噪声累积影响:由于Diffusion模型是通过迭代地扩散噪声来生成样本,噪声的累积可能导致生成样本质量的下降。

改进方向:

- 加速和优化训练过程:针对Diffusion模型的计算复杂度,可以采用一些加速和优化方法,如并行计算、模型参数的初始化策略和优化算法的改进等。

- 增强模型的稳定性:为了提高模型的稳定性,可以使用正则化技术,如权重衰减或批次标准化,以减少训练过程中的不稳定性和模型的过拟合。

- 结合其他生成模型:将Diffusion模型与其他生成模型结合,如GAN、VAE等,以获得更好的生成效果和模型性能。

- 网络架构改进:改进Diffusion模型的网络架构,如增加层数、引入注意力机制或增加残差连接等,以提高模型的表示能力和生成质量。

- 引入先验分布:通过引入适当的先验分布,可以改善Diffusion模型对数据分布的建模效果,进而提高生成样本的多样性和质量。

针对Flow、GAN、VAE和Diffusion模型等不同方向的生成技术,研究者们在改进方向上持续努力。未来的发展方向包括改进稳定性、增加生成样本质量、提高模型的建模能力以及加快训练和生成速度,以更好地应对实际应用中的需求。

想要了解更多关于AIGC技术在各领域的应用,请关注我们,下一期我们将对AICG在语音领域的应用和技术进行介绍。