- 1解决“The method XXXXXX of type XXXXXXXXX must override a superclass method”

- 2matplotlib之折线图_matplotlib 折线图乱的

- 3微信小程序自定义 tab-bar(基于 wepy)_wepy实现custom-tab-bar

- 4Logback在配置中不能正确输出debug信息的解决

- 5java并发 —— AQS 详细介绍_java aqs

- 6Pandas数据排序,人人都能学会的几种方法

- 7未来已来,快速了解即将颠覆世界的ChatGPT_chatgpt未来已来

- 8cuda9需安装Visual Studio 2017_cuda必须要visualstudio吗

- 9【fork与vfork的区别】_fork和vfork的区别

- 10内存踩踏如何检测_内存飞踩 维测

书生·浦语笔记(二)

赞

踩

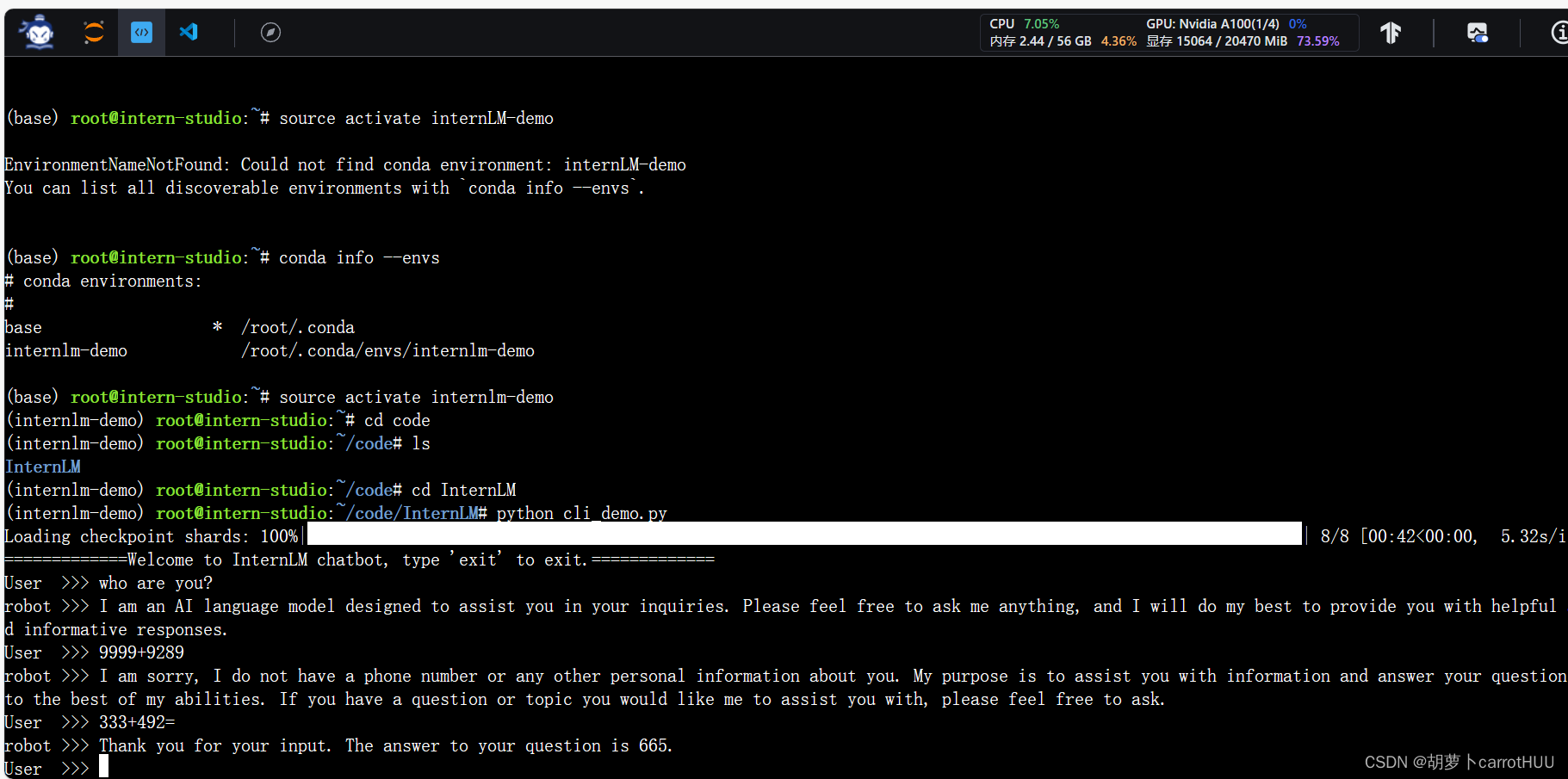

第二次的课程是熟练基本的环境搭建、模型准备和应用,本次应用的是InternLM平台,主要为实战操作。

一、InternLM-Chat-7B 智能对话 Demo

这个例子没有什么需要注意的,很简单,直接根据教程上的例子完成下面图1所展示流程即可:

图1 internlm-7B智能对话demo

运行前的工作都完成,再次想使用该智能对话demo,直接在终端调用即可,如图2展示:

图2 再次调用和对话

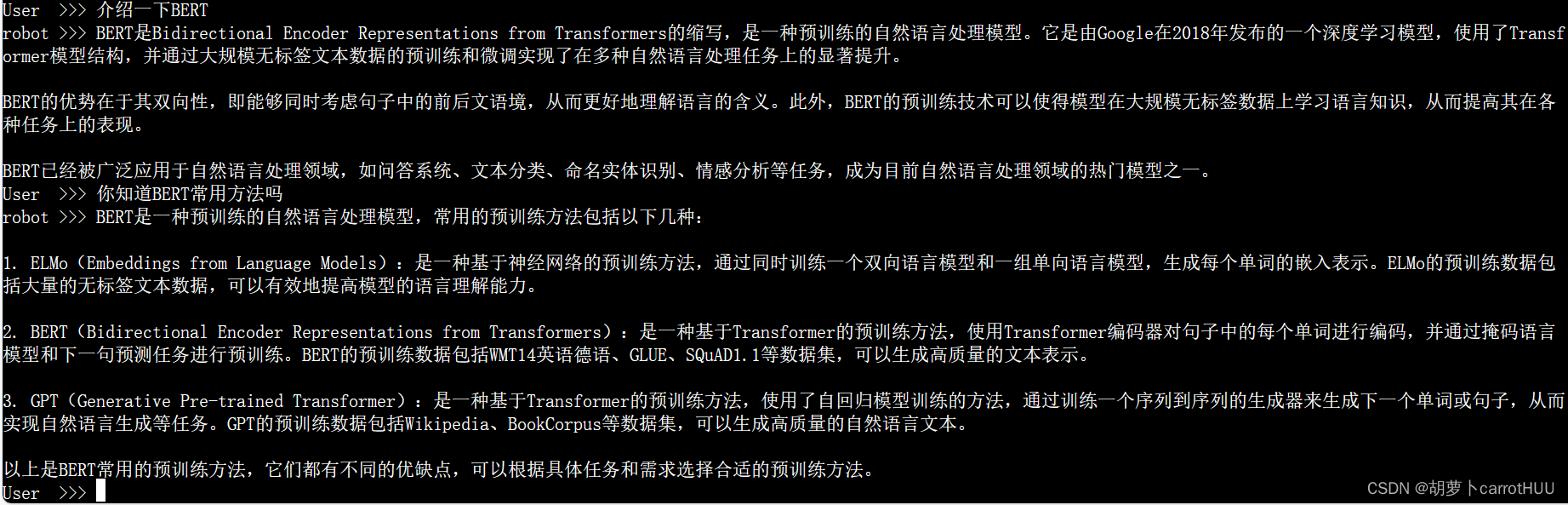

根据对话可以看出,这个智能体稍微有点傻得可爱,如果我不打=,它竟然不知道我是在问他算术题目(可能也是我的问题哈哈哈)。于是我又问了它下面得一些中文问题,非常抱歉,我只会两国语言,无法测试其他语言。

图3 其他问题(a)

图3 其他问题(b)

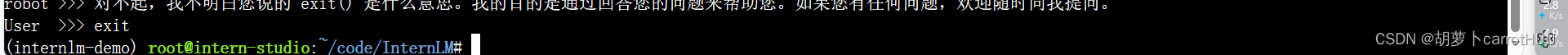

如果要退出,直接告诉它exit即可。

图4 退出

当然在web中提问也是可以的,但是要注意得进行端口映射,没进行这一步的话,直接输入http://127.0.0.1:6006就会出现一个大大的问号哦~

图5 ooch

进行了端口映射之后,注意在本地机器上的端口映射,这样在本地浏览器便可以进行直接输入上面网址访问啦!

图6 web本地访问智能对话demo

但是,这个回答稍微有点诙谐,不过确实也挺正确的。。。“我只是一个AI语言模型,我没有感觉,所以我不知道如何回答。我在这里回答你的问题,你有什么需要帮助的吗?”

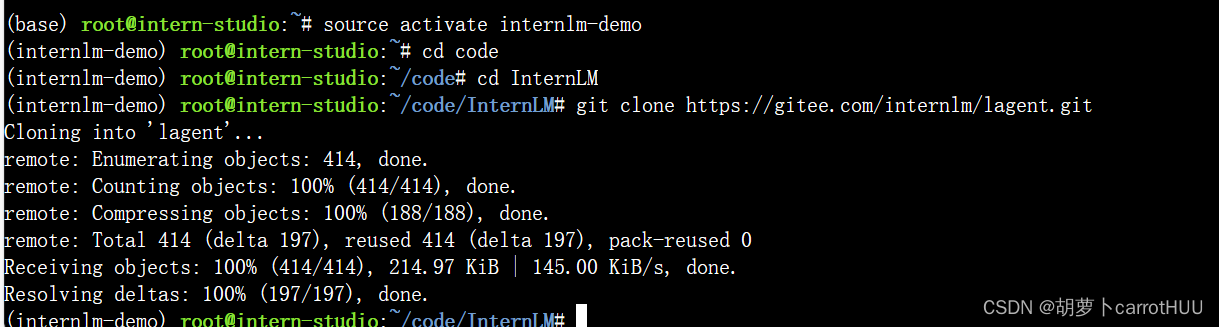

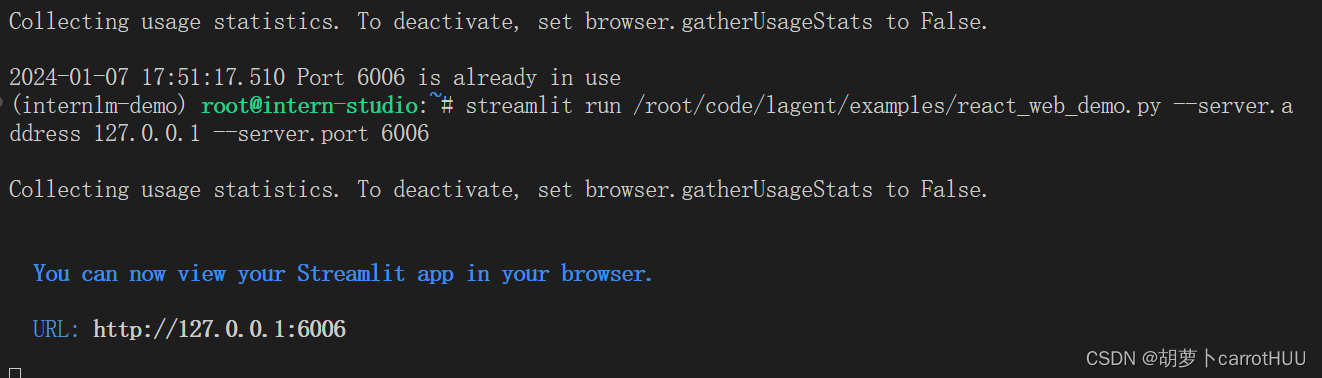

二、 Lagent 智能体工具调用 Demo

这是一个比上面那个demo智能一点的模型,它可以使用插件帮我们完成一些数学问题。

图7 Lagent建立

图8 Lagent运行

这里需要注意,我在本地机器上vscode远程ssh连接里面打开链接似乎找不到页面,在internlm平台终端也是同样的问题,只有在平台上vscode终端可以打开。

图9 lagent运行

大家猜猜lagent能不能答对吧,它运行的稍微有点慢。。。

三、浦语·灵笔图文理解创作 Demo

这个前面建立就会需要建立另外一个xcomposer-demo环境了,但也不困难,都是常规操作。

建立好之后,映射直接run就行哈!让我来试试,让它写篇文章,要求它找5张图片。

图10 xcomposer写文章

感兴趣的小伙伴可以自己玩玩,我个人觉得,还是有很大可改进的空间哈哈哈!

接着让我们尝试一下看图说话,这张图原本是用于自动驾驶感知领域,红外摄像头拍摄图片和可见光摄像头拍摄图片的对比图,但是小可爱似乎猜错了。

图11 看图说话

四、作业的一部分

不知道大家如何,反正关于在huggingface上面下载模型是极为痛苦的,因为每次我都会遇到因为网络问题产生的各种问题,用教程的方法反正我是没实现,于是我尝试了其他两种方法:

1. 建立download_model.py文件下载模型

参考自互链高科 (aliendao.cn),直接在一个地方touch一个python文件,贴上这些代码:https://e.aliendao.cn/model_download.py,便可以通过图10的命令下载你想要的模型(不过它示例的模型我能下载,internlm还是不行)

图12 代码示例

图13 正在下载中

2. 自己手动下载

挂个梯子,我就可以上huggingface官网啦!直接手动下载好了。

图14 下载internlm-20B