- 1消防荷载楼板按弹性还是塑性计算_高吨位消防车荷载怎么取?

- 2使用bert进行文本二分类_bert文本二分类

- 3springboot中数据层标准开发(增删改查等数据操作)_spring数据层编写

- 4Vmware重新安装后网络适配器不显示网卡的问题_网络适配器中没有vmware的网卡

- 5零钱兑换Python解法_给你一个整数数组coins,表示不同面额的硬币,以及一个整数amount,表示总金额。

- 6kali联网(桥接,nat和仅主机模式都有)

- 7Centos7.6系统升级openssh_centos7.6升级openssh

- 8Stable Diffusion学习笔记_comfyui一键更换背景

- 9MIPS单周期CPU的设计——I型指令的设计

- 10@ControllerAdvice 配合 @ExceptionHandler 实现自定义全局异常处理_视图跟controller 放在一起 如何自定义异常

车牌检测License Plate Detection and Recognition in Unconstrained Scenarios_aolp数据集

赞

踩

主要内容来源于:https://blog.csdn.net/cdknight_happy/article/details/93190934

包含实践中的理解!

参考文献:Sérgio Montazzolli Silva, Cláudio Rosito Jung. License Plate Detection and Recognition in Unconstrained Scenarios: 15th European Conference, Munich, Germany, September 8-14, 2018, Proceedings, Part XII[J]. 2018.

keras实现:https://github.com/sergiomsilva/alpr-unconstrained

License Plate Detection and Recognition in Unconstrained Scenarios

Sérgio Montazzolli, Claudio Rosito Jung

摘要

尽管自动车牌识别(ALPR)的商业和学术方法数量众多,但大多数现有方法都集中在特定车牌(LP)区域(例如欧洲,美国,巴西,中国台湾等),并且经常探索包含近似正面图像的数据集。本文提出了一个完整的ALPR系统,专注于无约束的场景,其中车牌图像可能由于倾斜视角而存在严重的失真。我们的主要贡献是引入了一种新颖的卷积神经网络(CNN),该网络能够在单个图像中检测和校正多个失真的车牌,这些校正过的车牌可以通过光学字符识别(OCR)方法以获得最终结果。作为额外的贡献,我们还为来自不同地区和采集条件的具有挑战性的LP图像集进行了手工标注。我们的实验结果表明,本文所提出的方法,对于特定场景没有任何参数调整或微调,车牌识别的结果与传统场景中的最先进的商业系统表现相近,并且在具有挑战性的场景中优于其他的学术和商业方法。

关键词:车牌;深度学习;卷积神经网络

1 引言

一些与交通相关的应用,例如被盗车辆的检测,收费控制和停车场访问验证都涉及到车辆识别,其由自动车牌识别(ALPR)系统执行。并行处理和深度学习(DL)的最新进展改进了许多计算机视觉任务,例如目标检测/识别和光学字符识别(OCR),这显然有利于ALPR系统的优化。实际上,深度卷积神经网络(CNN)已成为应用于车辆和车牌(LP)检测的先进机器学习技术。除了学术论文,一些商业ALPR系统也在探索DL方法。它们通常部署在庞大的数据中心,通过网络服务工作,每天能够处理数千到数百万的图像,并不断得到改进。这些系统包括Sighthound (https://www.sighthound.com/), OpenALPR (http://www.openalpr.com/)和Amazon Rekognition (https://aws.amazon.com/rekognition/).

尽管在最先进技术方面取得了进步,但大多数ALPR系统主要采用车辆和LP的正面视图,这在诸如收费监控和停车场验证等应用中很常见。然而,更轻松的图像采集场景(例如,执法人员使用移动摄像头或智能手机行走)可能会导致视角倾斜,其中LP可能高度扭曲但仍然可读,如图1所示,即便是最先进的商业ALPR系统对这些车牌的识别准确率也难以令人满意。

在这项工作中,我们提出了一个完整的ALPR系统,可以在各种场景和摄像机中具有良好表现。我们的主要贡献是引入了一种新型网络,能够在许多不同的摄像机姿态中检测LP并估计其失真,从而允许在OCR之前进行校正处理。另一个贡献是大量使用合成扭曲的真实图像来增强训练数据,允许使用少于200个手动标记的图像从头开始训练网络。所提出的网络和数据增强方案还导致了一个灵活的ALPR系统能够使用相同的参数(不微调)成功地检测和识别独立测试数据集中的LP。

我们还概括了为巴西LP开发的现有OCR方法。基本上,我们使用一种新的训练集重新训练他们的OCR网络,该训练集由真实和人工生成的数据组合而成,使用类似于目标区域的字体类型。因此,重新训练的网络在原始巴西场景中对于真实LP的检测和分类变得更加鲁棒,而且对于欧洲和台湾LP也变得非常强大,实现了非常高的精确度和召回率。用于此项工作的所有注释数据都公开可用于 http://www.inf.ufrgs.br/∼crjung/alpr-datasets,参考图像可以通过下载汽车数据集[16],SSIG数据库[6]和AOLP数据集[10]获得。

本文的其余部分安排如下。在第2节中,我们简要回顾了ALPR的相关方法。第3节给出了所提方法的详细信息,其中我们描述了LP检测和非扭曲网络,以及用于训练模型的数据增强过程。总体评估和最终结果见第4节。最后,第5节总结了我们的结论,并为未来的一些工作提供了观点。

2 相关工作

ALPR是查找和识别图像中的车牌。它通常分为四个子任务,形成一个连续的管道:车辆检测,车牌检测,字符分割和字符识别。为简单起见,我们将最后两个子任务组合称为OCR。

过去已经提出了许多不同的ALPR系统或相关的子任务,通常使用图像二值化或灰度分析来找到候选提议(例如LP和字符),然后是手工制作的特征提取方法和经典的机器学习分类器。随着DL的兴起,最先进的技术开始向另一个方向发展,现在很多工作都采用了CNN,因为它可以实现高精度的通用物体检测和识别。

与ALPR相关的场景是文本定位(STS)和野外数字读取(例如来自Google街景图像[22])的问题,其目标是在自然场景中查找和读取文本/数字。虽然ALPR可以被视为STS的一个特例,但这两个问题还是有所不同,在ALPR中,我们需要学习没有语义信息的字符和数字(也没有太多的字体变化),而STS则专注于包含高字体可变性的文本信息,并可能探索词汇和语义信息,如[30]。数字读取不提供语义信息,只处理数字,比ALPR上下文简单,因为它避免了常见的数字/字母混淆,例如B-8,D-0,1-I,5-S。

本文的主要贡献是一个新颖的LP检测网络,我们通过回顾这个特定子任务的基于DL的方法,以及一些可以处理失真文本并可用于LP检测的STS方法开始本节。接下来,我们将完成基于DL的ALPR系统。

2.1 车牌检测

YOLO网络[23,24]的成功启发了许多最近的工作,旨在实现实时的LP检测。Hsu等人使用略微修改的YOLO [23]和YOLOv2 [24]网络进行LP检测,作者扩大了网络输出粒度以改善检测数量,并获取了检测框属于两个类(LP和背景)的概率。他们的网络在精确度和召回率之间取得了很好的折衷,但是对提取的边界框的定位不够精准。另外,由于Yolo不擅长检测小目标,因此需要进一步评估汽车远离摄像机的情况。

在[31]中,训练了两个基于YOLO的网络,目的是检测旋转的LP。第一个网络用于查找包含LP的区域,称为“注意模型”,第二个网络捕获LP的旋转矩形边界框。尽管如此,他们只考虑了平面内旋转,而不是由摄像机视角倾斜引起的更复杂的变形,例如图1中所示的那些(理解:ALMD-YOLO模型,两个模型级联,前置CNN用于确定关注区域,MD-YOLO模型用于回归,无开源代码)。此外,由于它们没有提供完整的ALPR系统,因此很难评估OCR方法对检测到的区域的性能。

使用滑动窗口方法的车牌检测器或与CNN结合的候选滤波器也可以在文献[3,2,27]中找到。然而,由于不使用如YOLO,SSD [21]和Faster R-CNN [25]等目标检测架构中的共享计算,它们往往计算效率低下。

尽管场景文本定位(STS)方法主要关注大的字体变化和词汇/语义信息,但值得一提的是一些处理旋转/扭曲文本的方法,可用于倾斜视角中的LP检测。Jaderberg及其同事[13]提出了一种基于CNN的自然场景文本识别方法,使用完全合成的数据集来训练模型。尽管取得了良好的效果,但它们仍然非常依赖N-gram,这不适用于ALPR。古普塔等人[7]还通过将文本逼真地粘贴到真实图像中来探索合成数据集,主要关注文本定位。输出是围绕文本的旋转边界框,其发现ALPR场景中常见的离面旋转的限制。

最近,Wang等人[29]提出了一种检测各种几何位置的文本的方法,称为实例转换网络(ITN)。它基本上是由三个CNN组成的:一个用于计算特征的骨干网络,一个用于推断仿射参数的转换网络,其中假设在特征映射中存在文本,以及一个最终分类网络,其输入是根据仿射参数通过采样特征建立的(理解:检测+仿射变换)。虽然这种方法(理论上)可以处理离面旋转,但是它无法正确推断实际将文本区域映射到矩形的变换,因为文本周围没有物理边界区域应该映射到未失真视图中的矩形。在ALPR中,LP是矩形和平面的构造,我们探索此信息以回归转换参数,详见3.2节。

2.2 完整ALPR方法

Silva和Jung [28]和Laroca等人[17]提出了基于一系列改进的YOLO网络的完整ALPR系统。在[28]中使用了两个不同的网络,一个用于联合检测汽车和LP,另一个用于执行OCR。在[17]中共使用了五个网络,基本上每个ALPR子任务一个,其中两个用于字符识别。虽然这两个系统都是实时的,但是他们只专注于巴西车牌,并且没有进行车牌校正,只处理正面和接近矩形的LP。

塞尔米等人[27]使用一系列基于形态学算子,高斯滤波,边缘检测和几何分析的预处理方法来寻找LP候选和字符。然后,使用两个不同的CNN来(i)从每个图像的一组LP候选分类中挑选一个单个正样本;(ii)识别分割的字符。该方法针对每个图像只处理单个LP,并且根据作者的说法,失真的LP和不良的光照条件都会影响性能。

李等人[19]提出了一个基于Faster R-CNN的网络[25]。使用区域提议网络以找到候选LP区域,其相应的特征图由RoI池化层裁剪。然后,这些候选者被送到网络的最后部分,计算其是/不是LP的概率,并且通过递归神经网络执行OCR。尽管很有希望,但作者提出的评估表明,在包含倾斜LP的大多数具有挑战性的情景中,性能尚待优化。

商业系统是最先进技术的良好参考。虽然它们通常只提供有关其架构的部分(或没有)信息,但我们仍然可以将它们用作黑盒来评估最终输出。如第1部分所述,示例是Sighthound,OpenALPR(这是Metropolis平台2中的NVIDIA官方合作伙伴)和Amazon Rekognition(一种通用AI引擎,包括可用于LP识别的文本检测和识别模块)。

3 本文提议的方法

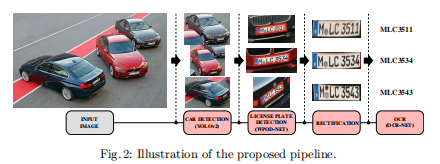

本文所提出的方法由三个主要步骤组成:车辆检测,LP检测和OCR,如图2所示。给定输入图像,第一模块检测场景中的车辆。在每个检测区域内,所提出的变形平面目标检测网络(WPOD-NET)搜索LP并对每个检测回归一个仿射变换,允许将LP区域校正成类似于正面视图的矩形。这些正的被校正的检测被送到OCR网络进行最终字符识别。

3.1 车辆检测

由于车辆是许多经典检测和识别数据集中存在的基础对象之一,例如PASCAL-VOC [5],ImageNet [26]和COCO [20],我们决定不从头开始训练检测器,而是选择考虑一些标准来执行车辆检测的已知模型。一方面,期望高召回率,因为任何未检测到的具有可见LP的车辆直接导致整体LP的漏检。另一方面,需要进行又快有准的检测,因为每个错误检测到的车辆必须由WPOD-NET验证。基于这些考虑,我们决定使用YOLOv2网络,因为它的速度较快(大约70 FPS)和良好的精度和召回折衷(PASCAL-VOC 76.8%mAP)。我们没有对YOLOv2进行任何改变或改进,只是将网络用作黑匣子,合并与车辆(即汽车和公共汽车)相关的输出,并忽略其他类别。

然后在将正的检测结果输入WPOD-NET之前调整其大小。根据经验,较大的输入图像允许检测较小的物体,但增加了计算成本。在大致正面/背面视图中,LP尺寸与车辆边界框(BB)之间的比率很小。然而,对于倾斜/侧向视图,该比率更小,因为车辆BB趋于更大且更长。因此,倾斜视角的输入图像应缩放到比正面视角更大的尺寸,以保持LP区域仍然可识别。

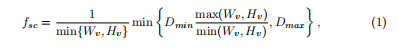

尽管可以使用诸如[32]的3D姿势估计方法来确定缩放尺寸,但是本文基于车辆BB的纵横比呈现了一个简单且快速的处理过程。当它接近1时,可以使用较小的尺寸,并且必须随着纵横比变大而增加尺寸。更确切地说,缩放因子 f s c f_{sc} fsc由下式给出:

其中 W v W_v Wv和 H v H_v Hv是车辆BB的宽度和高度。注意, D m i n ≤ f s c m i n ( W v , H v ) ≤ D m a x D_{min} ≤ f_{sc} min(W_v,H_v)≤D_{max} Dmin