- 1自然语言处理(NLP)-第三方库(工具包):Stanford CoreNLP(更适合英文数据集)【命名实体识别、分词、词性标注、依存句法分析、语义角色标注】【利用Java开发;有Jar包可供调用】

- 2【图像分类】基于深度学习的人脸表情识别(8种表情,ResNet网络)

- 3ArrayList和LinkedList的区别_linkedlist arraylist区别,线程安全否

- 4echarts-tooltip自定义内容使用vue数据渲染_echarts tooltip formatter自定义html

- 5悬浮小球(点击实现页面跳转)_c++悬浮球功能实现代码量

- 6Android Studio Gradle 构建项目下载依赖包慢的解决方式_安卓构建器下载慢

- 7Dot NET操作Excel COM对象_com撖寡情excel

- 8PyTorch CUDA error: an illegal memory access was encountered_torch cuda synchronize illegal memory access

- 9深度学习-GAN背景知识_熵是交叉熵的下界

- 10arcgis 字段计算器 条件赋值_ARCGIS中字段计算器的使用说明

北大正式发布中文法律大模型ChatLaw,并开源_chatlaw 开源

赞

踩

据《科创板日报》报道,北京大学团队最近发布了名为ChatLaw的中文法律大模型,旨在为大众提供普及性的法律服务。这个模型支持接收文件和语音输入,同时能够生成法律文书、提供法律建议以及为用户推荐合适的法律援助服务。

为了开发这一项目,北京大学深圳研究生院兔展智能AIGC联合实验室以通用的超大规模模型为基础,使用大量法律领域的结构化文本数据进行训练。

值得一提的是,该团队还开源了三个模型:ChatLaw-13B、ChatLaw-33B和ChatLaw-TextVec。

ChatLaw项目的推出受到了广泛的关注和认可。目前,该项目在GitHub上的星数已经超过了一千,显示了其受欢迎程度和在法律科技领域的潜在影响力。

当然北京大学也开源了一个法律大模型,lawyer-llama,通过在大规模法律语料中进行训练,系统学习中国的法律知识体系使得模型可以掌握中国的法律知识并应用于中国的法律实务。

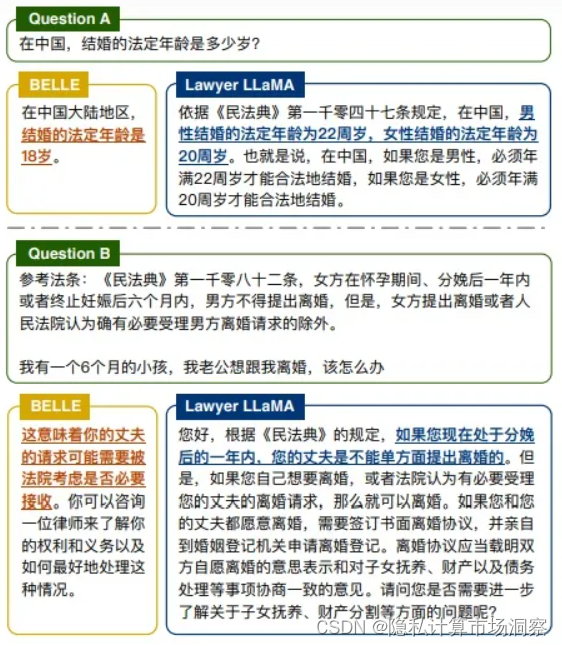

对比上图左侧的BELLE(Be Everyone's Large Language model Engine)模型,如果提问“中国的法定结婚年龄”,可以看到 Lawyer LLaMA 给出了一个正确的,并且更像是 Lawyer 的回答。并且,即使是提供了必要的法律条文,如上图问题B,BELLE 也无法给出一个正确的回答,而 Lawyer LLaMA 则有理有据的颇具专业性的很好的回答了这个问题。

其实从 BELLE 的回答中也可以看出,直接将这样一个大模型套在专业的垂直领域下往往会出现许多问题,作者团队认为,要使得大模型可以很好地适应法律领域的特殊要求,必须要满足以下三个条件,分别是:

1.精确的表意,避免歧义:在法律领域中常常会有仅仅更换一个字词,就会导致法律关系构建出截然相反的结果,譬如中文中定金与订金仅相差一个字,但是其含义与法律效力在合同法中却完全不同;

2.理解与区分法律术语:在法律中,有许多特有的特定词汇,许多术语仅仅出现在法律领域中,如法人这个概念,而还有更多术语可能在法律领域与日常生活领域拥有着不尽相同的含义,也需要模型加以区分;

3.能够理解实际情况:除了对法律术语与法律分析要有基本的了解与系统的掌握以外,模型还应当具有精确理解现实生活问题的能力,即模型需要拥有一个应用法律理论来解决特定问题的核心能力。

基于上述理论,作者团队便基于开源的 LLaMA 模型期望通过以下几步解决法律领域大模型的适用问题:

1.法律相关知识注入:通过收集大量法律领域的原始文本,如法律条文、司法解释与国家法律文件,对原始模型使用新数据进行继续训练;

2.特定领域技能习得:一个良好的法律大模型应该能够解决法律领域的常见问题,如概念解释、案例分析与法律咨询,因此作者收集了一组实际的任务案例,使用 ChatGPT 生成相应答案从而进行监督微调,以使得模型具有解决法律领域特定任务的能力;

3.信息检索减轻幻觉:为了减轻大模型的机器幻觉问题,作者同时引入了一个信息检索模块,在生成每个回复之前,都首先利用用户的查询与上下文检索相关法律条文,基于这些法律条文再去生成相应回复。

作者团队便成功完成了 Lawyer LLaMA 的构建,Lawyer LLaMA 的整体运作流程如图所示

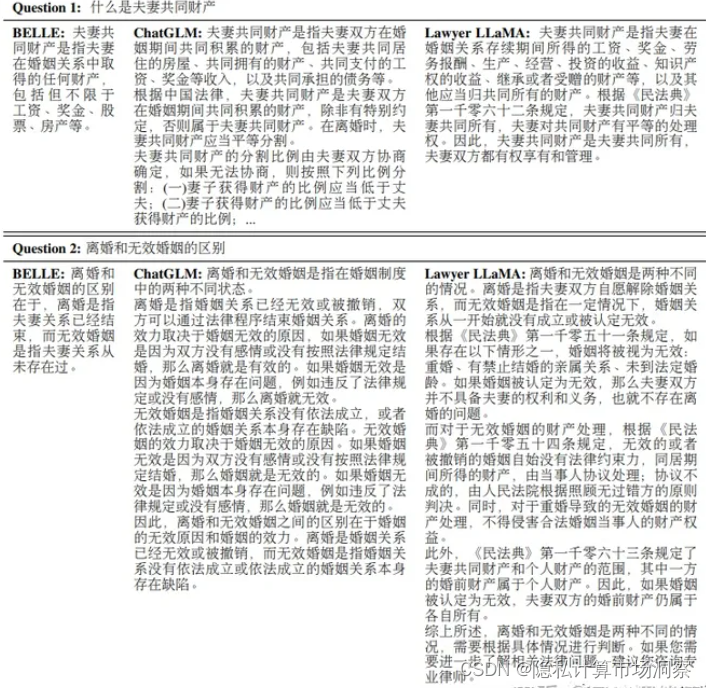

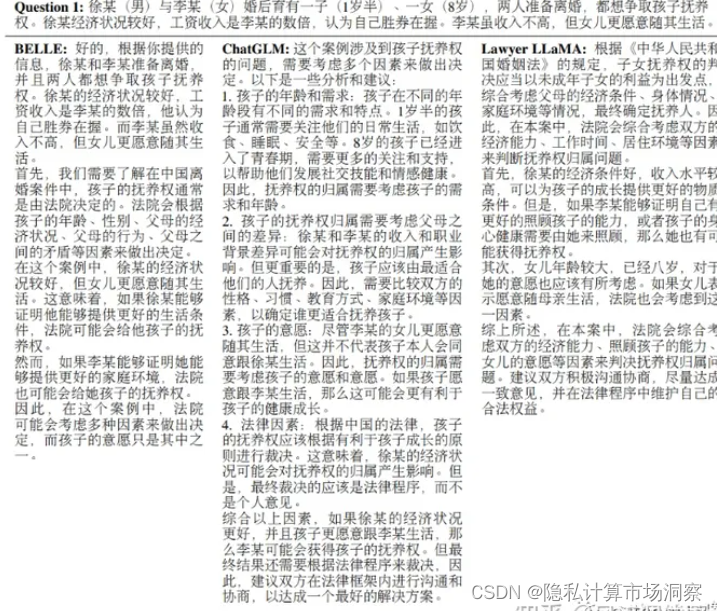

我们直接看看论文给出的效果吧,同等对比,在各个不同 角度看,lawyer-llama确实要好很多。

详细代码和安装步骤在评论区,请自取,请大家多多支持。