- 1【Java--数据结构】栈:不仅仅是数据存储,它是编程的艺术

- 2【数据结构与算法】直接插入排序和希尔排序

- 3POS--权益证明机制_ppcoin: peer-to-peer crypto-currency with proof-of

- 4DNF手游攻略:0氪攻略,转职技巧与避坑指南!

- 5H2WebReader:一款轻量级的在线HTML到Markdown转换器

- 6H5点餐系统|外卖点餐系统源码(源码+搭建+论文)

- 7深入解析Python中的range()函数_numpy range

- 8docker的安装,以及通过docker拉取nacos镜像和启动_nacos docker镜像

- 9读书笔记之人工智能_full ai的定义

- 10年龄不过30岁而已,宝妈程序员开发转测试,20Koffer也照收不误_大龄开发转测试可行吗

2024年大数据最全hadoop3 HA部署,2024年最新阿里+头条+抖音+百度+蚂蚁+京东面经

赞

踩

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

HDFS-HA********集群搭建

之前的hdfs集群搭建的规划:

| master | slave1 | slave2 |

| NameNode | Secondarynamenode | |

| DataNode | DataNode | DataNode |

HA的主要目的是消除namenode的单点故障,需要将hdfs集群规划成以下模样,其中自动故障转移为HDFS部署增加了两个新组件ZooKeeper和ZKFailoverController(ZKFC)进程,如图所示。ZooKeeper是维护少量协调数据,通知客户端这些数据的改变和监视客户端故障的高可用服务。

| master | slave1 | slave2 |

| NameNode | NameNode | NameNode |

| JournalNode | JournalNode | JournalNode |

| DataNode | DataNode | DataNode |

| Zookeeper | Zookeeper | Zookeeper |

| ZKFC | ZKFC | ZKFC |

配置文件修改

1.修改core-site.xml,hdfs-site.xml配置文件

核心配置文件core-site.xml

fs.defaultFS

hdfs://mycluster

hadoop.tmp.dir

/opt/module/hadoop3/data

dfs.journalnode.edits.dir

/opt/module/hadoop3/data/jn

ha.zookeeper.quorum

master:2181,slave1:2181,slave2:2181

HDFS配置文件hdfs-site.xml

dfs.nameservices

mycluster

dfs.ha.namenodes.mycluster

nn1,nn2,nn3

dfs.namenode.rpc-address.mycluster.nn1

master:8020

dfs.namenode.rpc-address.mycluster.nn2

slave1:8020

dfs.namenode.rpc-address.mycluster.nn3

slave2:8020

dfs.namenode.http-address.mycluster.nn1

master:9870

dfs.namenode.http-address.mycluster.nn2

slave1:9870

dfs.namenode.http-address.mycluster.nn3

slave2:9870

dfs.namenode.shared.edits.dir

qjournal://master:8485;slave1:8485;slave2:8485/mycluster

dfs.client.failover.proxy.provider.mycluster

org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider

dfs.ha.fencing.methods

sshfence

shell(/bin/true)

dfs.ha.fencing.ssh.private-key-files

/root/.ssh/id_rsa

dfs.ha.automatic-failover.enabled

true

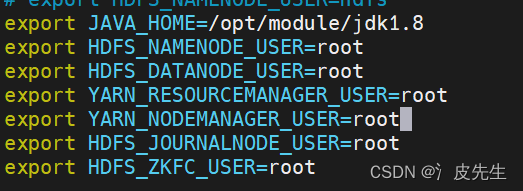

2.修改hadoop-env.sh文件

vim hadoop-env.sh

添加内容

export JAVA_HOME=/opt/module/jdk1.8

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

export HDFS_JOURNALNODE_USER=root

export HDFS_ZKFC_USER=root

4.修改workers文件

vim workers

删除原来的localhost修改为

master

slave1

slave2

5.用scp分发第一、二步的文件到所以节点

cd /opt/module

scp –r hadoop3 slave1:/opt/module

scp –r hadoop3 slave2:/opt/module

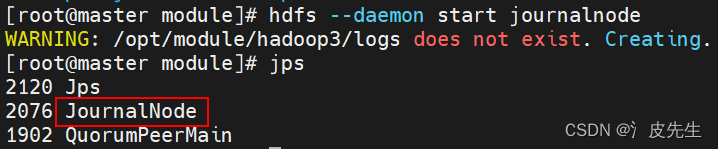

6.启动journalnode服务(三个节点都要操作)

hdfs --daemon start journalnode

检查是否成功启动

jps

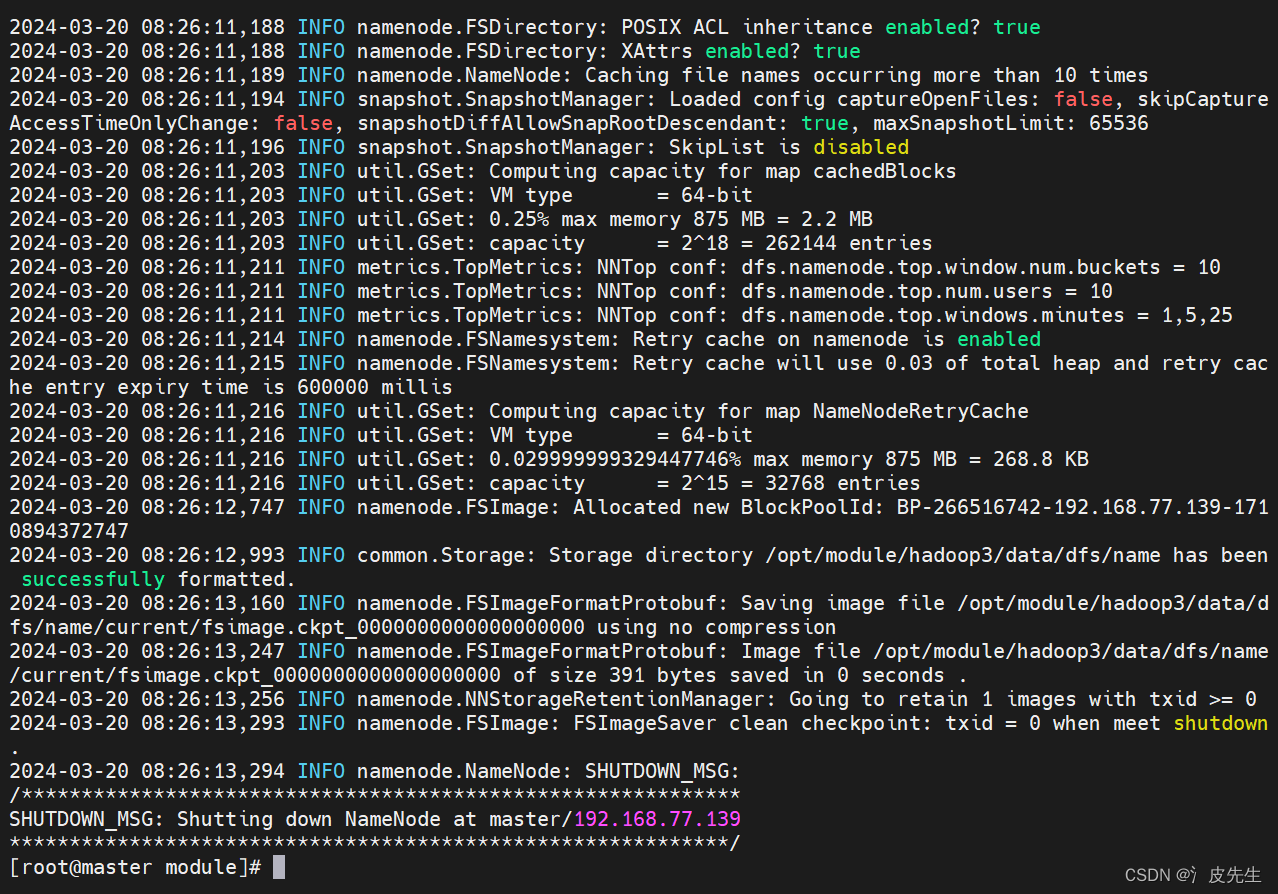

7.格式化namenode(格式化之前确保zookeeper服务与journalnode服务都已启动)

hdfs namenode -format

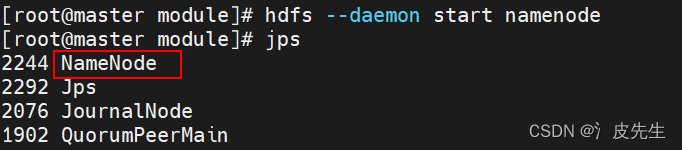

8.单独启动namenode(在master上执行)

hdfs --daemon start namenode

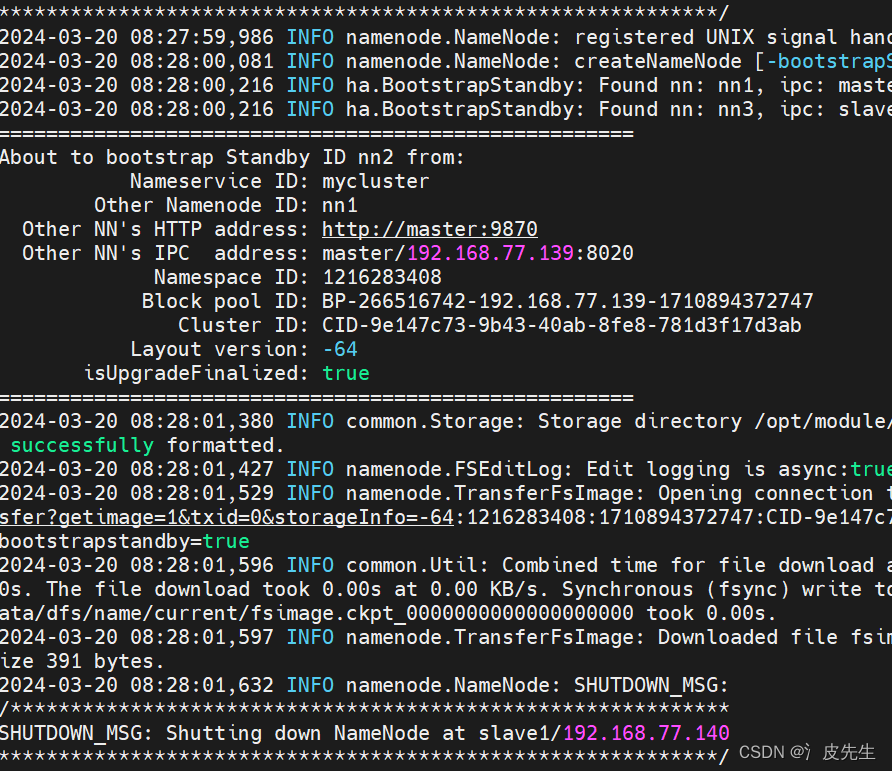

9.namenode主从信息同步(在slave1、slave2上执行)

hdfs namenode -bootstrapStandby

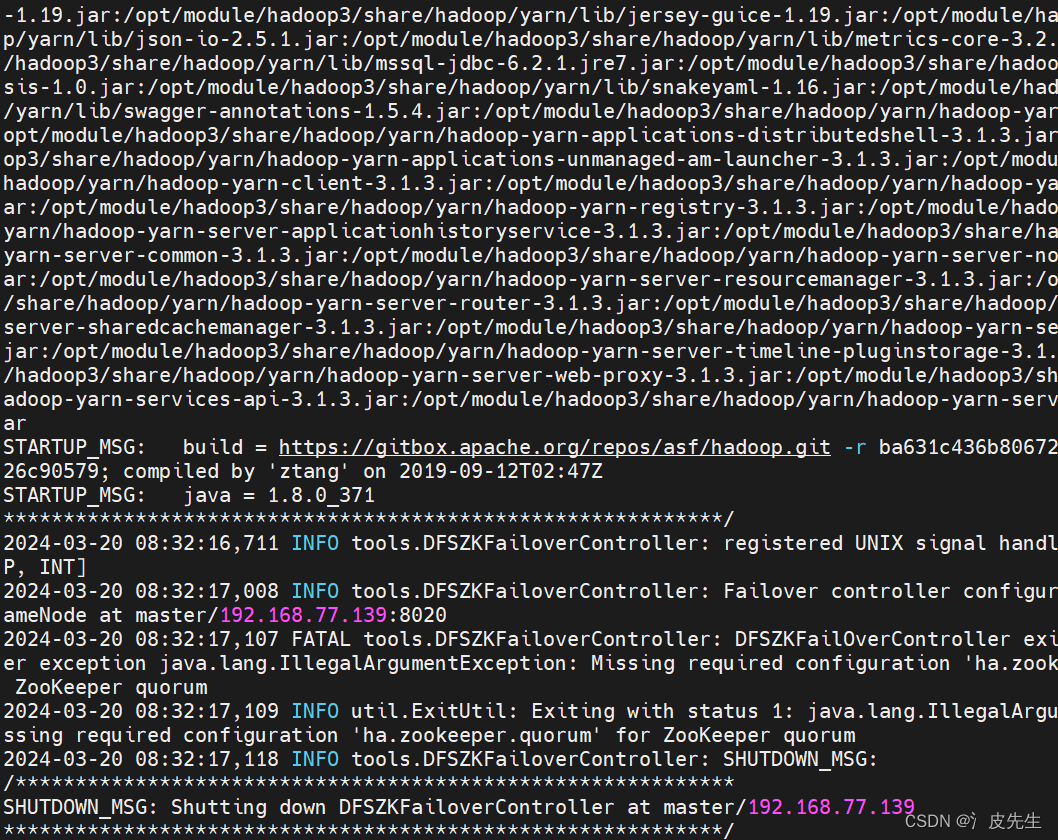

10.格式化zookeeper(只需要在master节点执行)

执行之前执行stop-dfs.sh先关掉journalnode进程

hdfs zkfc -formatZK

11.启动hadoop

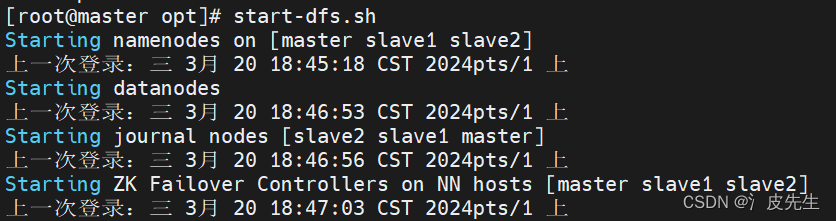

start-dfs.sh

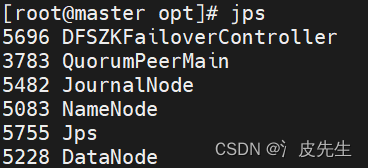

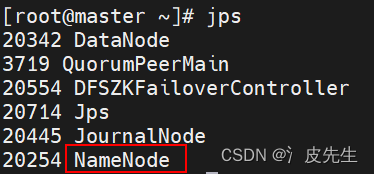

12.验证hadoop正常启动

jps

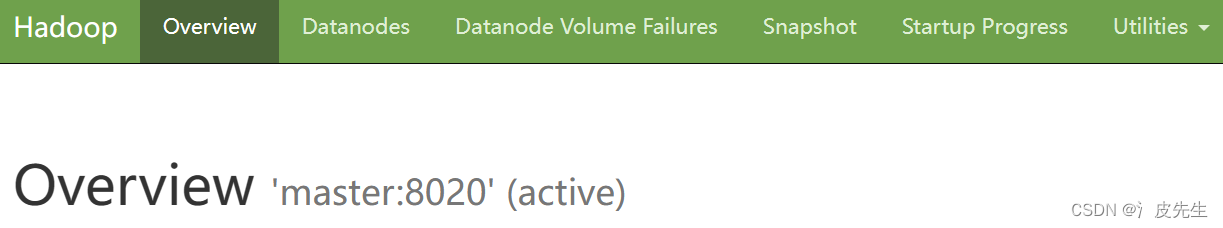

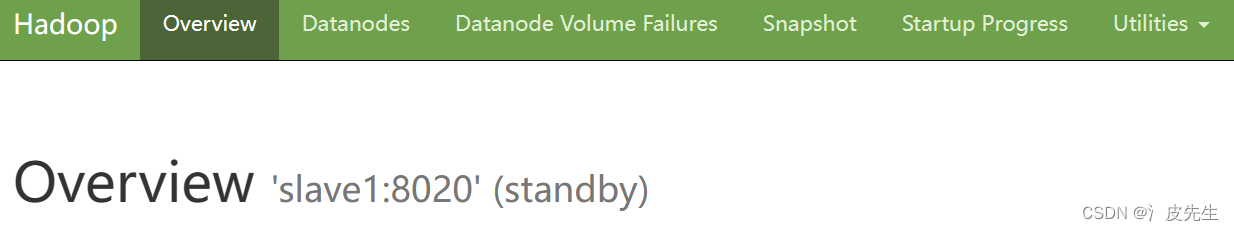

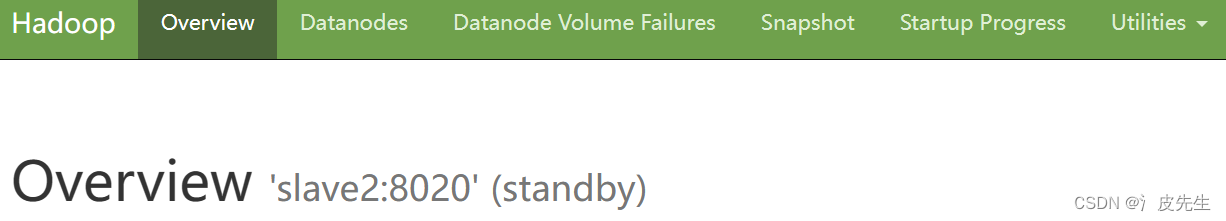

13.测试功能是否可用

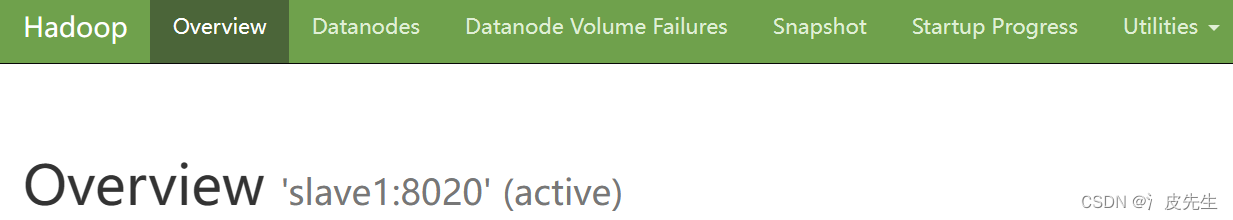

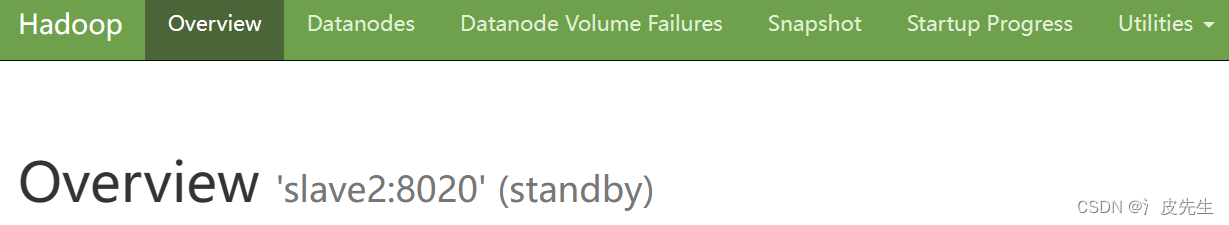

三个节点web页面如下,其中master为active,slave1与slave2为standby

查看master节点的namenode进程号,并杀死进程

kill -9 20254

此时,发现master节点web页面打不开了,slave1节点变为active状态,slave2依旧是standby

配置YARN-HA集群

集群规划如下:

| master | slave1 | slave2 |

| ResourceManager | ResourceManager | ResourceManager |

| NodeManager | NodeManager | NodeManager |

| Zookeeper | Zookeeper | Zookeeper |

配置文件修改

1.修改yarn-site.xml,mapred.xml配置文件

yarn-site.xml

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.ha.enabled

true

yarn.resourcemanager.cluster-id

cluster-yarn

yarn.resourcemanager.ha.rm-ids

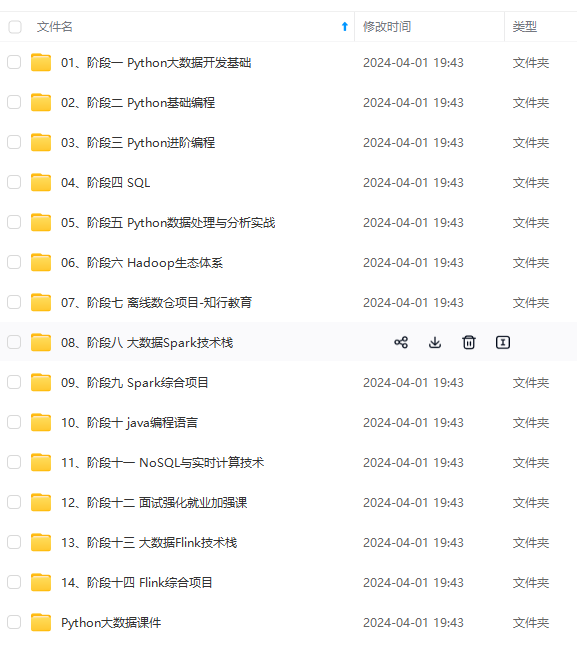

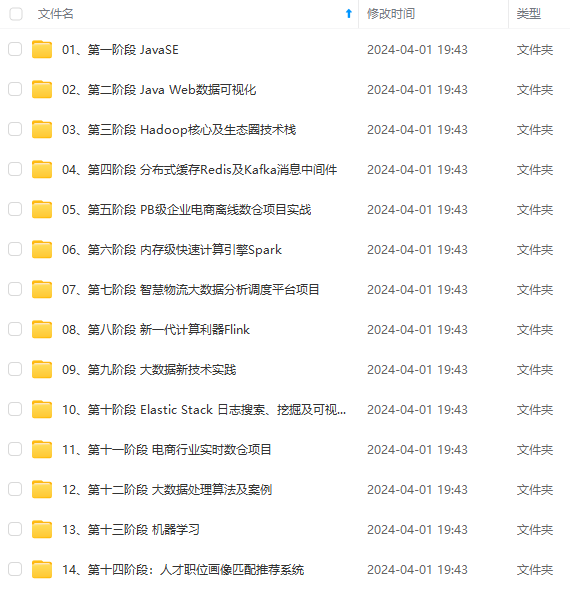

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

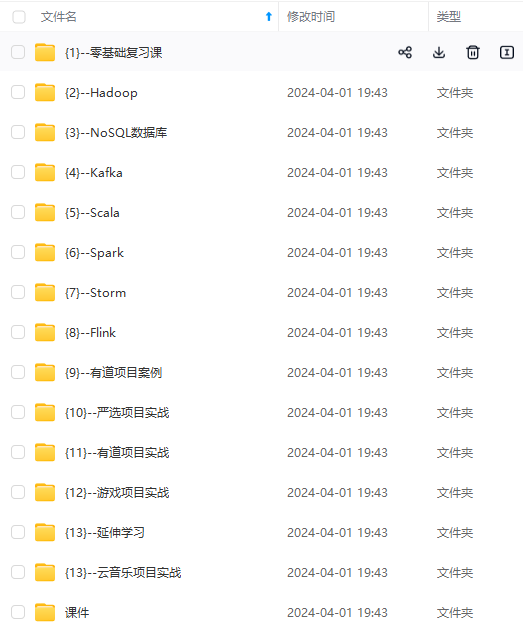

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

– 指定RM的cluster id -->

yarn.resourcemanager.cluster-id

cluster-yarn

yarn.resourcemanager.ha.rm-ids

[外链图片转存中…(img-q4vjkhpr-1715592214294)]

[外链图片转存中…(img-HhWvng4j-1715592214294)]

[外链图片转存中…(img-BtwI4cPI-1715592214295)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新