- 1《内网穿透》无需公网IP,公网SSH远程访问家中的树莓派_ssh内网穿透 无需公网ip

- 2Visual Studio Code 终端为管理员权限_vscode终端管理员权限

- 3柏拉图表征假说:AI模型趋同于现实的统一表征_柏拉图表征假说论文中文

- 4Coursera吴恩达《序列模型》课程笔记(1)-- 循环神经网络(RNN)_选择概率最大的word id作为预测标签 pytorch

- 5泰坦尼克号 数据分析_第1部分:泰坦尼克号-数据分析基础

- 6深度学习——循环神经网络RNN_循环神经网络是什么

- 7XML外部实体注入总结(XXE靶机复现)

- 8什么是DCSync_secretsdump.py

- 9从endnote向word中插入参考文献的格式修改_知网endnote插入word参考文献的样式

- 10【Python】系列模块之标准库OS详解_python标准库模块

【Keras+计算机视觉+Tensorflow】生成对抗神经网络中DCGAN、CycleGAN网络的讲解(图文解释 超详细)_csdn 对抗神经网络

赞

踩

觉得有帮助麻烦点赞关注收藏~~~

一、生成对抗网络简介

生成对抗网络(GANs,Generative Adversarial Nets),由Ian Goodfellow在2014年提出的,是当今计算机科学中最有趣的概念之一。GAN最早提出是为了弥补真实数据的不足,生成高质量的人工数据。GAN的主要思想是通过两个模型的对抗性训练。随着训练过程的推进,生成网络(Generator,G)逐渐变得擅长创建看起来真实的图像,而判别网络(Discriminator,D)则变得更擅长区分真实图像和生成器生成的图像。GAN网络不局限于提高单一网络的性能,而是希望实现生成器和鉴别器之间的纳什均衡。

事实上,整个学习优化的过程是一个极大极小博弈问题,即寻找G和D之间的平衡点,G的目标是使其输出X的分布尽可能接近真实数据的分布,而D是一个二分类器,目标在于分清是输出为0的生成数据还是输出为1的真实数据,当达到平衡点时,D便无法判断数据来自G还是真实样本,此时的G就为最优状态,综上所述,GAN在不断的对抗学习过程中,生成的数据越来越接近真实样本,而D的判别能力则越来越模糊

假设在低维空间Z存在一个简单容易采样的分布p(z),例如正态分布 ,生成网络构成一个映射函数G:Z→X,判别网络需要判别输入是来自真实数据X_real还是生成网络生成的数据X_fake,结构示意图如下图所示

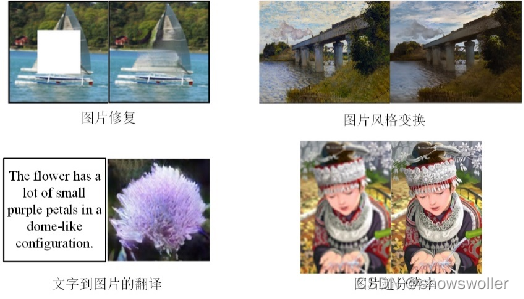

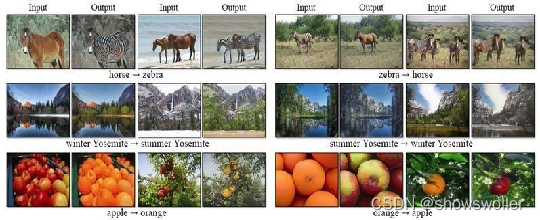

随着深度卷积神经网络在图像领域的发展,GAN衍生出了很多模型,广泛应用于多个领域。例如DCGAN 为稳定的GAN网络设计和训练提供了十分宝贵的经验,其采用CNN实现对样本的无监督学习,即生成网络可以从随机噪声映射到真实数据空间,可以生成与样本相似的图像。CycleGAN使用循环一致性生成对抗网络,实现两种图像不同风格的互相转换,StackGAN可以将文字描述作为条件,生成器生成与之符合的自然图像,另外GAN还经常被用于图像修复,编辑,去模糊等领域。

二、DCGAN

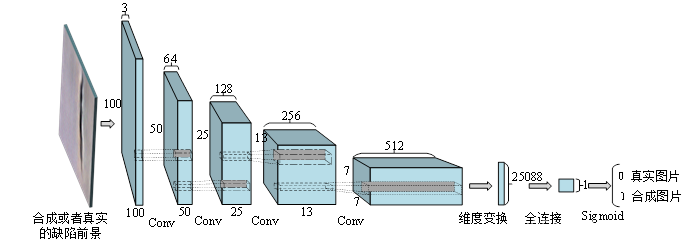

DCGAN为稳定的GAN网络设计和训练提供了十分宝贵的借鉴,DCGAN使用CNN结构代替传统GAN的全连接网络,具体的改进如下

1:批处理标准化

即对每层都进行批标准化,批标准化是将分散数据统一的做法,其优化了神经网络,产生了具有统一规格的数据,能让机器更容易学习到数据之间的规律

2:使用转置卷积上采样

转置卷积上采样是神经网络生成图像时,从低分辨率到高分辨率的上采样方法,转置卷积能够让神经网络学会如何以最佳方式进行上采样

3:使用Leaky ReLU

使用它作为激活函数,从而实现神经网络的网络结构中从输入到输入的映射,正是由于这些非线性函数的反复叠加,才使得神经网络有能力来抓取复杂的类型,Leaky ReLU的应用提高了系统的计算速度,改善了梯度消失的问题

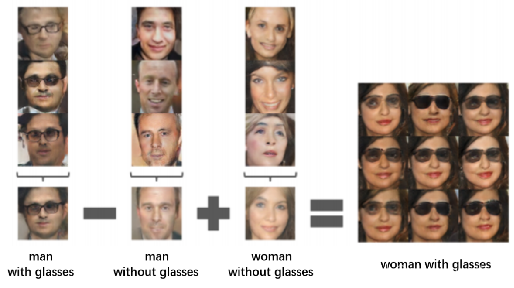

此外DCGAN的相关论文证明了随机噪声向量维度和范围变化对隐空间结构产生影响,可以改变生成图像内容,这也是我们产生多样化训练样本的原因,同时证明了生成器生成的数据也能用于图像分类任务上,这表明合成图像并不影响神经网络提取图像特征的强大能力

三、CycleGAN

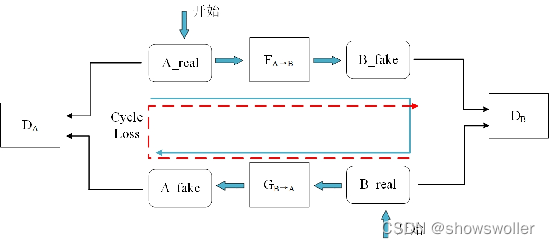

CycleGAN是由两个镜像对称的GAN构成的环形网络,其输入为源域和目标域的图像,对同时输入的图像是否匹配并无要求,即CycleGAN能在输入图像不配对的情况下实现风格转换,思路框架如下

CycleGAN共包含两个生成网络和判别网络实现A域和B域图像的互相映射,CycleGAN的损失由GAN的损失和循环一致性损失共同组成

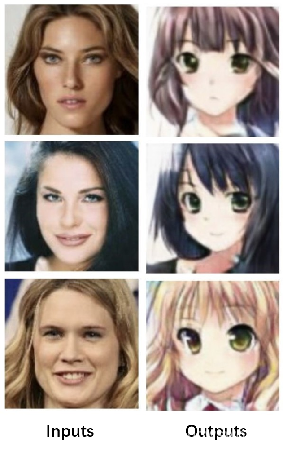

哈尔滨工业大学和腾讯优图提出加强版的CycleGAN结果如下图,可以看出CycleGAN在风格转换领域有着很强的应用价值(转成二次元啦...)

创作不易 觉得有帮助请点赞关注收藏~~~