热门标签

热门文章

- 1支持向量机(Support Vector Machine,SVM)之SMO算法及其Python实现_smo优化算法对svm多分类优化python代码

- 2【计算机网络】2、TCP:四次挥手与TIME_WAIT、shutdown() 优雅关闭 server、探活、拥塞窗口与 Nagle 算法、端口占用、tcp 的流式协议、可靠性_tcptimewait阶段进行中断abort

- 3一篇文章搞懂MySQL的分库分表,从拆分场景、目标评估、拆分方案、不停机迁移、一致性补偿等方面详细阐述MySQL数据库的分库分表方案_mysql分库分表

- 4SpringBoot + Vue实现Github第三方登录

- 5【安路科技FPGA】从流水灯入门(软件环境、vivado仿真、流水灯)_安路fpga教程

- 6知识图谱 vs GPT_知识图谱与gpt

- 7【JavaEE初阶】多线程 _ 进阶篇 _ 锁的优化、JUC的常用类、线程安全的集合类_java线程安全锁的粒度如何细化

- 8![rejected]master->master (non-fast-forward)![remote rejected] (deny updating a hidden ref)push报错解决

- 9解决MySQL错误:`ERROR 1049 (42000): Unknown database ‘nonexistentdb‘`_error 1049 (42000): unknown database 'nuoxu

- 10【C/C++】C语言runtime调用技术_c++ runtime

当前位置: article > 正文

Unity 和 OpenCV:结合计算机视觉和游戏开发_unity opencv

作者:不正经 | 2024-05-12 03:57:13

赞

踩

unity opencv

前言

Unity 和 OpenCV 是两个强大的开发工具,分别用于游戏开发和计算机视觉。结合它们可以实现一些有趣和创新的项目。本篇博客将介绍如何在 Unity 中集成 OpenCV,以及如何利用它们的结合来创建令人惊叹的应用程序。

一、Unity 中集成 OpenCV

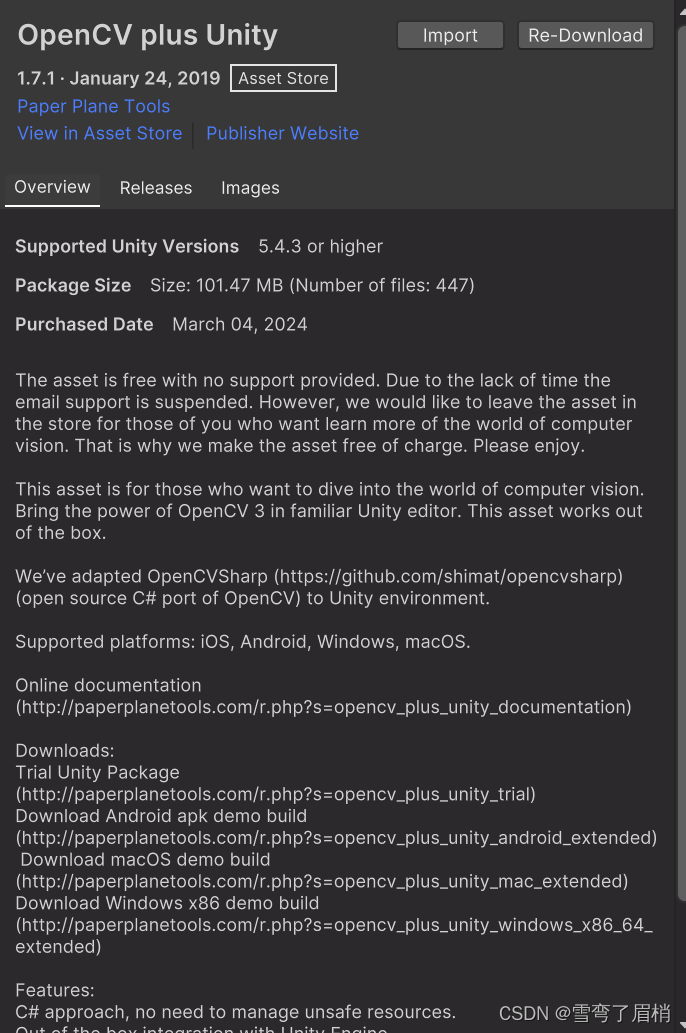

1. 安装OpenCV plus Unity 插件

首先,我们需要在 Unity 中安装 OpenCV plus Unity插件。这个插件提供了与 OpenCV 库集成的功能,使我们能够在 Unity 中使用 OpenCV 的强大功能。

2. 导入 OpenCV 包

在安装插件后,我们需要导入 OpenCV 包到 Unity 项目中。这将包括所需的库文件和相关的脚本文件,以便我们可以开始在 Unity 中使用 OpenCV。

二、图像处理应用程序的创建

1. 实时轮廓检测

我们将使用 OpenCV 在 Unity 中实现实时轮廓检测。CountourFinder.cs将捕获摄像头输入,并使用 OpenCV 查找图像中的轮廓。检测到的轮廓将被用于在 Unity 中绘制形状,并且可以与游戏对象进行交互。

// CountourFinder.cs 脚本 // 使用 OpenCV 在 Unity 中实现实时轮廓检测 using System.Collections; using System.Collections.Generic; using System.IO; using OpenCvSharp; using OpenCvSharp.Demo; using UnityEngine; using UnityEngine.UI; //继承 WebCamera 类 public class CountourFinder : WebCamera { // 图像翻转模式 [SerializeField] private FlipMode imageFlip; // 阈值 [SerializeField] private float threshold = 96.4f; // 曲线精度 [SerializeField] private float curveAccuracy = 10f; // 最小区域 [SerializeField] private float minArea = 5000f; // 多边形碰撞器 [SerializeField] private PolygonCollider2D polygonCollider; // 切换按钮 [SerializeField] private Toggle toggle; private Mat _image; // 图像 private Mat _processImage = new(); // 处理后的图像 private Point[][] contours; // 轮廓 private HierarchyIndex[] _hierarchy; // 层级 private Vector2[] vertorList; // 点的列表 // 重写 ProcessTexture 方法,处理图像纹理 protected override bool ProcessTexture(WebCamTexture input, ref Texture2D output) { // 将输入的图像纹理转换为 Mat 类型 _image = OpenCvSharp.Unity.TextureToMat(input); // 翻转图像 Cv2.Flip(_image, _image, imageFlip); // 转换为灰度图 Cv2.CvtColor(_image, _processImage, ColorConversionCodes.RGB2GRAY); // 阈值化 Cv2.Threshold(_processImage, _processImage, threshold, 255, ThresholdTypes.BinaryInv); // 查找图像中的轮廓 Cv2.FindContours(_processImage, out contours, out _hierarchy, RetrievalModes.Tree, ContourApproximationModes.ApproxSimple, null); // 重置碰撞器路径数 polygonCollider.pathCount = 0; // 遍历每个轮廓 foreach (Point[] contour in contours) { // 近似多边形 Point[] points = Cv2.ApproxPolyDP(contour, curveAccuracy, true); // 计算轮廓面积 var area = Cv2.ContourArea(contour); // 如果面积大于最小面积 if (area > minArea) { // 绘制轮廓 DrwaContour(_processImage, new Scalar(127, 1271, 127), 2, points); // 增加碰撞器路径数 polygonCollider.pathCount++; // 设置碰撞路径 polygonCollider.SetPath(polygonCollider.pathCount - 1, ToVertor2(points)); } } if (output == null) { // 将图像转换为纹理 output = OpenCvSharp.Unity.MatToTexture(toggle.isOn ? _processImage : _image); } else { // 将图像转换为纹理 OpenCvSharp.Unity.MatToTexture(toggle.isOn ? _processImage : _image, output); } return true; // 返回 true } // 将 Point 数组转换为 Vector2 数组 private Vector2[] ToVertor2(Point[] points) { vertorList = new Vector2[points.Length]; for (int i = 0; i < points.Length; i++) { // 将点转换为 Vector2 vertorList[i] = new Vector2(points[i].X, points[i].Y); } return vertorList; } // 绘制轮廓 private void DrwaContour(Mat image, Scalar color, int thickeness, Point[] points) { for (int i = 1; i < points.Length; i++) { // 绘制线段 Cv2.Line(image, points[i - 1], points[i], color, thickeness); } // 绘制最后一条线段 Cv2.Line(image, points[^1], points[0], color, thickeness); } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

- 101

- 102

- 103

- 104

- 105

- 106

- 107

- 108

- 109

- 110

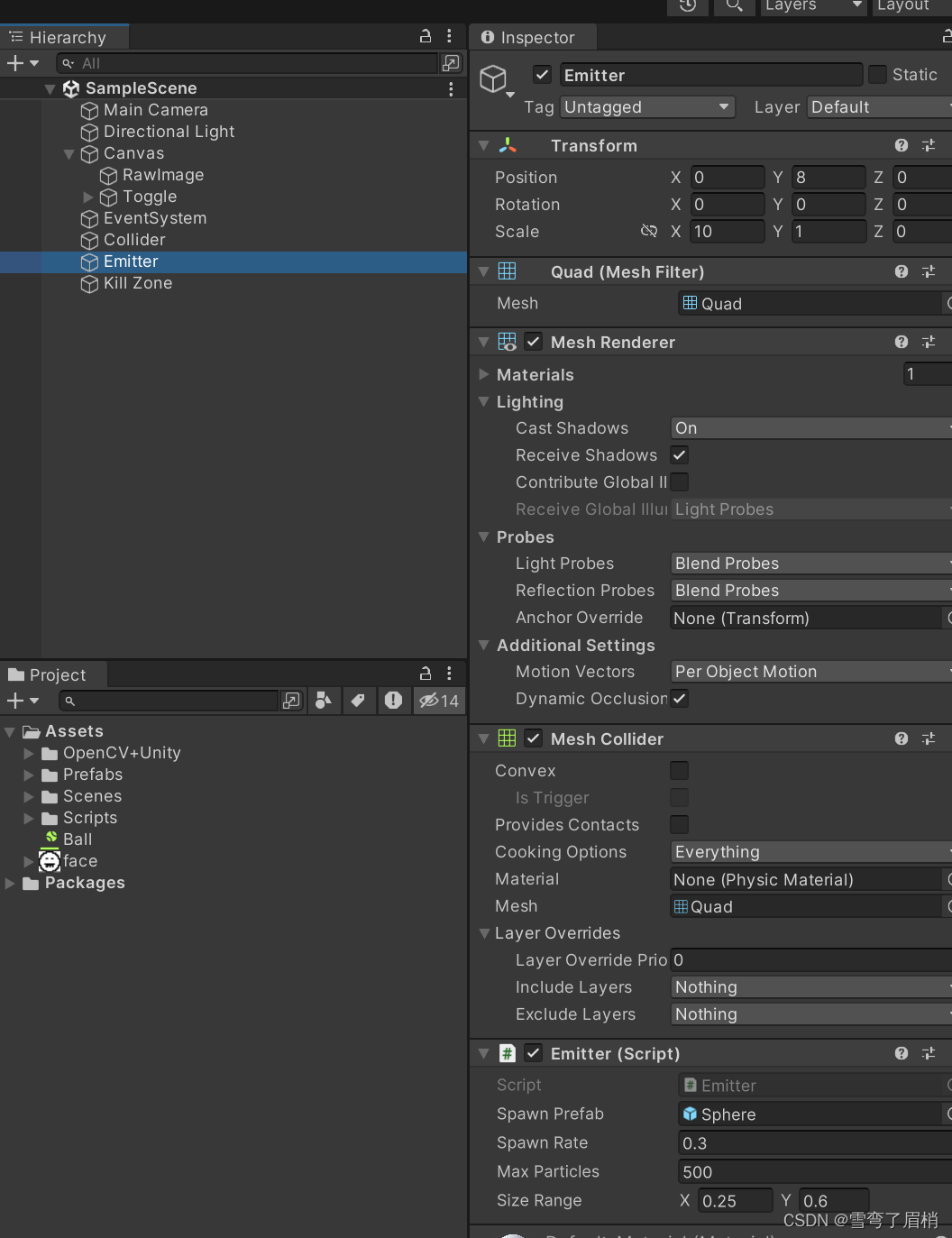

2. 粒子发射器

在 Unity 中,我们可以创建一个粒子发射器,用于在场景中生成粒子效果。这个发射器可以与 OpenCV 实现的图像处理功能结合,根据检测到的图像特征来控制粒子的生成和运动。

using System.Collections; using System.Collections.Generic; using UnityEngine; public class Emitter : MonoBehaviour { [SerializeField] private GameObject spawnPrefab; // 生成的预制体 [SerializeField] private float spawnRate = 0.1f; // 生成速率 [SerializeField] private int maxParticles = 3; // 最大粒子数量 [SerializeField] private Vector2 sizeRange; // 大小范围 private GameObject[] _pool; // 对象池 // Start is called before the first frame update void Start() { InitializePool(); // 初始化对象池 Spawn(); // 开始生成粒子 } // Update is called once per frame void Update() { } // 初始化对象池 private void InitializePool() { _pool = new GameObject[maxParticles]; // 根据最大粒子数量创建对象池 for (int i = 0; i < maxParticles; i++) { var particle = Instantiate(spawnPrefab); // 实例化预制体 particle.SetActive(false); // 初始时将粒子设置为不激活状态 _pool[i] = particle; // 将粒子添加到对象池中 } } // 生成粒子 private void Spawn() { foreach (var particle in _pool) { if (!particle.activeSelf) // 如果粒子不是激活状态 { // 随机生成粒子位置,并转换为世界坐标系下的位置 particle.transform.position = transform.TransformPoint(Random.insideUnitSphere * 0.5f); // 随机设置粒子大小 particle.transform.localScale = Random.Range(sizeRange.x, sizeRange.y) * Vector3.one; particle.SetActive(true); // 激活粒子 break; // 结束循环 } } Invoke("Spawn", spawnRate); // 延迟 spawnRate 时间后再次调用 Spawn 方法 } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

3. 碰撞区域

最后,我们将在 Unity 中创建一个碰撞区域,用于检测粒子与特定区域的碰撞。当粒子进入碰撞区域时,将触发特定的事件,例如使粒子消失或触发特效。

// KillZone.cs 脚本 // 在 Unity 中创建碰撞区域,用于检测粒子与特定区域的碰撞 using System; using System.Collections; using System.Collections.Generic; using UnityEngine; public class KillZone : MonoBehaviour { private void OnTriggerEnter2D(Collider2D col) { col.gameObject.SetActive(false); } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

三、效果

四、总结

结合 OpenCV 和 Unity 可以实现许多有趣和创新的项目。通过利用 OpenCV 在 Unity 中的集成,我们可以创建出令人惊叹的图像处理和游戏开发应用程序。无论是学习者还是专业开发者,都可以从这种结合中受益,并创造出令人印象深刻的作品。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/不正经/article/detail/557470

推荐阅读

相关标签