- 1保证接口数据安全的10种方案_如何防止接口数据被抓包修改

- 2共词聚类分析

- 3前端中实现文件上传下载的三种解决方案(推荐)_下载文件请求的前端请求方法参数配置

- 4教你从零开始画echarts地图_echarts地图绘制路线

- 5【微信小程序】使用页面跳转并携带多个特定参数_微信小程序跳转页面参数传递

- 615.自动文摘和信息抽取_自动文摘提取

- 7Chainlit vs Streamlit和Gradio:为什么Chainlit是开发聊天机器人不错的选择

- 8用python创建一个简单的GUI程序,python小案例_python怎么创建文本gui

- 9Android Gradle plugin requires Java 11 to run. You are currently using Java 1.8的解决方案_a problem occurred evaluating project ':app'. > fa

- 10性能不降反增?缩减率2.64的伪图索引为何有助于RAG

AI领域中一个被严重低估的方向!

赞

踩

大模型出来之后,模型不变,但数据量日新月异,重新训练模型的时间成本和能量花费都是不可接受的。连续学习以其快速适应能力,以及对过去数据不做高要求的优势,成为大模型时代面向变化数据的主要学习方式。

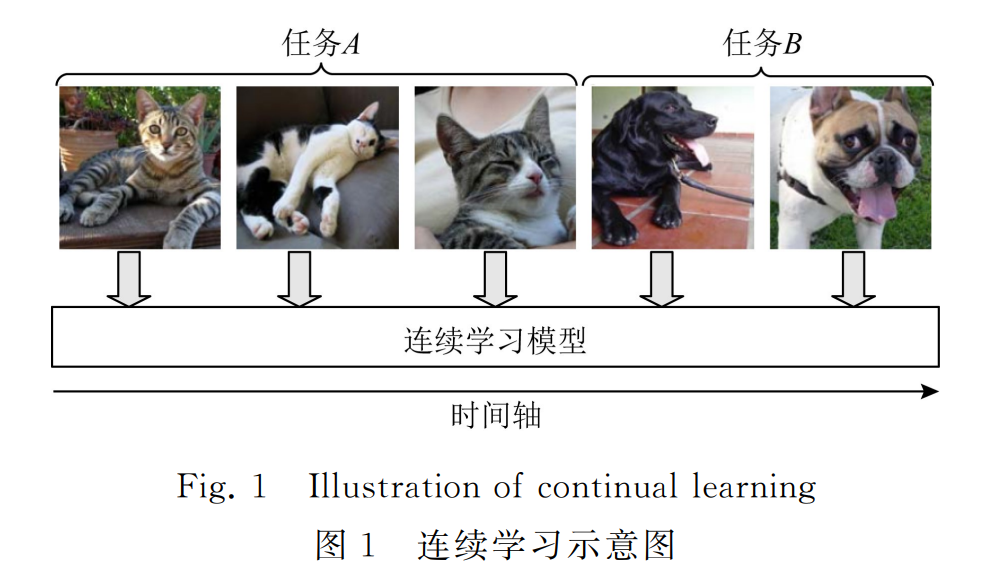

可持续人工智能中的核心研究之一就是连续学习(continual learning, CL),亦称为增量学习或终身学习,赋予了 AI 系统适应环境的能力。不同于过去大量的重复训练,连续学习通过不断地更新模型参数来适应不断变化的数据分布,从而不断提高模型的能力。在实际应用中,连续学习被广泛应用于图像识别、自然语言处理等领域,特别是在面对大规模数据时表现优异。连续学习,已经是通用人工智能不得不攻克的几个主要研究方向之一。

连续学习给科研从业者提供个很有价值的研究内容,有很多idea都可以被激发出来,有很多地方都可以赶紧占坑。

7月18日-7月20日,我们邀请到新加坡南洋理工博后、顶会审稿人Vank老师,来给大家分享——应对大模型灾难性遗忘|连续学习的趋势与创新点!

扫码免费预约直播课

免费领10篇持续学习前沿论文

免费领10篇持续学习前沿论文

讲师介绍—Vank

新加坡南洋理工博后

30+篇CCF和SCI,包括NeurIPS、CVPR、AAAI、TPAMI (影响因子24.314),TMM(影响因子8.182)等;

长期担任ICML、ICLR、NeurIPS、AAAI等多个顶级AI会议期刊的审稿人;

研究方向主要为机器学习(连续学习、多任务学习、小样本学习等)与计算机视觉(视觉分类分割、跨模态理解)等,注重产学研结合、相关研究工作在业界已落地。

有超5年指导低年级博士生、硕士生与本科生进行科研与发表论文的经验,指导多名本科或硕士生成功申请到海内外知名高校硕/博士。

直播大纲:

第1天:面向变化数据的学习范式

- 可持续人工智能

- 连续学习的定义

- 连续学习的挑战

- 一种简单易用的基准方法

第2天:3种经典的连续学习算法

- 模型结构法介绍

- 参数正则法介绍

- 记忆演练法介绍

第3天连续学习未来研究方向和热点

- 连续学习的变种

- 连续学习的应用

- 连续学习的可研究方向推荐

和人一样,学习新的知识后,过去学习的知识容易被遗忘。但对机器学习模型来说,这种遗忘是更加严峻的。灾难性遗忘是连续学习的主要挑战,面对灾难性遗忘,连续学习的主要方法可以被总结为以下几种主要方式。

记忆演练法:存储少量旧任务知识,和新任务一起重训练。特点:效果好、易实现,但需要额外存储空间。

参数正则法:根据先验知识,给模型参数的更新施加约束。特点:不存储任何信息,过度依赖正则化,效果较差;

模型结构法:各个任务设置不同参数路径,减少互相影响。特点:模型参数有限,参数路径易重叠无法持续增加。

3天直播中,我们将给大家详细介绍这3种经典的连续学习算法、优劣势比较以及不同情况下的适用方法,全是干货内容,千万别错过!

扫码免费领持续学习前沿论文

作为一个科研小白,怎么发表一篇连续学习相关的优质论文?

为了论文,大家都在努力地设计新网络、新策略、新training算法,只要能够在某一问题上做到一个很好的performance,论文就水到渠成。而想要快速达到,来自前辈的指点不可或缺。

一个好的指导老师的作用是,没有课题,能够结合所在课题组具体情况,结合最近热门研究方向,帮你规划课题,如果有了课题而缺少创新方向,老师能够快速帮你找到几种切入点,几种框架,甚至连需要读哪些文献都帮你想好了......

扫码免费预约直播课

免费领10篇持续学习前沿论文

扫码免费领课程资料

-END-