- 1Springboot事务的7种传播行为_springboot事务传播行为

- 2数据结构和算法概述_og希冀平台数据结构与算法

- 3博弈树 极小极大分析法_极大极小分析法

- 4JSP眼镜销售系统购物系统jsp购物系统购物商城系统源码(jsp电子商务系统)网上眼镜在线销售_眼镜商城前端源码

- 5高效工作|Raycast一款可以取代Spotlight的快捷启动器_raycast中文版

- 6【云开发】小程序端操作数据库详解_小程序数据库

- 7vue项目依赖安装报错:Error: pngquant failed to build, make sure that libpng-dev is installed

- 8react-native 调用Settings.Secure.getstring获取了android_id / app上架违规获取android_id被拒_com.learnium.rndevicelnfo.rndevicemodule.getunique

- 9项目管理电子书_电子书丨决胜B端:产品经理升级之路

- 10修改Spark的日志级别_spark standolne 任务设置日志级别

Spark与Flink对比_presto 和flink

赞

踩

Spark缺点

无论是 Spark Streaming还是 Structured Streaming,

Spark流处理的实时性还不够,所以无法用在一些对实时性要求很高的流处理场景中。

这是因为 Spark的流处理是基于所谓微批处理( Micro- batch processing)的思想,即它把流

处理看作是批处理的一种特殊形式,每次接收到一个时间间隔的数据才会去处理,所以天生很难在实时性上有所提升。

虽然在 Spark2.3中提出了连续处理模型( Continuous Processing Model),但是现在只支持

很有限的功能,并不能在大的项目中使用。 Spark还需要做出很大的努力才能改进现有的流处理模型想要在流处理的实时性上提升,就不能継续用微批处理的模式,而要想办法实现真正的流处理即每当有一条数据输入就立刻处理,不做等待。

Flink

采用了基于操作符(Operator)的连续流模型,可以做到微秒级别的延迟。

Flink 核心模型简介

Flink最核心的数据结构是Stream,它代表一个运行在多分区上的并行流。

在 Stream 上同样可以进行各种转换操作(Transformation)。与 Spark 的 RDD 不同的是,Stream 代表一个数据流而不是静态数据的集合。所以,它包含的数据是随着时间增长而变化的。而且 Stream 上的转换操作都是逐条进行的,即每当有新的数据进来,整个流程都会被执行并更新结果。这样的基本处理模式决定了 Flink 会比 Spark Streaming 有更低的流处理延迟性。

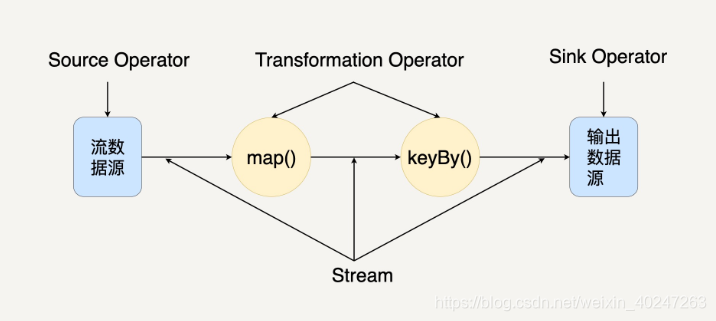

当一个 Flink 程序被执行的时候,它会被映射为 Streaming Dataflow,下图就是一个Streaming Dataflow 的示意图。

在图中,你可以看出Streaming Dataflow 包括Stream和Operator(操作符)。转换操作符把一个或多个Stream 转换成多个Stream。每个Dataflow都有一个输入数据源(Source)和输出数据源(Sink)。与Spark的RDD转换图类似,Streaming Dataflow也会被组合成一个有向无环图去执行。

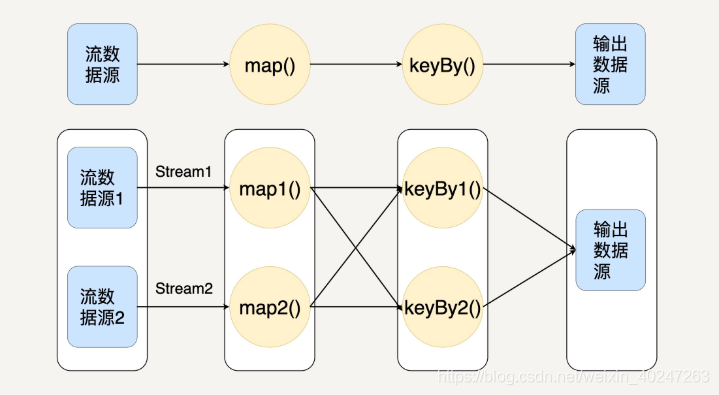

在Flink中,程序天生是并行和分布式的。一个Stream可以包含多个分区(Stream Partitions),一个操作符可以被分成多个操作符子任务,每一个子任务是在不同的线程或者不同的机器节点中独立执行的。如下图所示:

从上图你可以看出,Stream在操作符之间传输数据的形式有两种:一对一和重新分布。

- 一对一(One-to-one):Stream维护着分区以及元素的顺序,比如上图从输入数据源到map间。这意味着map操作符的子任务处理的数据和输入数据源的子任务生产的元素的数据相同。你有没有发现,它与RDD的窄依赖类似。

- 重新分布(Redistributing):Stream中数据的分区会发生改变,比如上图中map与keyBy之间。操作符的每一个子任务把数据发送到不同的目标子任务。

Flink的架构

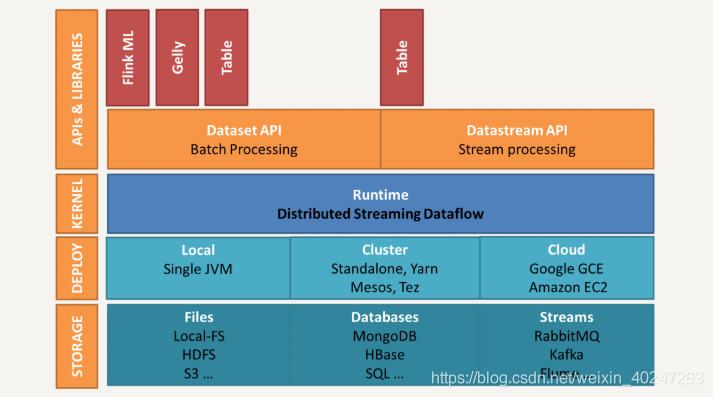

当前版本Flink的架构如下图所示

这个架构和Spark 架构比较类似,都分为四层:存储层、部署层、核心处理引擎、high-level的API和库。

- 从存储层来看,Flink 同样兼容多种主流文件系统如HDFS、Amazon S3,多种数据库如HBase和多种数据流如Kafka和Flume。

- 从部署层来看,Flink不仅支持本地运行,还能在独立集群或者在被YARN或Mesos管理的集群上运行,也能部署在云端。

- 核心处理引擎就是我们刚才提到的分布式Streaming Dataflow,所有的高级API及应用库都会被翻译成包含Stream和Operator的Dataflow来执行。

Flink 提供的两个核心API就是DataSet APl和DataStream APl。你没看错,名字和Spark的DataSet、DataFrame 非常相似。顾名思义,DataSet代表有界的数据集,而DataStream代表流数据。所以,DataSet API是用来做批处理的,而DataStream API是做流处理的。

也许你会问,Flink 这样基于流的模型是怎样支持批处理的?在内部,DataSet 其实也用Stream表示,静态的有界数据也可以被看作是特殊的流数据,而且DataSet与DataStream 可以无缝切换。所以,Flink的核心是DataStream。

Flink 和 Spark 对比

通过前面的学习,我们了解到,Spark和Flink都支持批处理和流处理,接下来让我们对这两种流行的数据处理框架在各方面进行对比。首先,这两个数据处理框架有很多相同点。

- 都基于内存计算;

- 都有统一的批处理和流处理APl,都支持类似SQL的编程接口;

- 都支持很多相同的转换操作,编程都是用类似于Scala Collection APl的函数式编程模式;

- 都有完善的错误恢复机制;

- 都支持Exactly once的语义一致性。

当然,它们的不同点也是相当明显,我们可以从4个不同的角度来看。

- 从流处理的角度来讲,Spark基于微批量处理,把流数据看成是一个个小的批处理数据块分别处理,所以延迟性只能做到秒级。而Flink基于每个事件处理,每当有新的数据输入都会立刻处理,是真正的流式计算,支持毫秒级计算。由于相同的原因,Spark只支持基于时间的窗口操作(处理时间或者事件时间),而Flink支持的窗口操作则非常灵活,不仅支持时间窗口,还支持基于数据本身的窗口(另外还支持基于time、count、session,以及data-driven的窗口操作),开发者可以自由定义想要的窗口操作。

- 从SQL 功能的角度来讲,Spark和Flink分别提供SparkSQL和Table APl提供SQL

- 交互支持。两者相比较,Spark对SQL支持更好,相应的优化、扩展和性能更好,而Flink在SQL支持方面还有很大提升空间。

- 从迭代计算的角度来讲,Spark对机器学习的支持很好,因为可以在内存中缓存中间计算结果来加速机器学习算法的运行。但是大部分机器学习算法其实是一个有环的数据流,在Spark中,却是用无环图来表示。而Flink支持在运行时间中的有环数据流,从而可以更有效的对机器学习算法进行运算。

- 从相应的生态系统角度来讲,Spark 的社区无疑更加活跃。Spark可以说有着Apache旗下最多的开源贡献者,而且有很多不同的库来用在不同场景。而Flink由于较新,现阶段的开源社区不如Spark活跃,各种库的功能也不如Spark全面。但是Flink还在不断发展,各种功能也在逐渐完善。

如何选择Spark和Flink

对于以下场景,你可以选择 Spark。

- 数据量非常大而且逻辑复杂的批数据处理,并且对计算效率有较高要求(比如用大数据分析来构建推荐系统进行个性化推荐、广告定点投放等);

- 基于历史数据的交互式查询,要求响应较快(impala,或者presto更优秀);

- 基于实时数据流的数据处理,延迟性要求在在数百毫秒到数秒之间。

Spark完美满足这些场景的需求,而且它可以一站式解决这些问题,无需用别的数据处理平台。由于Flink是为了提升流处理而创建的平台,所以它适用于各种需要非常低延迟(微秒到毫秒级)的实时数据处理场景,比如实时日志报表分析。

而且Flink 用流处理去模拟批处理的思想,比Spark 用批处理去模拟流处理的思想扩展性更好。