- 1微店前端面试题,基于javaweb(springboot,涂鸦智能java校招面试题

- 2华为交换机端口隔离看这一篇文章就行了

- 3约瑟夫环(循环数组&&循环链表)_循环链表抽奖

- 4openWebUI+ollama&windows+不用docker+webLite本地安装_windows server安装open webui

- 5小小字符串竟然如此嚣张 —— 聊聊 Java 的 String

- 6单身狗福音?Java程序员教你 new 一个女朋友?

- 7【C++】类与对象(取地址操作符)_c++类的对象取址

- 8java LintCode 627.最长回文串

- 9【MySQL精通之路】InnoDB存储引擎

- 10PydanticUserError - 使用langchain调用qwen时出错

全球机器学习技术大会盛大开幕!大模型的演进与 AI 创新之路

赞

踩

生成式 AI 技术发展迅猛,大模型刷新一切,开发者如何更快、更好地拥抱未来?

作者 | 《新程序员》编辑部

出品 | AI 科技大本营(ID:rgznai100)

4 月 25 日,CSDN 联合高端 IT 咨询与教育平台 Boolan 举办的ML-Summit 2024 全球机器学习技术大会在上海环球港凯悦酒店盛大开幕。大会核心聚焦大模型技术演进、多模态、大模型工程与架构、GenAI 产品创新与探索、AI Infra 等开发者们核心关注的 AI 前沿技术,共设置了 12 大技术专题,邀请了微软、阿里、百度、智谱、百川、零一万物、智源、面壁智能、小米、北大、复旦、eBay、恒生电子、达观、金山、度小满、曙光、元戎、PPIO 等领先企业及组织的技术大咖与专家学者,直击大模型的最新技术趋势及痛点问题,深入分享大模型技术实践及应用落地案例与实战经验。

全场座无虚席,爆满程度超乎想象!嘉宾分享干货满满,让参会者受益匪浅,意犹未尽!

聚焦大模型技术创新与落地,共赴 AGI 新时代!

上午 9 点,CSDN 高级副总裁、Boolan 首席技术专家李建忠为大会带来主题为《AGI 2024 技术创新研究与思考:大模型驱动的计算产业范式转换 》的开场演讲。他指出,大模型在整个计算产业链中引发持续的轰动效应,是因为它带来了计算范式、开发范式、交互范式共三大范式转换。

李建忠 CSDN 高级副总裁、Boolan 首席技术专家

首先是计算范式的转换,包括体系架构和任务模型两大方面,计算的体系架构会从图灵-冯诺依曼计算架构转为神经网络计算架构,计算的任务模型则从围绕“存取、计算、显示”为中心的检索模型转为围绕“学习、预测、生成”为中心的生成模型。

在开发者关注的开发范式方面,李建忠表示,大模型驱动的开发范式正在从传统命令编程、当前的大模型辅助软件开发,到未来面向模型(神经网络)的编程演进。其中,针对大模型辅助软件开发,李建忠提出“五级自动软件开发”参考框架,将软件开发智能化程度分为五级 L1~L5。其中,李建忠特别提到 AI 智能体的关键作用——“智能从来不是一步到位的,它不仅仅是认知和创造,更是规划、迭代、协作和使用工具”。在面向模型(神经网络)编程方面,李建忠表示未来的编程将跳出高级语言、编译/链接、执行这样的传统过程,逐步转变为收集训练数据并设定训练目标,将数据集、目标设置、架构设置通过编译过程转换为表示神经网络权重、前馈过程的二进制语言,这是对软件开发更大的颠覆式转换。

在交互范式的变革方面,李建忠谈到今年最大的变化是多模态的发展,自然语言交互界面(LUI)和多模态合力将在未来为终端应用交互带来全新体验,将计算的潜力释放到更广泛的人类 。在谈到 Sora 的成功时,李建忠指出 OpenAI 创新性地选择了“通用可扩展”的 Diffusion Transformer 路线,包括使用 Patch 来统一各种视觉数据的“元表示”,这些技术创新的底层原因是 OpenAI 坚持 Scaling Law 的技术信仰,选择适配“可扩展”的技术路线。

演讲最后,李建忠总结道,计算、开发与交互的三大范式转换,将深刻影响计算产业的未来,包括基础设施、开发流程和应用形态。

国际知名语音识别专家、Kaldi 之父、IEEE Fellow、小米集团首席语音科学家 Daniel Povey 博士站在 AI 整个历史长河的发展中看待当下 LLM 技术,他表示,AI 的发展是个漫长的过程,没有终点。

Daniel Povey,Kaldi 之父、IEEE Fellow、小米集团首席语音科学家

在 Daniel Povey 看来,ChatGPT 等大模型产品的流行能让人们学到很多自然语言和 AI 知识,这些模型的训练往往只基于一个预测损失函数,而增加模型规模和训练数据大小能进一步提高模型性能。基于此,Daniel 在现场为开发者深入分享了他及新一代 Kaldi 团队在机器学习研究及实践中的最新成果,包括声学编码器 Zipformer、神经网络优化器 ScaledAdam 以及全新的标准化模块 BiasNorm 等。

模型更迭迅猛,未来充满未知,Daniel Povey 给出了他的答案。他表示未来的模型会更注重处理预测其他事物的信息,尤其是跨模态的信息,如文本与图像。面对业内所热议的 AI 是否会取代部分劳动力的问题,Daniel 这样讲道:“纵观历史,人们总是因自动化会导致工作岗位被摧毁而感到恐慌,但从长远来看,似乎并没有造成问题,因为总会有新的工作出现。”

不过,Daniel Povey 担心的是,人们会越来越依赖那些集中化、复杂且脆弱的系统。这将带来巨大的安全隐患,比如一个黑客或一个简单的漏洞,可能会导致某个供应商的所有自动驾驶汽车全部停止,有可能直接导致整个国家甚至全球的交通瘫痪。

在复旦大学教授、眸思大模型负责人张奇看来,“大语言模型是实现 AGI 的必由之路吗?”这近乎是一个哲学问题,如果大模型是 AGI 的必由之路,那么现阶段场景、任务、领域模型可能都毫无意义;如果大模型不是 AGI 的必由之路,那么我们需要重新思考和定位通用大模型的研究意义。因此,对这个问题如何认知,也将走向截然不同的道路。

张奇,复旦大学教授、眸思大模型负责人

张奇表示,“推理能力”是 AGI 的核心,而推理能力又包含了演绎推理和归纳推理、溯因推理。在演绎推理方面,从科学数据来看,ChatGPT 和 GPT-4 都擅长解决著名的逻辑推理阅读理解基准,但是大模型对于分布外数据集处理仍有待提高。在实验中通过检索、分类、比较、逆向搜索四种能力来衡量大模型对知识运用能力时,我们发现,语言模型难以完成比较和分类任务,也无法进行逆向知识搜索,除非知识以逆序出现在预训练数据中。最终,张奇教授得出一个结论:演绎推理作为单独任务可以优化,但演绎推理能力在其他任务中并不能自动获得。在归纳推理维度,目前行业中的大模型在任务复杂程度增大时,准确率接近为 0,且训练过程中简单加入过程作用也十分有限。

整体而言,大模型的能力的产生首先源于在预训练阶段构建了大量基础的知识,将知识压缩和表示学习,进而通过指令微调,将能力注入,最后基于奖励函数、强化学习将生成任务能力提升。其实大模型的任务能力并非一开始就具备,而是后期不断叠加上去的。需要注意的是,由于任务的不断叠加,会使得一些任务能力下降。所以,叠加任务能力和保持质量方面也会存在一定的冲突。

张奇认为,大模型可以很快速地在很多任务上做到 70 分,然而基于大模型在任何任务上完成 90 分却是十分困难的。只是简单增大数据量无法实现效果增加,未来标注数据的准确程度要求会十分苛刻。对此,他建议道,“忘记 AGI、涌现、对齐、激发 …”等网红术语,可以从统计机器学习角度“再出发”。

2023 是百模大战的一年,而进入到 2024 显然是多模态与大模型产品落地的关键一年。大会现场,水木分子联合创始人和首席技术官乔木博士为我们带来了《多模态生物医药大模型及其行业应用》的主题演讲。乔木表示,时下”通用大模型底座 + 行业大模型 + 行业 Killer App“共同构成了 AI 时代操作系统,而当前大模型产业已经从上半场的通用能力建设演进至下半场的行业应用。

乔木,水木分子联合创始人和首席技术官

以其身处的生物医药领域为例,乔木认为,这一领域还存在海量多模态数据价值亟待挖掘,如药物小分子、蛋白质序列数据以及单细胞数据,以及诸多的知识图谱和超过 1.15B 文献、专利等。为了探索生物、化学、环境、材料不同行业的模型实践,水木分子与清华大学智能产业研究院合作共同推进 AI4S(AI for Science)科学研究,也联合开源 BioMedGPT 生物医药科研基础模型,统一生物编码语言、化学分子语言与自然语言。

此外,水木分子还带来了新一代对话式药物研发助手 ChatDD (Drug Design) ,重新定义药物研发模式,同时也发布其商业化的全球首个千亿参数生物医药多模态大模型 ChatDD-FM 100B。最终激发大模型在生物医药的管线战略情报、商业价值评估、专利分析等多场景下的潜力。

高峰对话:大模型的演进与 AI 创新之路

今年上午主会压轴的圆桌对话环节中,CSDN 高级副总裁、Boolan 首席技术专家李建忠,Kaldi 之父、IEEE Fellow、小米集团首席语音科学家 Daniel Pove,复旦大学教授、眸思大模型负责人张奇,水木分子联合创始人和首席技术官乔木在 Athena labs CTO 王兴明的主持下,围绕“大模型的演进与 AI 创新之路”展开深度的探讨与经验分享,同时也为与会者们进行精彩的答疑。

对于过去一年大模型的发展,令李建忠印象深刻的主要有两件事,一是 Sora 的架构和 GPT 一样继续遵循 Scaling Law,具有极强的扩展能力,并且在大规模数据上训练时展现出了惊人的“涌现能力”,而无需对三维空间、物理规律等进行规则化引导。另一个是 AI Agent 智能体的快速发展,进一步实现软件开发的高度自动化。

Daniel Povey 谈到大模型中语音领域的应用时表示,AI 同传并不会很快走进现实,机器无法精准预测人们下一步所表达的内容。他觉得扩散模型是未来值得关注的领域。

“大型模型的泛化能力是当前备受关注的焦点之一”,乔木博士指出,如何更有效地理解专业领域的信息,是许多垂直领域模型的关注点。通用大模型要想解决专业领域内有深度,有难度的问题,同样需要提升专业能力。

乔木表示,“对于BI 和专利法律等问题挑战,不仅在生物医药领域存在,同时也在金融等其他领域也存在。我们需要进一步提升通用大模型在专业领域的适用性,或者开发针对各行业的垂直大模型,以帮助用户获取特定领域的知识。这些解决方案应该具有通用性,能够面向不同的用户。因此,对于通用大模型而言,如何在不同的行业发挥作用,对其泛化能力提出了更高的要求。”

面对开发者提出的“在实际应用中,大型模型的推理能力一定程度上还是基于概率统计的思路进行的,而如何探索出大模型推理的可行性路径”的痛点难题,张奇根据时下大型模型已经具备的四个能力给出了自己的建议:

1. 长文本建模能力:过去,token 受限于 512 的长度,长文本建模较为困难。现在,我们可以利用更大规模的模型,至少做到支持 4k、8k 来进行更好的长文本建模。

2. 更好的语义表示:大规模训练后,模型语义表示能力得到了大幅提升。

3. 多任务处理(multitask)能力:尽管挑战不小,但通过多任务学习,可以混合处理工作任务。

4. 多语言处理能力:现在多语言处理相对容易,大型模型已能胜任。

如果在工作中的任务可以往这四个方面发力,推理成功可能性较大。

多个主题专场同步并行,参会嘉宾热情高涨

多模态大模型、代码赋能软件变革、大模型+行业落地实践、GenAI 产品创新与探索等主题专场在今日下午同步举行。微软首席应用科学家经理黄寓凡、阿里巴巴通义实验室资深算法总监李永彬、百度 Comate 架构师张立理、蚂蚁集团 AI Infra 技术专家王勤龙、零一万物联合创始人潘欣、新浪微博新技术研发负责人张俊林、恒生电子 AI 首席技术专家林金曙、智源基础语言模型与软件组负责人刘广、元戎启行副总裁、技术合伙人刘轩、MiniMax 技术总监星龙、潞晨科技副总裁李彤、PPIO 联合创始人&CTO 王闻宇、智谱 AI-CodeGeex 张鑫鹏、上海交通大学教授倪冰冰、南方科技大学统计与数据科学系讲席教授荆炳义等一线大模型产、学、研专家展开精彩分享。

4 月 26 日,微软、百度、阿里、网易、蚂蚁集团、eBay、金山办公、度小满、面壁智能、千芯科技、北京大学、复旦大学等近 30 位 AI 专家将围绕大模型应用落地、多模态、视频生成、代码生成等一系列精彩纷呈的主题陆续登场,满满的干货将给大家带来诸多启发和收获。

精彩花絮,赞助商展位人头攒动

在主会场之外的展厅中,元戎启行、曙光存储、金茂绿建、PPIO、支付宝小程序云、西云算力、容数信创、戴尔、英伟达等展位吸引了较多参会者的目光,现场热闹非凡!

向右滑动查看更多>

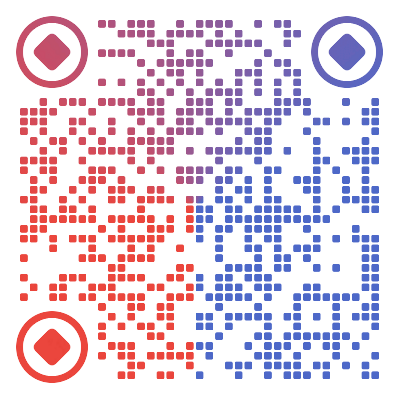

立即扫码预约全球机器学习技术大会PPT

↓↓ 点击「阅读原文」,了解「2024 全球机器学习技术大会」更多信息!