热门标签

热门文章

- 1【华为OD】手撕代码:求大写英文字母的字符串S所有不相同排列数 python代码实现[思路+代码]_华为od手撕代码python

- 2适合android手机 pdf阅读器,手机版pdf阅读器有哪些 这五款软件一定有适合你的

- 3大数据导论(四:大数据的存储)_大数据存储

- 4 Vert.x Blueprint 系列教程(三) | Micro-Shop 微服务应用实战

- 5Python 实战 | 文本分析之文本关键词提取_python中文自然语言处理基础与实践自动提取文本关键词编程实现

- 6Fiddler如何抓取手机APP数据包_fiddler抓手机的包

- 7软件测评师之报考大纲(一)

- 8使用redis进行短信登录验证(验证码打印在控制台)_如何利用redis去实现短信验证码登录-6位随机数,90s有效,一个手机号1个小时内只能

- 9java多线程——线程池源码分析(一)

- 10【项目管理】原则之六--展现领导力行为_项目 展现领导力原则

当前位置: article > 正文

Mamba v2诞生:2 那些烧脑的矩阵们_mambav2

作者:寸_铁 | 2024-07-18 17:06:06

赞

踩

mambav2

大模型技术论文不断,每个月总会新增上千篇。本专栏精选论文重点解读,主题还是围绕着行业实践和工程量产。若在某个环节出现卡点,可以回到大模型必备腔调或者LLM背后的基础模型新阅读。而最新科技(Mamba,xLSTM,KAN)则提供了大模型领域最新技术跟踪。若对于具身智能感兴趣的请移步具身智能专栏。技术宅麻烦死磕AI架构设计。

Mamba的出现为带来了全新的思路和可能性,通过对结构化半可分离矩阵的各种分解方法的理论研究,可以将状态空间模型SSM与注意力机制Attention的变种进行紧密关联,进而提出一种状态空间对偶SSD的理论框架。

状态空间对偶使得研究人员设计一种新的架构 (Mamba-2),其核心层是对 Mamba(选择性SSM)进行改进,速度提高了2-8倍,同时在语言建模方面能够保持对Transformers的压力。

Mamba的矩阵表达式

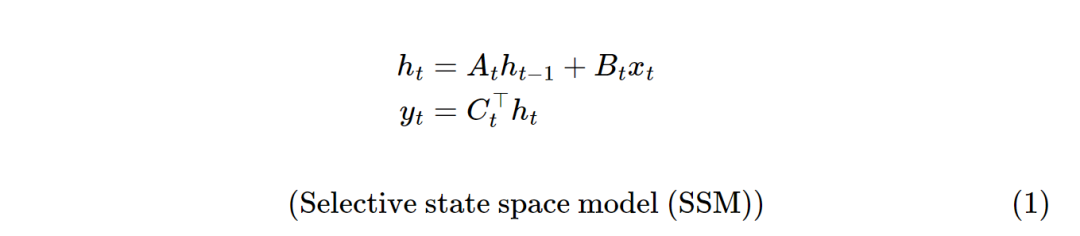

上一篇介绍了Mamba的概览,先来温习下Mamba-1模型公式:

其中xt为t时刻的输入,yt为t时刻的输出。定义的 本文内容由网友自发贡献,转载请注明出处:https://www.wpsshop.cn/w/寸_铁/article/detail/846797

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。