- 1移动开发最新面试就是你来我往,互相了解!,2024年最新2024最新Android面试笔试题目分享_移动it岗位面试

- 2Github网站进入及注册_github whoa there

- 3将Stanford CoreNLP的解析结果构造为json格式_nlp库是json格式吗

- 4如何json文件中读出和写入数据_json文件输入一个信息从而带出其他信息

- 5武装部三维电子沙盘系统设计说明_触摸式 三维电子沙盘系统 方案设计

- 6Simplify the Usage of Lexicon in Chinese NER跑论文代码遇坑及解决方法

- 7uniapp使用uni.request传递formData格式时报错_request:fail parameter `data`. expected object, st

- 8zookeeper分布式锁

- 9零投入,高回报:Llama3带你进入私有AI知识库时代_llama3本地知识库

- 10tcp慢开始(Slow-Start)、拥塞避免(Congestion Avoidance)、快重传(Fast Retransmit)和快恢复(Fast Recovery)_tcp slow start

RNN/LSTM (一) 实践案例_rnn简单实例

赞

踩

什么是RNN

阅读ytb视频莫烦: 什么是循环神经网络 RNN (深度学习)? What is Recurrent Neural Networks (deep learning)?。

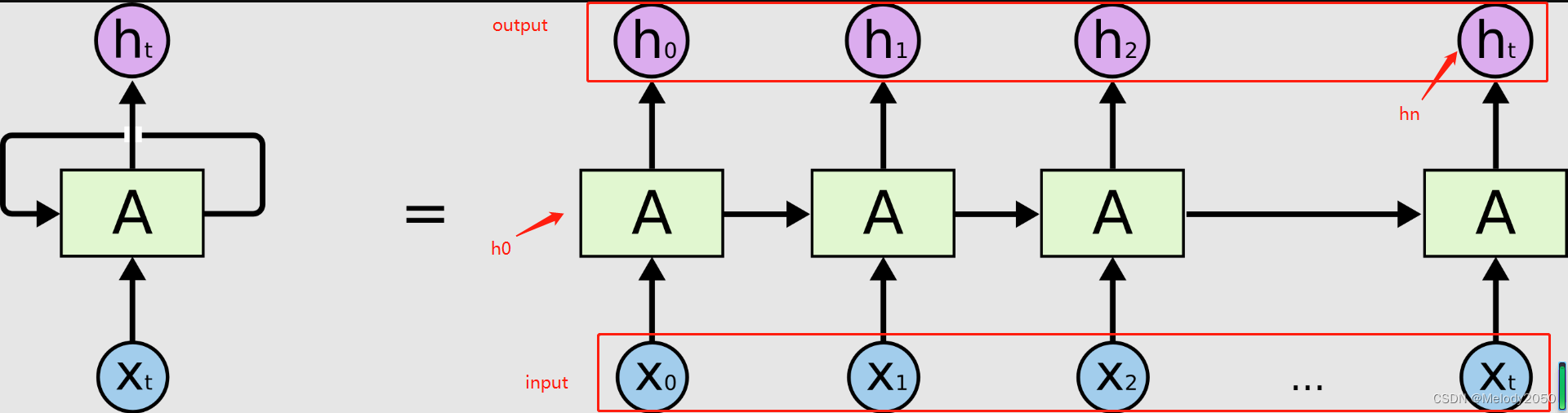

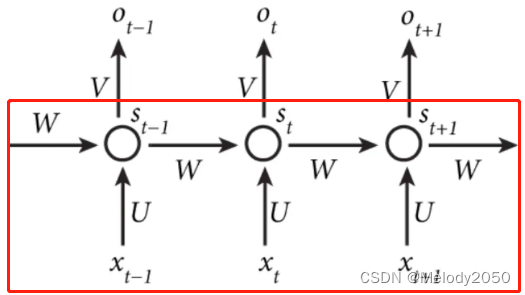

RNN工作原理图解

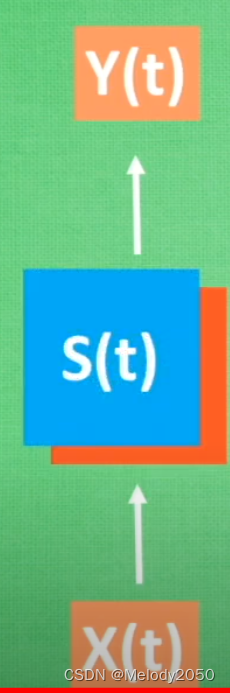

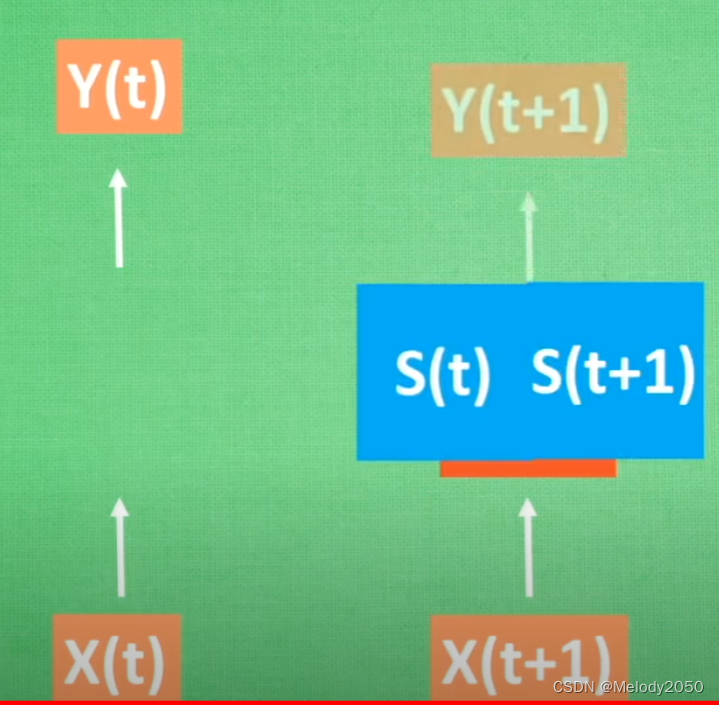

RNN是怎样工作的?假如在t时刻,神经网络输入x(t),神经网络会计算状态s(t),并输出y(t)。

到t+1时刻,输入为x(t+1),神经网络会根据s(t)和s(t+1)来输出y(t+1)。

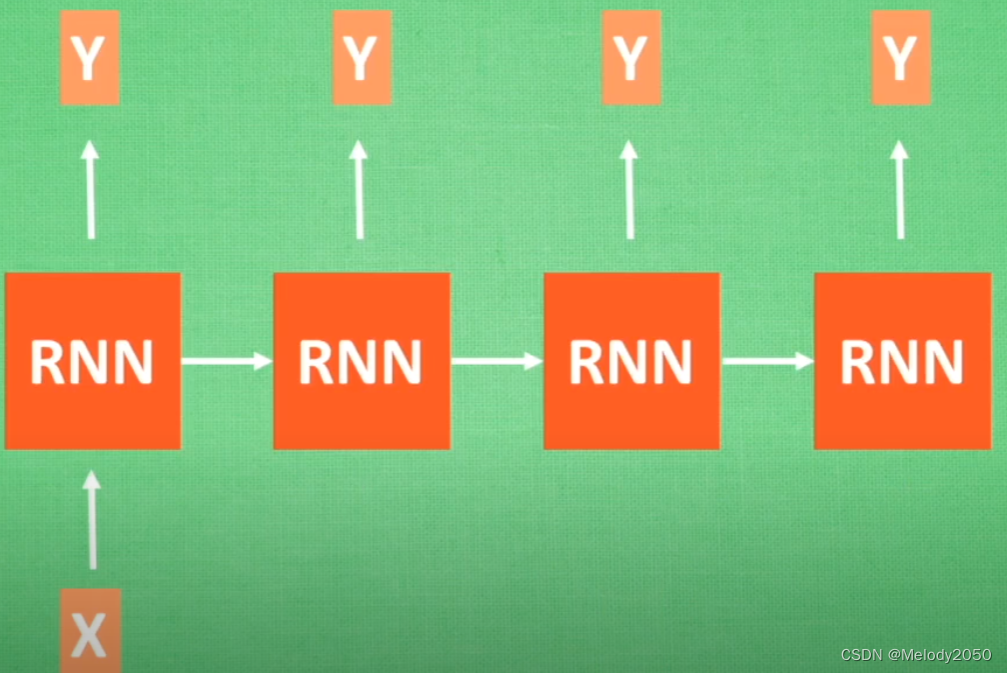

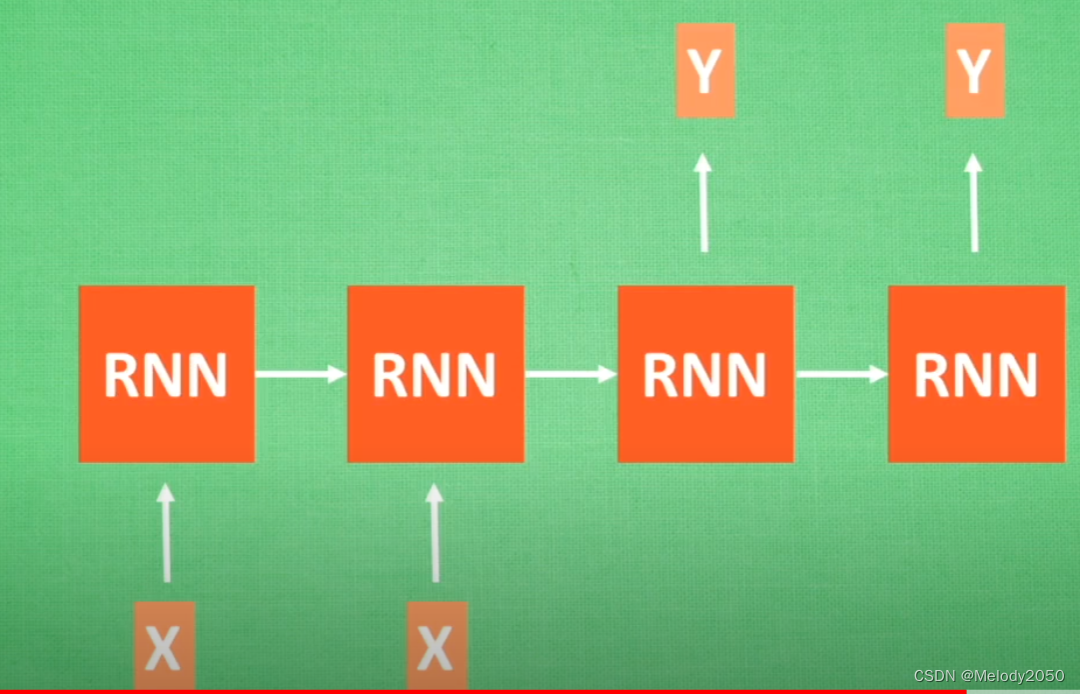

多种RNN形态

RNN经过适当组合,有不同的输入和输出形式,从而能解决不同领域的问题。比如输入一张图片,输出描述它的一段话。

或者输入一段中文,输出一段英文。

RNN的公式原理

传统RNN的实现主要是下图中的红框部分。

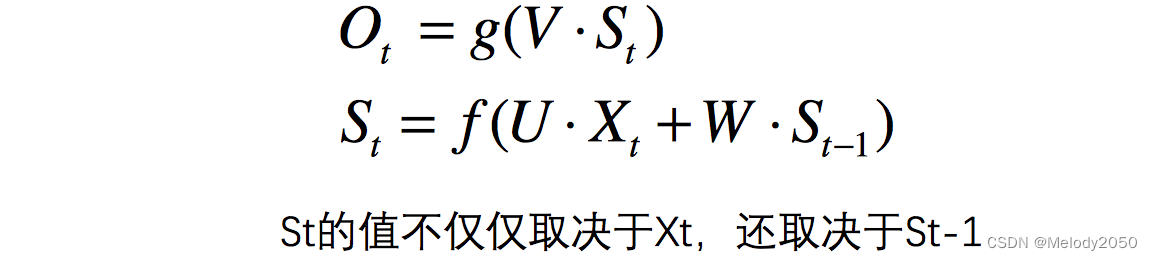

用公式表达如下:

其中

o

t

o_t

ot并不是最重要的部分,而输出

s

1

,

s

2

,

.

.

.

,

s

t

s_1, s_2, ..., s_t

s1,s2,...,st是关键。

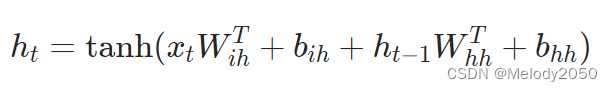

结合pytorch官方样例学习RNN

根据pytorch官方文档,torch.nn.RNN.html可知,RNN计算隐藏层的方式如下,相当于分别对上个隐藏层输出

h

t

−

1

h_{t-1}

ht−1与

x

t

x_t

xt作线性转换,相加后经过激活层tanh或relu。

我们结合代码案例,对这个API做简化版的解释

import torch

from torch import nn

rnn = nn.RNN(10, 20)

input = torch.randn(5, 3, 10)

h0 = torch.randn(1, 3, 20)

output, hn = rnn(input, h0)

# torch.Size([5, 3, 20])

# torch.Size([1, 3, 20])

# tensor(True)

print(output.shape)

print(hn.shape)

print(torch.all(output[-1] == hn))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

构造函数的参数简化版解释如下:

- input_size – The number of expected features in the input x

- hidden_size – The number of features in the hidden state h

所以 nn.RNN(10, 20):的意思是,输入的每个单词长度为10,输出的每个向量长度为20。另外,batch_first 参数默认为False,它会影响输入的维度顺序,当为False时,输入维度是(seq, batch, feature),为True时是(batch, seq, feature)。

输入的参数简化版解释如下:

输入: input, h_0

- input:

batch_first默认为False时,维度为(seq, batch, feature) - h_0: 在本例默认其它参数情况下,维度为(1, batch, feature)

所以,代码块中的input和h0变量分别代表各个时刻t的输入,以及初始的隐藏层状态。

输出的参数简化版解释如下:

输出: output, h_n

- output: 在其它参数默认时,维度为(sequence, batch, H o u t H_{out} Hout)。它代表每个时刻t的隐藏层输出 h 1 , h 2 , . . . , h T h_1, h_2, ..., h_T h1,h2,...,hT。

- h_n: 在其它参数默认时,维度为(1, batch, H o u t H_{out} Hout),它代表最后时刻T的隐藏层输出 h t h_t ht。

所以,代码块中output的维度是[5,3,20],其中batch是3,序列长度为5(有5个单词)。 而hn的维度是[1,3,20],每个batch都取了

h

T

h_T

hT。同时,print(torch.all(output[-1] == hn))输出为True说明hn就是output[-1],hn是最后时刻T的隐藏层输出。

总结而言,我们将一个batch为3,每句话有5个单词,每个单词向量长度为10的tensor输入到rnn。它将输出batch为3,每句话有5个单词,每个单词向量长度为20的变量output,其中hn是和output[-1]等价。在下图中标注了每个变量对应图中的部分。