- 1LNMP动态网站环境部署

- 2一款开源、简洁、支持全平台的高速下载神器

- 3git 新建分支并切换到该分支_Git 命令 - 分支与合并命令

- 4git整合分支的两种方法——合并(Merge)、变基(Rebase)_git变基和合并用哪个

- 5Vue3DraggableResizable知识点_vue-draggable-resizable

- 6【测试资源】测试新手可放心冲的几个学习网站,团队分享学习清单_学习接口测试可用的网站有哪些

- 7【ARM版银河麒麟安装windows应用程序】_银河麒麟安装wine

- 8固定资产管理系统建设方案_固定资产系统方案

- 9深入解析香橙派 AIpro开发板:功能、性能与应用场景全面测评_香橙派可以用来干嘛

- 10java算法:插入排序_快速排序算法

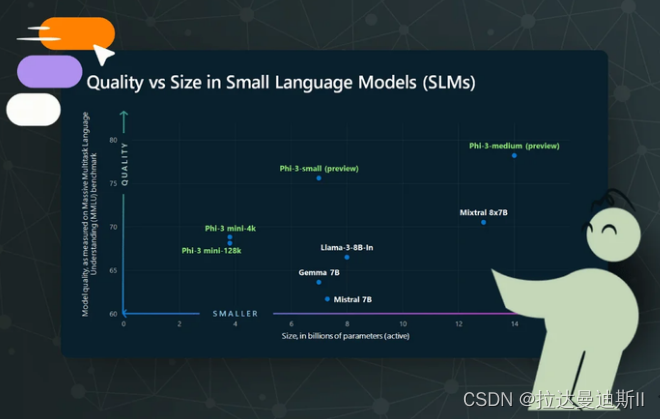

14-8 小型语言模型的兴起_14b的的语言大模型能否完成智能创作

赞

踩

过去几年,我们看到人工智能能力呈爆炸式增长,其中很大一部分是由大型语言模型 (LLM) 的进步推动的。GPT-3 等模型包含 1750 亿个参数,已经展示了生成类似人类的文本、回答问题、总结文档等能力。然而,虽然 LLM 的能力令人印象深刻,但它们庞大的规模导致效率、成本和可定制性方面的缺点。这为一种名为小型语言模型 (SLM) 的新兴模型类别打开了大门。

让我们深入了解小型语言模型的兴起:

- 什么是小语言模型?

- 开发小型语言模型的动机——效率、成本、可定制性

- 有用的语言模型可以有多小?

- 训练高效小语言模型的方法

- 小型语言模型大放异彩的示例应用

- 支持创建自定义 SLM 的开发人员框架

- 空间激光雷达发展与部署的未来机遇与挑战

最后,您将了解小型语言模型在以可定制和经济的方式将语言 AI 的强大功能带到更专业领域的前景。

什么是小语言模型?

语言模型是针对大型文本数据集进行训练的 AI 系统,可实现生成文本、总结文档、语言间翻译和回答问题等功能。小型语言模型可以满足大部分相同的需求,但模型大小明显较小。但小型语言模型由什么构成?

研究人员通常认为,参数少于 1 亿的语言模型相对较小,有些甚至会将参数限制在 1000 万或 100 万的较低阈值。相比之下,如今规模庞大的模型参数超过 1000 亿,例如上述 OpenAI 的 GPT-3 模型。

较小的模型尺寸使小型语言模型比最大的模型更高效、更经济、更可定制。然而,它们的整体能力较低,因为语言模型中的模型容量已被证明与尺寸相关。确定实际应用的最佳模型尺寸需要在灵活性和可定制性与纯粹的模型性能之间进行权衡。

小型语言模型的动机

如上所述,与大型语言模型相比,小型语言模型在效率、成本和可定制性方面具有先天优势。让我们更详细地分析一下这些动机:

效率

由于参数较少,小型语言模型在以下几个方面的计算效率明显高于 GPT-3 等大型模型:

- 由于每个输入需要执行的参数更少,因此它们的推理速度/吞吐量更快

- 由于整体模型尺寸较小,它们需要的内存和存储空间也较少

- 较小的数据集足以训练小型语言模型。随着模型容量的增长,对数据的需求也随之增长。

这些效率优势可直接转化为成本节省:

成本

大型语言模型需要大量的计算资源来训练和部署。据估计,OpenAI 开发 GPT-3 的成本约为数千万美元,包括硬件和工程成本。由于资源需求,当今许多公开的大型语言模型尚未盈利。

同时,小型语言模型可以很容易地在许多企业可用的商用硬件上进行训练、部署和运行,而无需花费太多资金。它们合理的资源需求开启了边缘计算的应用,它们可以在低功耗设备上离线运行。总的来说,短期内找到小型语言模型盈利应用的潜力更大。

可定制性

小型语言模型相对于大型语言模型的一个关键优势是可定制性。虽然 GPT-3 等模型在许多任务中表现出了强大的多功能性,但它们的功能仍然代表了一种在各个领域之间平衡性能的折衷解决方案。

另一方面,小型语言模型可以很容易地适应更狭窄的领域和专门的应用。凭借更快的迭代周期,小型语言模型使得通过以下方法尝试针对特定类型的数据定制模型成为可能:

- 预训练——在特定领域的数据集上启动小模型

- 微调——持续训练以优化最终任务数据

- 基于提示的学习——针对专门应用优化模型提示

- 架构修改——调整模型结构以适应特定任务

对于大型模型来说,这些定制过程变得越来越困难。小型语言模型不仅易于访问,还提供了开发人员可以根据其特定需求进行调整的规范。

有用的语言模型可以有多小?

考虑到上述最小化模型尺寸的动机,一个自然而然的问题出现了——我们可以将语言模型缩小到什么程度,同时仍然保持强大的功能?最近的研究继续探索完成不同语言任务所需的模型规模的下限。

许多研究发现,现代训练方法只需 100 万到 1000 万个参数就能让模型具备基本的语言能力。例如,2023 年发布的一个 800 万个参数的模型在既定的 GLUE 自然语言理解基准上达到了 59% 的准确率。

随着模型容量的增加,性能不断提高。 2023 年的一项研究发现,在从推理到翻译的各个领域,一旦语言模型达到约 6000 万个参数,不同任务的有用能力阈值就会一致通过。 然而,在 2 亿到 3 亿个参数规模之后,回报就会减少——增加额外的容量只会带来渐进的性能提升。

这些发现表明,即使是中型语言模型,只要接触到足够多的正确训练数据,也能在许多语言处理应用中达到合理的能力。然后,性能会达到一个平台期,在这个平台上,大量的计算和数据似乎没有提供什么额外的价值。商业上可部署的小型语言模型的最佳点可能就在这个平台期附近,在广泛的能力和精益的效率之间取得平衡。

当然,经过深度而非广泛调整的专门小语言模型可能需要更少的容量才能在小众任务中脱颖而出。我们稍后会介绍一些应用用例。但首先,让我们概述一下有效训练紧凑但功能强大的小语言模型的流行技术。

高效小型语言模型的训练方法

积极训练日益熟练的小型语言模型依赖于在学习过程中增强数据效率和模型利用率的方法。与大型模型的简单训练相比,这些技术最终为每个参数赋予了更多的能力。我们将在这里分解一些流行的方法:

迁移学习

大多数现代语言模型训练都利用了某种形式的迁移学习,其中模型通过首先在广泛的数据集上进行训练来引导能力,然后再专门针对狭窄的目标领域。初始预训练阶段将模型暴露给广泛的语言示例,这对于学习一般的语言规则和模式很有用。

尽管参数预算有限,但小型语言模型可以在预训练期间捕捉到这种广泛的能力。然后,专业化阶段可以针对特定应用进行细化,而无需扩大模型规模。总体而言,迁移学习大大提高了训练小型语言模型的数据效率。

自监督学习

迁移学习训练通常利用自监督目标,其中模型通过预测输入文本序列中被屏蔽或损坏的部分来发展基础语言技能。这些自监督预测任务可作为下游应用程序的预训练。

最近的分析发现,自监督学习似乎特别有效地赋予小型语言模型强大的能力——比大型模型更有效。通过将语言建模呈现为交互式预测挑战,自监督学习迫使小型模型从显示的每个数据示例中进行深度概括,而不是简单地被动地记住统计数据。这在训练期间可以更充分地利用模型容量。

架构选择

并非所有神经网络架构都具有同等的参数效率,可用于语言任务。精心选择架构可将模型容量集中在对语言建模至关重要的领域,例如注意力机制,同时剥离不太重要的组件。

例如,Efficient Transformers 已成为一种流行的小型语言模型架构,它在训练过程中采用了知识蒸馏等各种技术来提高效率。相对于基线 Transformer 模型,Efficient Transformers 实现了类似的语言任务性能,而参数减少了 80% 以上。有效的架构决策可以放大公司从有限规模的小型语言模型中提取的能力。

上述技术推动了快速发展,但如何最有效地训练小型语言模型仍有许多悬而未决的问题。随着小型语言模型扩展到新领域,确定模型规模、网络设计和学习方法的最佳组合以满足项目需求将继续让研究人员和工程师忙个不停。接下来,我们将重点介绍一些开始采用小型语言模型和定制 AI 的应用用例。

小型语言模型大放异彩的示例应用

尽管人们对人工智能的热情通常集中在吸引眼球的大型模型上,但许多公司已经通过部署根据其特定需求定制的小型语言模型找到了实用性。我将重点介绍一些代表性示例,例如金融和娱乐领域,在这些领域中,紧凑、专业的模型正在创造商业价值:

更多资讯,请访问 2img.ai

金融机构生成大量数字数据和文档,可以使用小型定制语言模型来提取见解。具有高投资回报率的用例包括:

- 交易分类器自动使用会计类别对发票项目进行编码,以加快输入簿记系统的速度。

- 情绪模型从收益电话会议记录中提取意见,通过检测管理层基调的变化来产生交易信号。

- 自定义实体有助于将非结构化银行对账单系统化为标准化数据报告业务收入,以进行贷款风险分析。

这些应用程序将语言人工智能转化为直接流程自动化,并改进现有财务工作流程中的分析能力——加速盈利模式,而不是仅仅猜测技术前景。风险管理在金融服务中仍然至关重要,更倾向于狭义的语言模型,而不是通用智能。

娱乐

随着创造性过程与先进技术的融合,媒体、游戏和相关娱乐垂直行业成为语言 AI 解决方案最具前瞻性的采用者:

- 小型语言模型利用自然语言生成,自动创建动画的初稿脚本或散文,创作者随后对其进行完善,从而大幅提高个人生产力。

- 在开放世界游戏中,对话模型会根据用户环境生成动态对话树,从而扩大虚拟现实范围内的交互自由。

- 更强大的语言分析功能丰富了娱乐元数据,例如通过字幕内容的模式识别电影主题,以便推荐引擎更好地将观众与他们的独特兴趣联系起来。

娱乐的创意空间为探索小型语言模型生成前沿提供了理想的试验台。尽管鉴于模型的局限性,当前的应用仍需监督,但小型语言模型的效率为开发人员提供了充足的空间来探索创意潜力。

ParagogerAI训练营 2img.ai

用于构建自定义 SLM 的开发人员框架

那么,既然前景如此光明,开发人员如何才能真正开始构建专门定制的小型语言模型呢?开源技术让企业跨领域、跨规模地实现定制语言 AI。以下全方位服务平台能够以经济高效的方式创建和部署定制的小型语言模型:

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。