热门标签

热门文章

- 1System.InvalidCastException:“无法将类型为“Microsoft.Office.Interop.Excel.ApplicationClass”的 COM 对象强制转换为接口类

- 2HTC vive pro & unity开发者软件/SDK版本注意事项_htc vive unity配置

- 3php毕业设计 基于php+mysql的在线购物商城毕业设计开题报告功能参考_php mysql navicat hbuilder购买系统开题报告

- 4UE蓝图 函数调用(CallFunction)节点和源码

- 5【毕业设计】基于微信小程序体育场地预约系统(源码+LW+部署+讲解)_基于微信小程序体育馆预约系统

- 6mysql 安装问题:由于找不到MSVCP120.dll,无法继续执行代码.重新安装程序可能会解决此问题。_mysql找不到msvcp120

- 7sdkmanager工具安装

- 8redis持久化失败问题(MISCONF Redis is configured to save RDB snapshots, but ......)问题解决

- 9计算机系统:EEPROM详解

- 10虚拟机Ubuntu18.04为Jetson AGX Xavier使用jetpack4.4刷机_agx orin装jetpack4。4

当前位置: article > 正文

qwen1.5 chat vllm推理使用案例;openai api接口使用_qwen1.5 vllm

作者:我家小花儿 | 2024-03-01 17:11:19

赞

踩

qwen1.5 vllm

参考:https://github.com/QwenLM/Qwen1.5

https://qwen.readthedocs.io/en/latest/quantization/awq.html

下载:https://huggingface.co/collections/Qwen/qwen15-65c0a2f577b1ecb76d786524

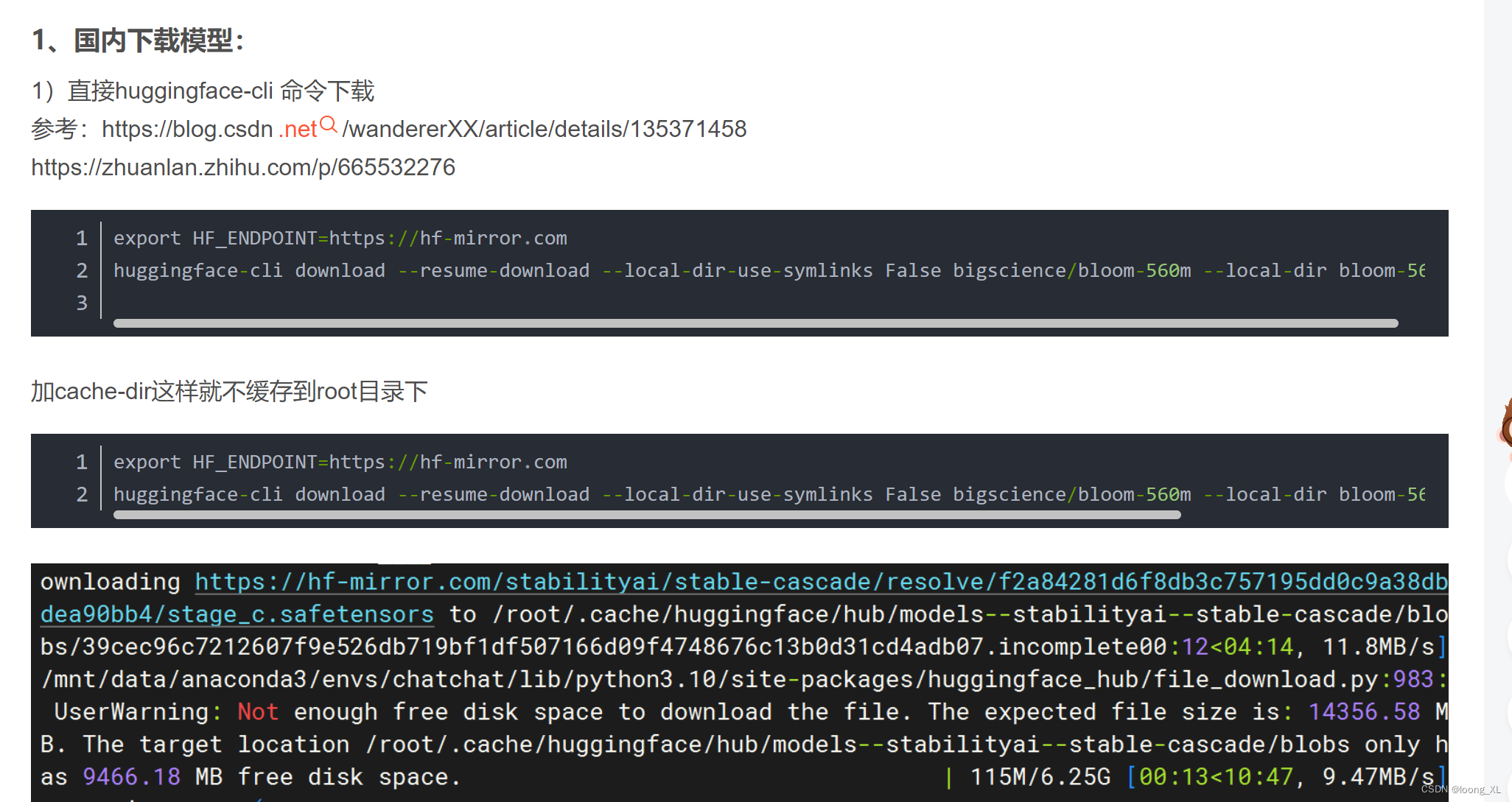

下载可以参考huggingface-cli 命令下载使用:https://blog.csdn.net/weixin_42357472/article/details/132663693

- 1

1、vllm运行

显卡驱动:NVIDIA-SMI CUDA Version: 12.0

cuda版本:

推荐阅读

相关标签