- 1有关神经网络的训练算法,神经网络训练过程详解_训练算法和神经网络的联系

- 2OpenHarmony开发板无法运行端云一体化项目的解决方案【坚果派-咸鱼】_replaceurl' can't support crossplatform applicatio

- 3文献学习-22-Surgical-VQLA:具有门控视觉语言嵌入的转换器,用于机器人手术中的视觉问题本地化回答

- 4NER任务语料_bosonnlp_ner_6c

- 5随身WIFI的刷机(debian系统)_随身wifi刷机

- 6excel if in函数_excel中if函数的使用技巧

- 7java中文转换拼音(HanLP)_java hanlp怎么把文字转全拼

- 8浅谈api工厂:前端Paas中台

- 9Transformer位置编码代码讲解_transformer时间戳编码

- 10一文带你了解爆火的Chat GPT_chatgpt csdn

千帆大模型平台的海量Prompt模板库,带来了什么?_百度千帆平台的开源平替

赞

踩

千帆大模型必看系列博客!

写在前面

2023年 AIGC 火爆全网之后,由于公司主要云服务都在百度智能云上,所以一直在关注文心一言的相关动作,忽然在某天上午,打开熟悉的百度智能云官网,出现了一个顶部通栏宣传图。

注意亮点:全面接入 Llama2 等33个大模型。

点击宣传图即 可进入申请体验,而且从 slogan 中可以很明确了解到该产品的用途。

千帆大模型平台:一站式企业级大模型平台,提供先进的生成式AI生产及应用全流程开发工具链。

提炼一下关键点:企业级大模型平台,全流程开发工具链。

这里大家要注意千帆大模型平台还是保守了,其实他是全球首个一站式的企业级大模型平台。

7月底8月初千帆大模型平台最新进展:

- 千帆大模型平台全面接入LLama2全系列、ChatGLM2-6B、RWKV-4-World、MPT-7B-Instruct、Falcon-7B等 33 个大模型,成为国内拥有大模型最多(可以在千帆有更多的选择)的平台。同时支持性能+安全的双重增强,模型推理成本可降低 50%。

- 千帆大模型平台上线国内最全预置 Prompt 模板,模板数量多达 103 个。包含对话、游戏、编程、写作等十余个场景。

一、千帆大模型平台介绍

百度智能云千帆大模型平台是面向企业开发者的一站式大模型开发及服务运行平台。千帆不仅提供了包括文心一言底层模型(ERNIE-Bot)和第三方开源大模型,还提供了各种 AI 开发工具和整套开发环境,方便客户轻松使用和开发大模型应用。

支持数据管理、自动化模型 SFT 以及推理服务云端部署的一站式大模型定制服务,助力各行业的生成式 AI 应用需求落地。

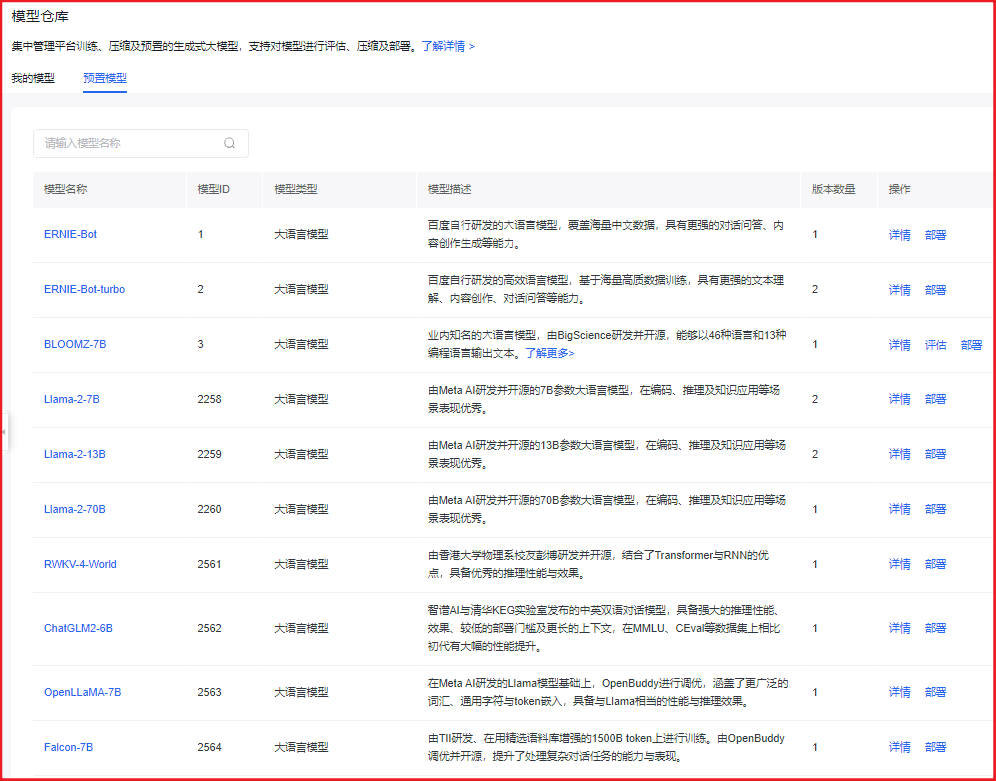

查看预置模型 33 个

登录到千帆大模型操作台,在左侧功能列模型管理中选择预置模型,即可查看平台预置模型列表。平台预置了33 款大语言模型供可直接使用,其中包括文心一言及业内知名的开源大模型,部分展示如下:

其中需要特别说明的是 Llama-2-7B 和 Llama-2-13B,每个模型都包含两个版本:

Llama-2-7B 版本如下

- Linly-Chinese-LLaMA-2-7B:由深圳大学CV研究所Linly项目进行中文增强训练的 7b 参数版本。

- Llama-2-7b-chat:由 Meta AI研发并开源,在编码、推理及知识应用等场景表现优秀,Llama-2-7b-chat是高性能版本。

Llama-2-13B 版本如下

- Linly-Chinese-LLaMA-2-13B:由深圳大学CV研究所Linly项目进行中文增强训练的 13b 参数版本。

- Llama-2-13b-chat:由 Meta AI 研发并开源,在编码、推理及知识应用等场景表现优秀,Llama-2-13b-chat是性能与效果均衡版本。

在这些模型中大家应该非常了解 Llama2,其强大的参数规模以及性能表现,对 OpenAI 带来了不小的压力,人称为“GPT-4最强平替”,而他现在已经被千帆大模型平台完全集成。

二、Prompt 模板库

接下来就是本篇文章最核心的部分了,在后续的实战中,真心感受到了千帆大模型平台中 Prompt 模板的诚意,因为他解决了我公司历史遗留下来的输入限制问题,你没看错,是输入限定。

Prompt 是伴随 AIGC 技术出现的大模型指令,它可以是一个问题、一段文字描述,甚至可以是带有一堆参数的文字描述。大模型会基于 Prompt 所提供的信息,生成对应的文本或者图片。

而 Prompt 工程即指针对于 Prompt 进行结构、内容等维度进行优化的AI技术,它把大模型的输入限定在了一个特定的范围之中,进而更好地控制模型的输出。

千帆大模型平台发布 103 款 Prompt 模板,包含对话、编程、电商、医疗、游戏、翻译、演讲等十余个场景。

这里面最值得点赞的是其集成了百度智能云在产业实践中积累的 Prompt 模板,还有文心一言高频用户的Prompt模板,千帆大模型平台给我们做好了筛选功能,在这种情况下,我们无需花费大量资源调优大模型,基于模板优化Prompt,就可以得到满意的模型效果。

下面我们使用预置Prompt模板【电影评论】,来对比一下使用前与使用后得到的 AI 答案。

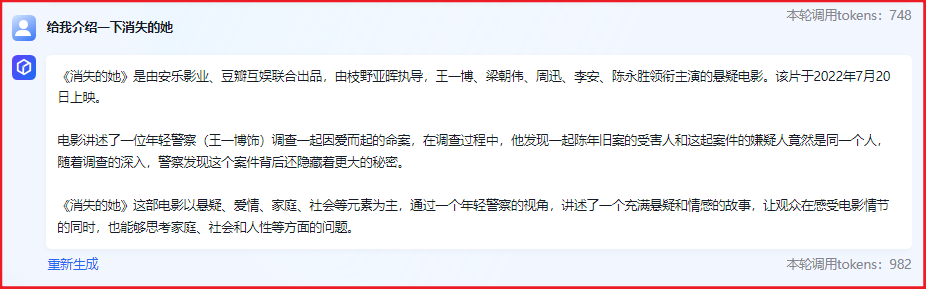

不使用 Prompt 模板,直接询问

使用功能直接在线测试,输入“给我介绍一下消失的她”,得到输出内容如下所示:

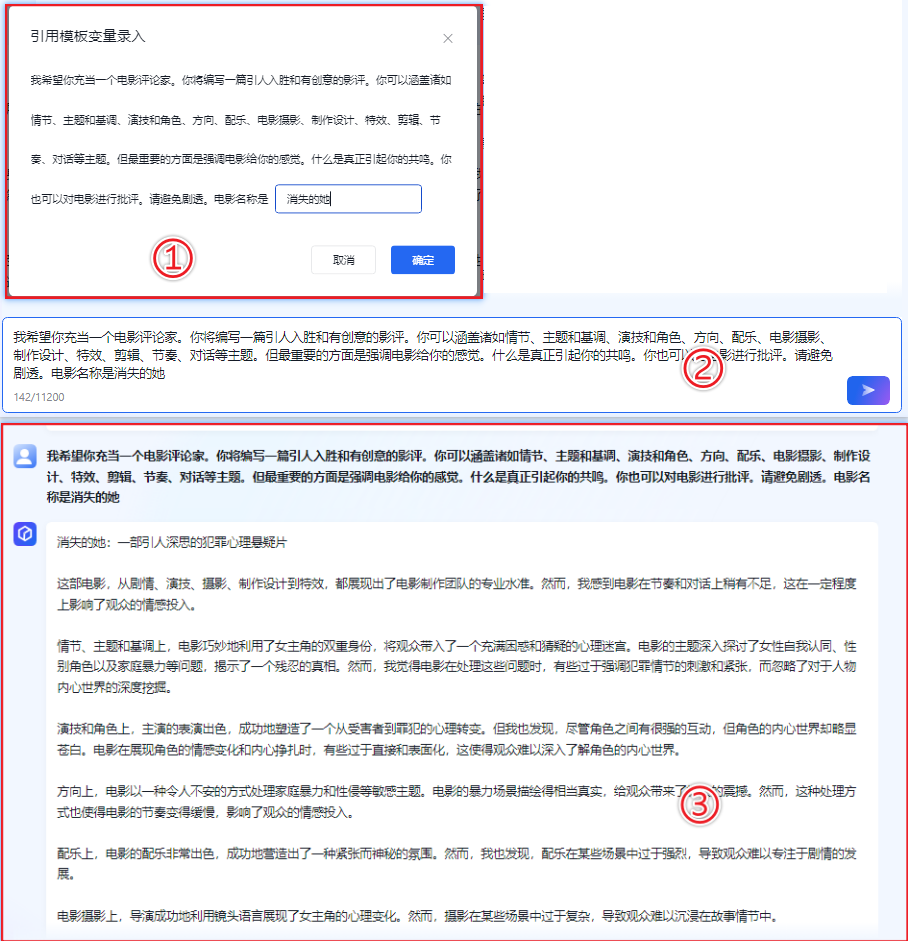

使用Prompt模板,控制输入,可以得到更加精准的回答

在线测试页面通过右侧引用模板,在弹出的对话框中写入电影名“消失的她”,其余步骤按照下述流程操作即可。

对比上述两次输出,可以得到如下结论

- 使用原始 Prompt:“介绍一下消失的她”,文心一言会返回一个比较泛化的结果;

- 使用 Prompt 模板+原始 Prompt:文心一言就会返回一个更加完整,更加符合预期内容。

三、自制 Prompt 模板

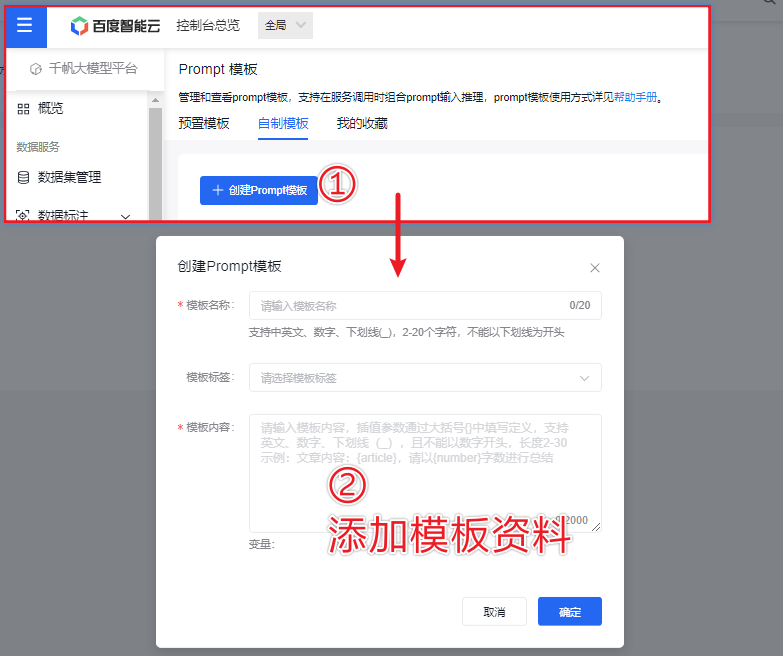

如果千帆大模型平台预置模板无法满足我们业务的需求,还可以在自制模板模块,进行模板的创建。

填写好模版名称后,在范围内选择/新建模板标签,模版内容的填写即可,可以直接填入引用的内容,也可以用“{}”注入变量。

变量值可以通过编码进行控制,对应到我们编程逻辑中,可以将其视为字符串填充。

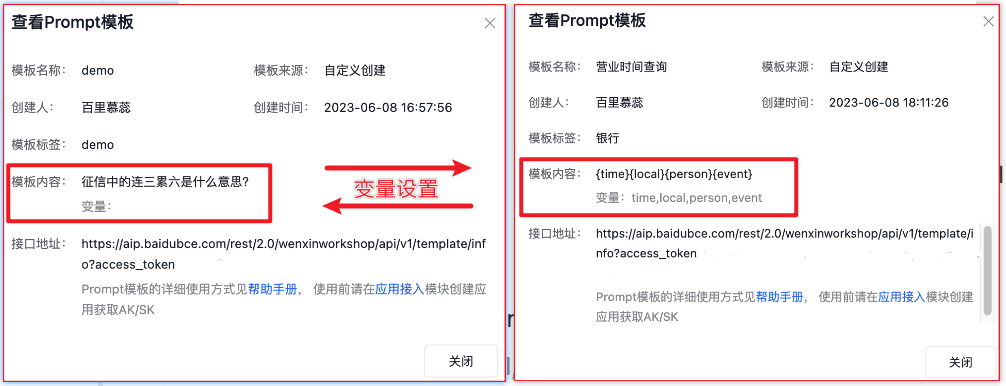

通过查看详情,可以对比变量模板和无变量模板。

更多 Prompt 工程使用技巧,可查看官方手册:

https://cloud.baidu.com/doc/WENXINWORKSHOP/s/7liu76ec4

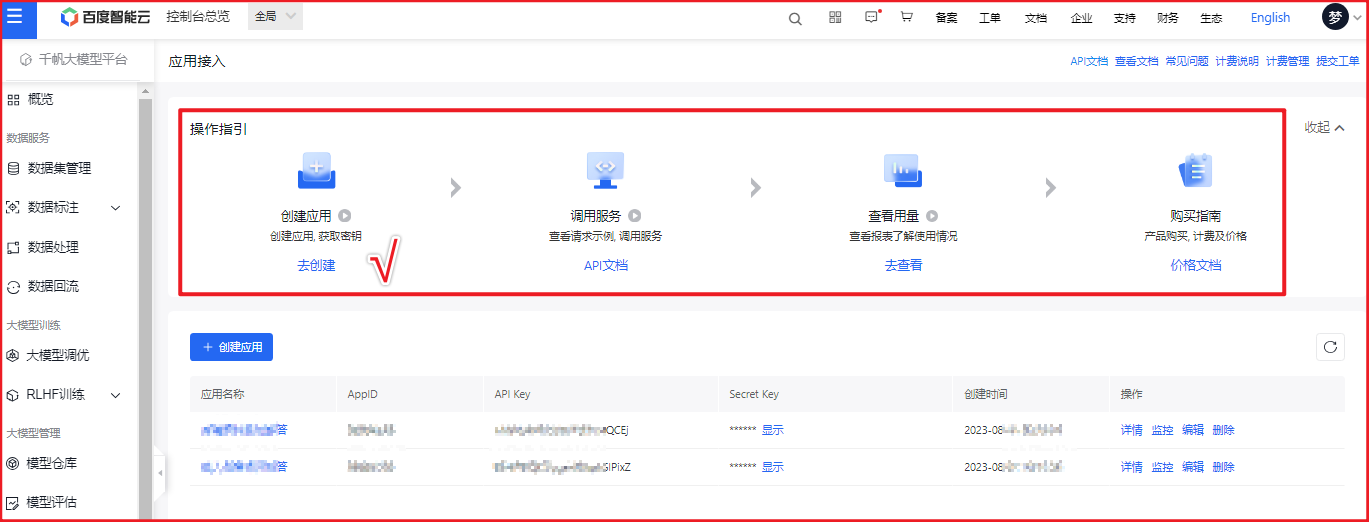

四、创建应用,通过程序调用 Prompt 模板

如果希望在应用中调用 Prompt 模板,需要提前建立应用,创建步骤参考下图,通过平台控制台菜单选择应用接入。

百度AI开放平台使用 OAuth2.0 授权调用开放 API,通过 AK 和 SK 获取 access_token,然后使用 access_token 调用各接口。

access_token 获取

前面的步骤建立的应用,已经拿到了 AK 和 SK 值,只需要调用百度 AI 开放平台接口即可:

请求 URL 数据格式

向授权服务地址https://aip.baidubce.com/oauth/2.0/token发送请求(推荐使用 POST),并在 URL 中带上以下参数:

- grant_type: 必须参数,固定为client_credentials;

- client_id: 必须参数,应用的API Key;

- client_secret: 必须参数,应用的Secret Key;

接口代码

接下来调用接口,用于获取prompt工程里面的模板的内容:

请求地址: https://aip.baidubce.com/rest/2.0/wenxinworkshop/api/v1/template/info

请求方式: GET

请求参数参考下图:

基于上述内容,得到完整示例代码:

- import requests

-

- # 使用 API Key,Secret Key 获取access_token,替换下列示例中的应用API Key、应用Secret Key

- def get_access_token():

- url = "https://aip.baidubce.com/oauth/2.0/token"

- headers = {

- 'Content-Type': 'application/json',

- 'Accept': 'application/json'

-

- }

- params = {

- 'grant_type': 'client_credentials',

- 'client_id': '你的AK值',

- 'client_secret': '你的SK值'

-

- }

- response = requests.request("POST", url, headers=headers, params=params)

- return response.json().get("access_token")

-

-

-

- def main():

- url = "https://aip.baidubce.com/rest/2.0/wenxinworkshop/api/v1/template/info?"

- access_token = get_access_token()

- params = {

- 'access_token': access_token,

- 'id': 1968, # 模板id

- 'content': '消失的她' # 自定义变量

- }

- headers = {

- 'Content-Type': 'application/json'

-

- }

- response = requests.get(url, params=params, headers=headers)

- print(response.text)

-

- if __name__ == '__main__':

- main()

可以看到通过简单的几行代码就实现了对 Prompt 模板的调用,百度智能云在产业实践中积累的 Prompt 模板,还有文心一言高频用户的 Prompt 模板都可以通过模板 ID 直接集成到我们的项目中,未来实际应用时,在也不会因为 Prompt 缺乏针对性、描述不清晰等原因影响到内容准确性了,必须点赞的好功能。