- 1LangChain实现AgentExecutor调用tools_langchain agentexecutor

- 2Nodejs 第八十章(Kafka高级)

- 3MATLAB仿真UR5机器人simulink simscape 自制建模 正向运动学,逆向运动学关节空间轨迹规划 五次多项式轨迹规划_采用五次多项式进行轨迹规划,采用逆动力学进行两自由度机器人的控制

- 42021回顾 | AI 领域十大研究趋势及必读论文

- 5Python PyQt5对象类型的判定对象删除操作详细介绍

- 6前端开发者的酷炫数据可视化大屏秘籍:亲手打造视觉盛宴

- 7Vue学习笔记2——MvVM模式和第一个Vue程序_html 运用mvvm模式实现vue data 和method

- 8防御跨站请求伪造(CSRF)攻击:前端开发者的安全指南_跨站请求伪造怎么解决

- 9ubantu20.04下配置hadoop环境详细教程(包含可能遇到的问题以及解决方法)_ubuntu解压hadoop后不显示版本信息

- 10NodeManager启动错误_error nodemanager.nodemanager: error starting node

Langchain-Chatchat项目:1-整体介绍_chatchat embedding

赞

踩

基于Langchain与ChatGLM等语言模型的本地知识库问答应用实现。项目中默认LLM模型改为THUDM/chatglm2-6b[2],默认Embedding模型改为moka-ai/m3e-base[3]。

2.支持LLM模型 本地LLM模型接入基于FastChat实现,支持模型如下:

说明:在线LLM模型目前已支持:ChatGPT、智谱AI、MiniMax、讯飞星火和百度千帆。

3.支持Embedding模型 本项目支持调用HuggingFace中的Embedding模型:

4.安装FastChat

二.设置配置项1.LLM模型配置 配置Langchain-Chatchat/configs/model_config.py文件中的llm_model_dict参数:

2.Embedding模型配置 配置Langchain-Chatchat/configs/model_config.py文件中的embedding_model_dict参数:

3.知识库初始化与迁移 首次运行项目,需要初始化或重建知识库,如下所示:

三.启动API服务和Web UI 一键启动所有Fastchat服务、API服务、WebUI服务:1.启动命令

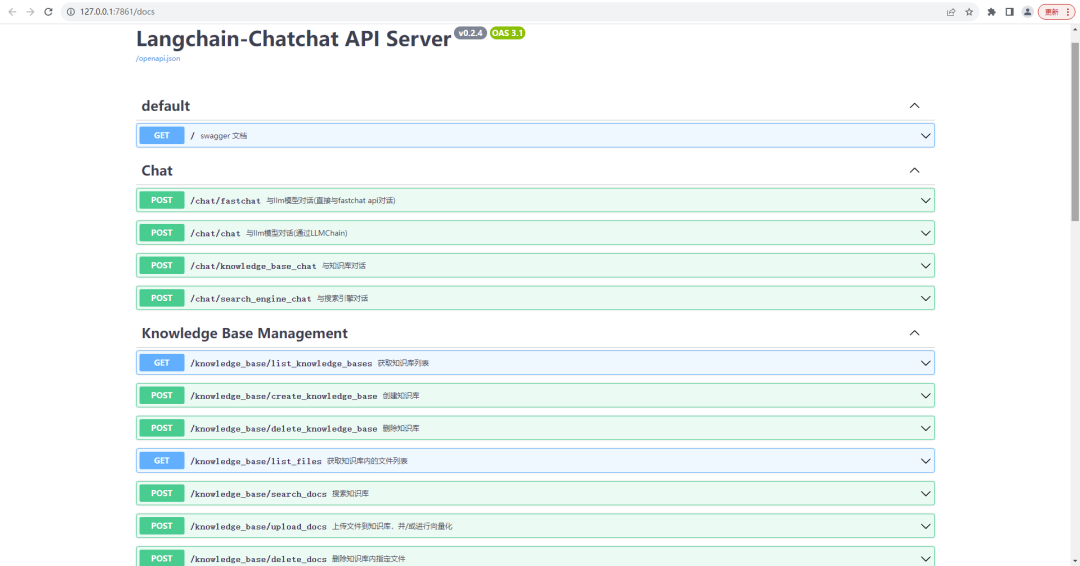

2.FastAPI docs界面

图片

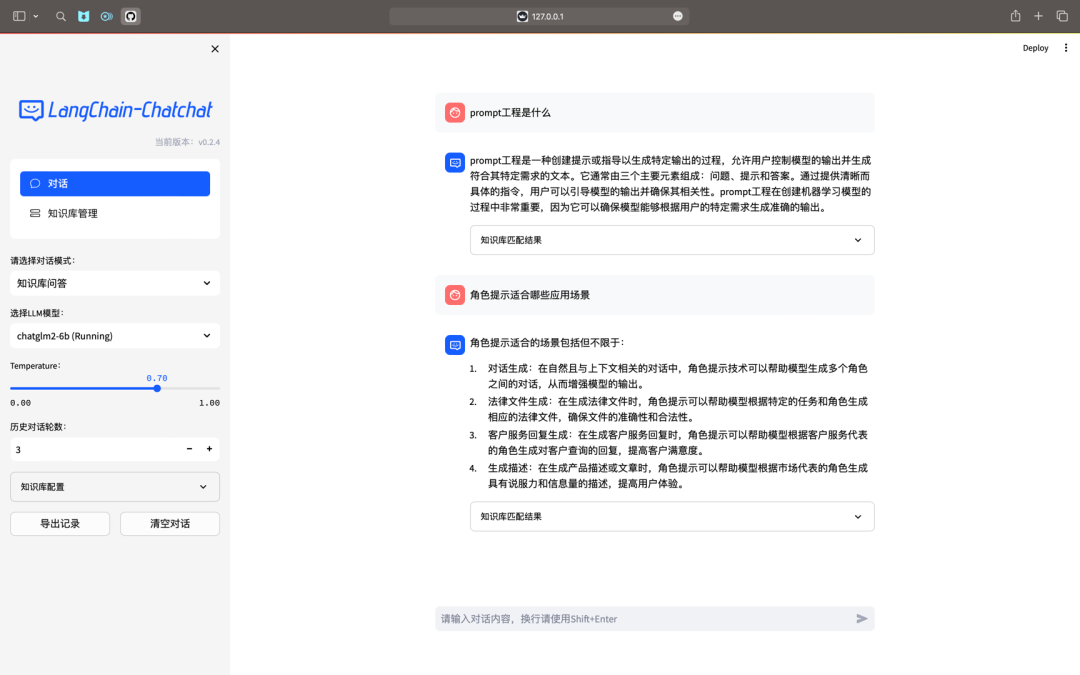

3.Web UI对话界面

图片

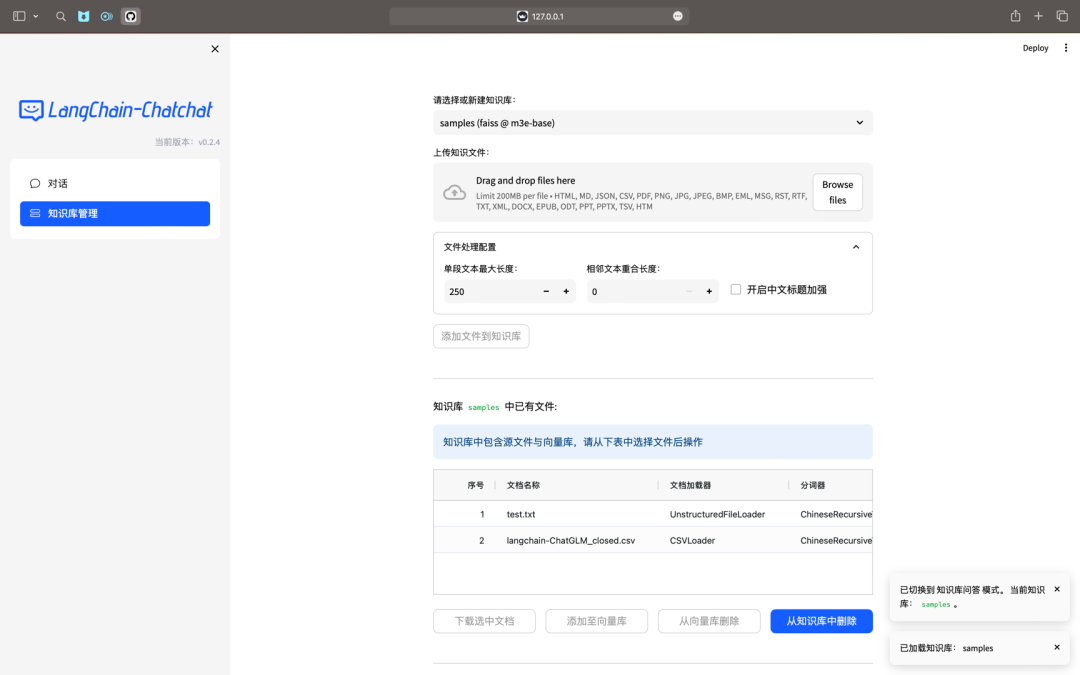

4.Web UI知识库管理页面

图片

参考文献:[1]Langchain-Chatchat:https://github.com/chatchat-space/Langchain-Chatchat[2]https://huggingface.co/THUDM/chatglm2-6b[3]https://huggingface.co/moka-ai/m3e-base[4]https://github.com/lm-sys/FastChat[5]https://github.com/chatchat-space/Langchain-Chatchat/issues