- 1通过指数平滑法预测NBA篮球大小分_nba大小分预测方法最新

- 2nginx+lua+redis实践_nginx lua redis

- 3二叉树LeetCode题目总结C++_c++leetcode输入构建二叉树

- 4C51--WiFi模块ESP8266--AT指令_wifi模组 at指令

- 5[STM32/FPGA]软件SPI_stm32与fpga的spi通讯

- 6探秘GitHub私有库:GithubHub,免费账号的隐私保障!

- 7【大数据Hive】 表设计常用优化策略方法_hive表设计

- 8Python面试题:结合Python技术,如何使用Tornado进行异步Web开发_python tornado websocket 启动异步线程

- 9本地部署大模型?看这篇就够了,Ollama 部署和实战_ollama本地部署大模型

- 10软件测试之需求分析_软件开发需求分析对应的测试

【AI 大模型训练数据白皮书 2024】_预训练大模型白皮书

赞

踩

文末有福利!

自《中共中央国务院关于构建数据基础制度更好发挥数据要素作用的意见》发布以来,我国数据要素建设不断深入,在国家数据局等 17 部门联合印发的《“数据要素 ×” 三年行动计划(2024 - 2026 年)》进一步明确 “建设高质量语料库和基础科学数据集,支持开展人工智能大模型开发和训练”。

通过数据要素建设推动人工智能大模型发展,可以有效解决我国人工智能,特别是大模型研发所面临的数据瓶颈,进一步发挥大模型对于世界知识数据的汇集和处理能力,创造更大的生产力,助力我国从数据经济走向智能经济新发展模式。

大模型是数据要素价值释放的最短路径,通过理解其训练所使用的数据类型,可以更好理解大模型发挥价值的内在机制,破解对训练数据常见的迷思和误解。

01 训练数据对大模型发展的重要性

业界认为,算法、算力与数据,是支撑大模型发展的三大基石。

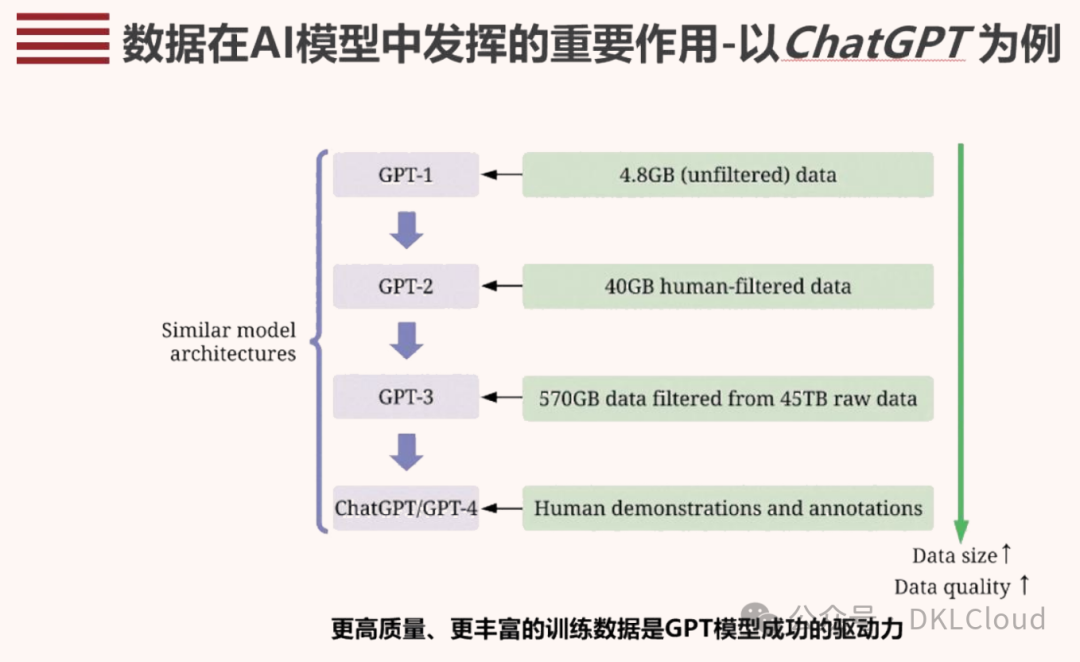

更高质量、更丰富的数据是以 GPT 为例的生成式人工智能大模型成功的驱动力。GPT 模型架构从第 1 代到第 4 代均较为相似,而用来训练数据的数据规模和质量却有很大的不同。

GPT-1 是由 4.8G 未过滤原始数据训练,GPT-2 是由经人类过滤后的 40G 数据训练,GPT-3是由从 45T 原始数据中过滤的 570G 数据训练,而 chatGPT/GPT-4 则是在该基础上又加入了高质量人类标注。

以吴恩达(Andrew Ng)为代表的学者观点认为,人工智能是以数据为中心的,而不是以模型为中心。“有标注的高质量数据才能释放人工智能的价值,如果业界将更多精力放在数据质量上,人工智能的发展会更快”。

02 模型训练所需的数据类型

数据作为大模型训练的基础,它提供了大模型所必需的知识和信息。区别于以往搜索系统、个性化推荐等所需的大量用户行为和偏好数据,随着技术的演进,大模型所需的数据是对知识性内容有强需求,是一种新的类型。

2.1 训练大语言模型的数据

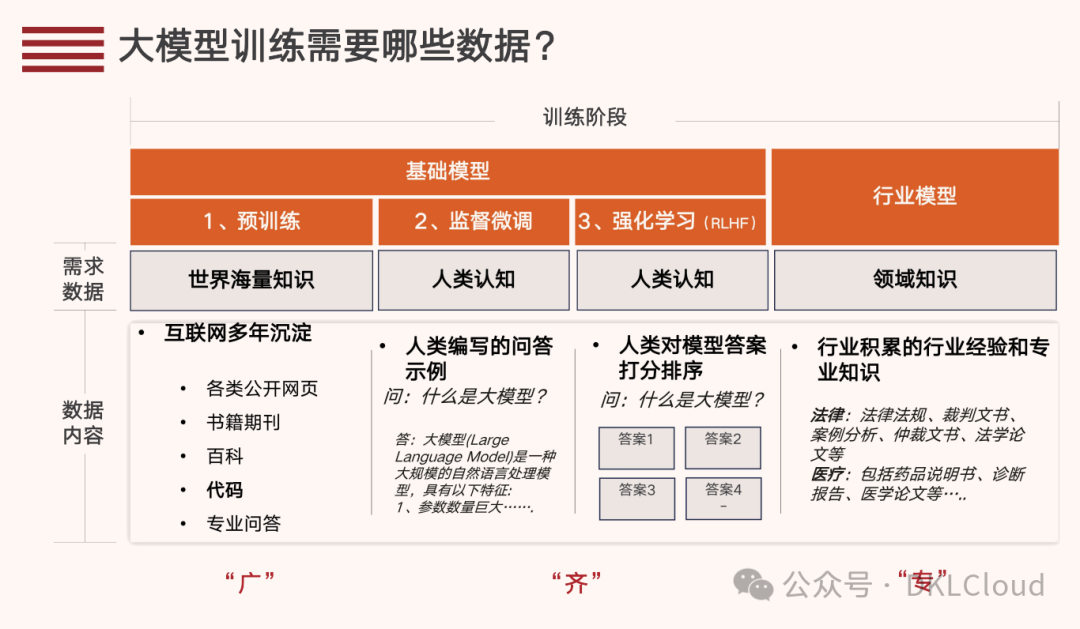

大模型所需要的数据根据训练的阶段有所不同。以 ChatGPT 为代表的大语言模型(LLM)为例,其训练过程分为预训练(Pre-training)、监督微调(SFT)、基于人类反馈的强化学习(RLHF)三个阶段,后两部分又统称为“对齐”(Alignment)阶段。

3.2 高质量数据的标准

3.2.1 高质量数据类型的三重不确定性

第一重不确定性来自于所需的语料种类,其类型是由人类对模型能力需求决定的,而能力需求又是根据需要模型所完成的任务而不断演变。

回溯基础大模型的发展历程,在 2020 年左右,基于 Transformer 架构的 Google Meena,其目的是让模型具有生成连贯且有意义内容的对话能力,因此对话文本被视为最重要的高质量数据。而随着技术路线的演进,人们发现更通用的上下文理解是重点,因此书籍和科研论文等又被视为高质量数据。

通过提升其在训练语料中的占比,可以增强模型从文本中捕捉长距离依赖的能力。随着人们对通用人工智能的向往,对提升通用性能的北极星指标 - 推理能力有帮助的语料,又更加被重视。

一种是代码数据,因为里面涉及大量If-Then-Else 等条件控制信息;另一种是教材,因为涉及了比较详细的数学推理过程,和逻辑链高度相关。如果再拓展到行业模型,根据对模型能力的不同需求,语料类型更难以一一列举。

比如,经人类标注的,由视觉相似性图片构成的匹配对数据库,可以作为高质量数据用于大模型在广告领域的训练,通过更好预测用户需求实现对素材点击率的优化。而通过收集人类驾驶员对稀有事件(比如驾驶过程中遇到的复杂路况、极端天气、异常行为的人或车辆等场景)的应对数据,则可以更好训练完全自动驾驶(FSD)模型在不同场景中的处理能力。

由此看出,由于生成式 AI 在技术演进和应用场景拓展中具有不确定性,模型对所需要语料类型也在发生变化,“高质量语料” 的类型和范围也在不断拓展。

04 合成数据作为解决训练数据供给不足的新方案

4.1训练数据供给不足带来的思考

在生成式人工智能技术不断发展的趋势下,训练数据来源是人们最关心的问题之一。上节以政府和社会力量的视角展开。

本节以已经使用的数据源和正在探索的新数据源视角展开。在已经使用的训练语料中,有用于语言大模型训练的文本数据,包括网页信息、书籍、科研论文、知识百科、专业问答、代码以及领域知识,也有用于多模态模型的图片、视频、音频等媒体数据。

根据 Epoch AI 的估算,书籍、科研论文等高质量语言数据集可能会在2024 年前耗尽。人们正在积极探索新数据源,以缓解训练语料可能面临不足的问题。一种思路是将未数字化的知识数字化,如在最新发布的 Claude 3 中,提到了将大量未数字化的书籍和资料做数字化处理,成为模型可读取的训练语料。

还可利用机器感知数据,比如将无人车、无人机、其他智能硬件设备等生成的大量物理世界数据用于训练。另一种思路是利用模型或算法,批量生成新数据,比如合成数据,然后利用它们训练模型。近期,合成数据在大模型训练和应用的话题引起了广泛关注。

一方面,高质量的合成数据可以作为真实数据的补充和替代,模拟现实世界的复杂性和多样性,被视为扩展模型学习范围与能力的重要手段。

另一方面,合成数据的生成过程可能存在偏差或噪声,导致其质量和真实性无法完全模拟客观世界。

由此引出一系列值得深入讨论的问题:对于合成数据的价值,它能否拓展大模型能力的边界?又是否能替代真实数据,缓解优质数据供给不足的问题?

此外,合成数据能否通过对现有数据的深加工,将之前不能被用于训练的数据转化为可用,提升模型对数据利用的可能性?而对于合成数据的风险,人们也会担忧是否会出现 “大模型自己产生数据进行自我训练” 的循环,导致初始偏差被不断放大,最终使模型失控?这种新数据源还会带来哪些新风险?

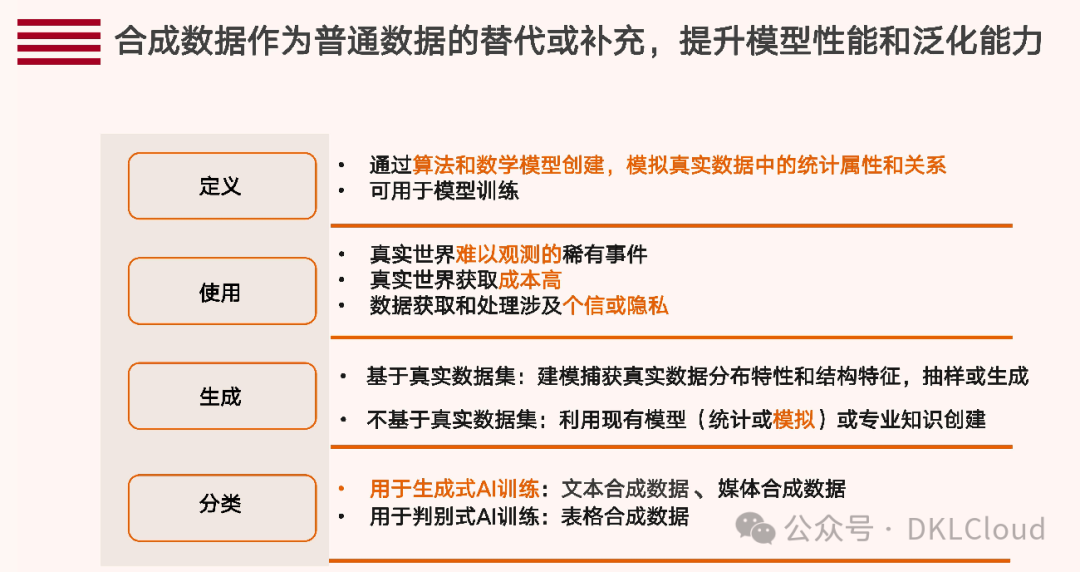

4.2 合成数据的定义

合成数据是通过算法和数学模型创建的。首先建模真实数据的分布,然后在该分布上进行采样,创建出新数据

集,模拟真实数据中的统计模式和关系。合成数据类似于数据的 “替身演员”,发挥补充或替代真实数据的作用。

在机器学习和人工智能领域,合成数据可以为模型提供训练材料,帮助它们学习、理解和预测。需要注意的是,如果生成过程设计不当,合成数据也可能缺乏保真度,对客观世界的模拟出现偏差。

4.3 合成数据的必要性

什么情况下会用到合成数据?本质原因是真实世界中获取数据遇到困难。

一是真实世界中难以观测,如罕见病或极端天气等。利用合成数据可以设计比真实数据集更广泛的情况,对 Corner Case 进行模拟,提升训练数据集的全面性和多样性,确保在处理边缘案例时也有良好性能,提升模型泛化能力。

二是真实世界中数据获取的成本高,如大模型对齐训练中需要人类大量的高质量反馈。利用合成数据可以实现对齐流程自动化,几乎不需人类标注,大幅节省成本,提高获取效率。

三是数据获取和处理涉及到真实世界中的个信甚至敏感信息,特别是医疗健康和金融领域。合成数据可以利用差分隐私对个体信息 “加噪声” 等方法,模拟真实数据集的分布,而不模拟其中的真实个人信息,实现对个信去标识化。由此归纳出,合成数据具有全面性和多样性、经济高效、有利于隐私保护等优点。

4.4 合成数据的生成方法及分类

根据是否基于实际数据集生成,合成数据生成方法主要分为两大类。

第一种是基于真实数据集构建的:人们会建立模型以捕获真实数据的分布特性和结构特征,刻画数据中的多变量关系和相互作用。然后从该模型中抽样或生成合成数据。如果模型能很好地代表真实数据,那么合成数据将具有与真实数据相似的统计特性。以 ChatGPT 为例,它深入研究了人类写的数十亿例文本,分析了词语之间的关系,并构建了一个模型来理解它们是如何组合在一起的。

在生成文本时,每一个单词的选择也都取决于它前一个单词出现的统计概率。

第二种生成方法并不来源于真实数据,而是通过使用现有模型或者人类专业背景知识来创建。现有的模型可以是某个过程的统计模型,也可以是模拟模型。模拟可以通过游戏引擎等方法创建,如最近火爆的 Sora 文生视频模型,里面用到了由游戏引擎

(Unity、Unreal Engine 5 等)合成的视频数据作为训练集,以提高生成质量。根据用于训练的 AI 类型,可以将合成数据分为应用于生成式 AI 和判别式 AI 训练两类。应用于生成式 AI 训练的通常有媒体合成数据,即由模型和算法合成的视频、图像或声音。文本合成数据,即在自然语言处理中由模型生成的文本。而判别式 AI 训练(分类或回归)所需的通常是表格合成数据,类似真实生活中数据记录或表格的合成数据。

4.5 合成数据在模型训练中的作用

基础大模型训练所需的数据类型包含两大类,一是用于预训练的世界知识,二是用于对齐的数据。合成数据作为真实数据的一种替代,现阶段虽然在预训练占比不高,但未来发展潜力巨大,可作为一个 “新物种” 密切关注;目前合成数据多应用于提升对齐阶段的数据获取效率,增强模型安全和可靠性。

4.5.1 预训练语料的新物种

模型预训练阶段是通过大量无监督学习构建基础能力,掌握世界的规律。大语言模型需要各类世界知识,包括网页、书籍、新闻、代码等;而多模态又需要视频、图片、音频等语料。那么合成数据作为新物种,能对模型的训练语料起到哪些补充作用呢?

首先,合成数据可应用于多模态数据的生成。最近火爆的 Sora 文生视频大模型,里面用到了大量由游戏引擎合成的视频数据作为训练集,以提高生成质量。此外,利用模拟器生成的多模态场景数据还广泛应用于具身智能机器人、自动驾驶、AI for Science 等场景的训练。

利用模拟模型生成多模态数据可以更好满足模型对训练数据差异化的需求,例如通过有效 “过采样”(随机复制少数样例以增大它们的规模)罕见事件或灾难性事件,以确保模型能够针对更广泛的输入保持鲁棒性。

而伴随生成式人工智能走向更通用,模型训练将不仅从文字中学习,也会从声音、图片和视频中学习,就更需要多模态的训练数据。因此,我们判断通过合成的多模态数据进行训练的需求还会持续且大幅增加。

其次,合成数据还可应用于高价值领域知识的生成。核心是合成数据能通过对现有数据的深加工,将之前不能被用于训练的数据转化为可用,提升模型对数据利用的可能性。例如工业制造领域,利用合成数据,可以把生产、制造等工艺流程相关的原始数据,结合行业知识图谱,转化为可供大模型学习的工业语料,以缓解行业语料短缺的问题。

该过程分为三步:一是将原始数据(Data)转变为信息(Information):即将非自然语言描述的内容(如工艺生产中的操作行为或时序数据)转化为大模型可读的结构化信息(操作记录)。

二是将信息提炼为知识(Knowledge):仅有操作记录并不能直接提供有效知识,但将多条结构化信息与行业的知识图谱、专家经验相结合,可以产出有价值的行业知识(如在什么温度下应该如何操作,好处是什么)。

三是将得到的知识泛化:利用大模型的推理能力,将相对单一的知识进行多样性拓展,积累更丰富的行业语料。由此看出,大模型可以利用原始数据、信息、知识等不同层次的内容,打通数据利用的模式。我们判断,通过合成数据拓展对数据利用的可能性,生成领域知识的趋势是 “精”,即对语料质量要求高,且是不可或缺的。

因为大模型只有在预训练中学习过领域知识,才能在后期利用行业语料进行 SFT 训练时激发出更好的效果,更容易应用于垂直领域。综上,我们认为合成数据作为预训练语料的新物种,发展潜力巨大,特别是在多模态数据和领域知识生成方面值得密切关注。

4.5.2 提升对齐语料获取效率的加速器

对齐数据以人类高质量反馈为主,包含监督微调阶段和基于人类反馈的强化学习。

此方法主要在以下几方面遇到问题:一是数据获取的成本更高,二是人类评估的准确性和一致性,三是模型通常选择避免回答敏感和有争议的问题,降低模型的整体效用。如果引入合成数据作为真实数据的补充和替代,能否缓解这些问题呢?合成数据最大的优势是可以大幅提升对齐数据的获取效率,“如果掌握了合成数据技术,对齐的成本可能会降低好几个数量级,或用一样的投入产生更大数量级的数据,竞争格局就会发生变化”。这种对合成数据的应用是

“从人工智能反馈中进行强化学习(RLAIF)”。通常是用一个较大规模模型产出合成数据,生成指令及输入和输出样本,过滤掉无效或重复信息,自动化微调出性能较好的小模型,全过程中几乎无需人类标注。

这不仅大幅降低了标注成本,也能缓解人工对齐导致模型对敏感问题拒答的情况。例如斯坦福大学发布的 70 亿参数对话大模型Alpaca,正是采用此类自我指导(Self-instruct)方法,用 OpenAI 的 API 自动生成指令数据进行微调。还有一种基于 RLAIF 新思路探索,希望在不引入外部模型的前提下实现自动化微调。

例如自我对局(Self-play),在满足一定条件时,利用合成数据进行自我对抗微调(t+1 代的模型尝试将 t 代模型的输出与真人的输出区分开),得到了比 RLHF 更好的效果。再如 Claude3 用到的宪法式 AI,让 AI 系统在遵循预先设定的原则下,使用模型自身生成的反馈和修正意见来进行自我改进,得到一个既能生成无害内容,又不规避有害问题的模型。

同时另一种对合成数据的应用是 “从人类和人工智能反馈中进行强化学习(RLHAIF)”,该方法整合了人类和 AI 元素以提供监督。有研究表明,在利用 AI 协助人类评估模型有效性时,模型生成的批评有助于人类发现可能错过的缺陷,提高人类评估的准确性。

那么,如何系统的去学习大模型LLM?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

篇幅有限,部分资料如下:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/码创造者/article/detail/914225

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。