- 1Python编程实例-Tkinter GUI编程-Treeview_python tkinter treeview

- 2springboot 整合 邮件发送_oxxsw

- 3Linux添加用户及用户权限管理_用linux命令给用户加权限_linux操作系统添加核管理用户

- 4pyqt5基本使用操作_pyqt5怎么使用

- 5hive里如何快速查看表中有多少记录数_hive获取数据量

- 6JavaScript实现打印指定区域的内容(附完整源码)_js打印指定区域内容

- 7【Linux系统进阶】Linux命令日志审计方法、企业中动态密码方案、加密算法md5与随机数8种方法(二)_linux audit日志审计命令

- 8利用AI大模型实现自然语言到SQL的转换及其优化_ai sql

- 9SQLAlchemy 连接 MySQL 数据库(一)_sqlalchemy 链接mysql

- 10mysql中授权(grant)和撤销授权(revoke)等命令的用法详解

保姆级教程!本地部署最强开源语言大模型 Llama3 和中文微调版

赞

踩

读完需要5分钟,速读仅需 1 分钟

1

目录

简介

Llama3 介绍和优点

Ollama 介绍

Lobechat 介绍

安装准备

本地运行环境要求

利用 Ollama 本地部署 Llama3

利用 Ollama 本地部署 Llama3 中文微调版

在 Lobechat 中使用 Llama3

2

简介

2.1

什么是 Llama3?

Lllma3 是 META 公司发布的开源语言大模型,与 chatGPT 类似,它可以完成一系列诸如对话,翻译,上下文理解等等复杂任务,你可以把它理解为一个免费,可以部署在你的电脑无须联网就可以使用的 AI 助手。

2.2

什么是 Ollama?

Ollama 是一个支持在本地运行大语言模型的工具,兼容 Windows 和 MacOS 操作系统。使用 Ollama,您仅需一行命令即可下载并启动模型。它简单方便使用,在本教程中我们使用 Ollama 来启动我们下载的 Lllama3 大模型。你可以把它理解为大语言模型的启动器。

2.3

什么是 Lobechat?

尽管在下载 Llama3 和 Ollama 后我们已经可以任意的使用模型,但为了更加方便的使用和体验我们可以使用 Lobechat 来部署我们的大语言模型。它拥有精美的 UI 设计 和可扩展的插件等等优点方便我们使用。

3

安装准备

Lllama3 有 8B 和 70B 两个版本,70B 拥有 700 亿个参数,需要强大的硬件支持,我们下载使用的是 Llama 3 8B,它拥有 80 亿个参数,相对来说轻量级是一个更加实用的选择。使用它我们需要:

良好的网络环境

GPU 最好有 8GB 及以上

磁盘空间最好有 10G 以上, Llama3 8B 版本需要 5G 空间,中文微调版需要至少 8G 空间

4

利用 Ollama 本地部署 Llama3

4.1

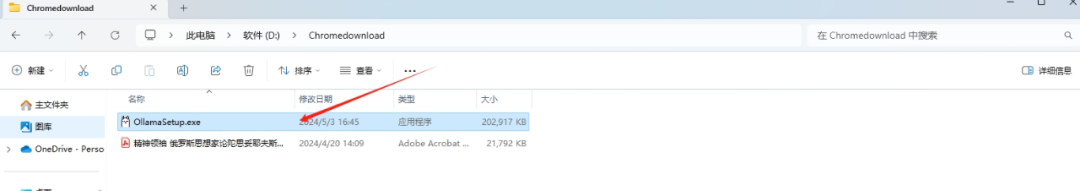

Windows系统下载 Ollama

打开下面的网站,下载 Ollama 并双击安装。

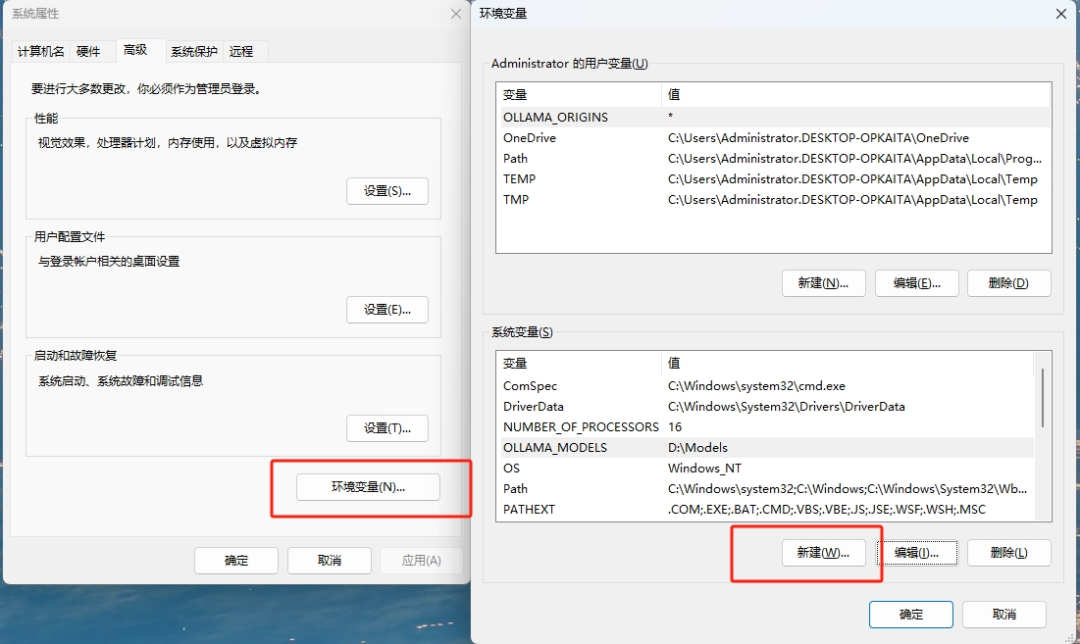

由于 Ollama 的默认参数配置,启动时设置了仅本地访问,所以跨域访问以及端口监听需要进行额外的环境变量设置 OLLAMA_ORIGINS。

首先通过 Windows 任务栏点击 Ollama 退出程序。

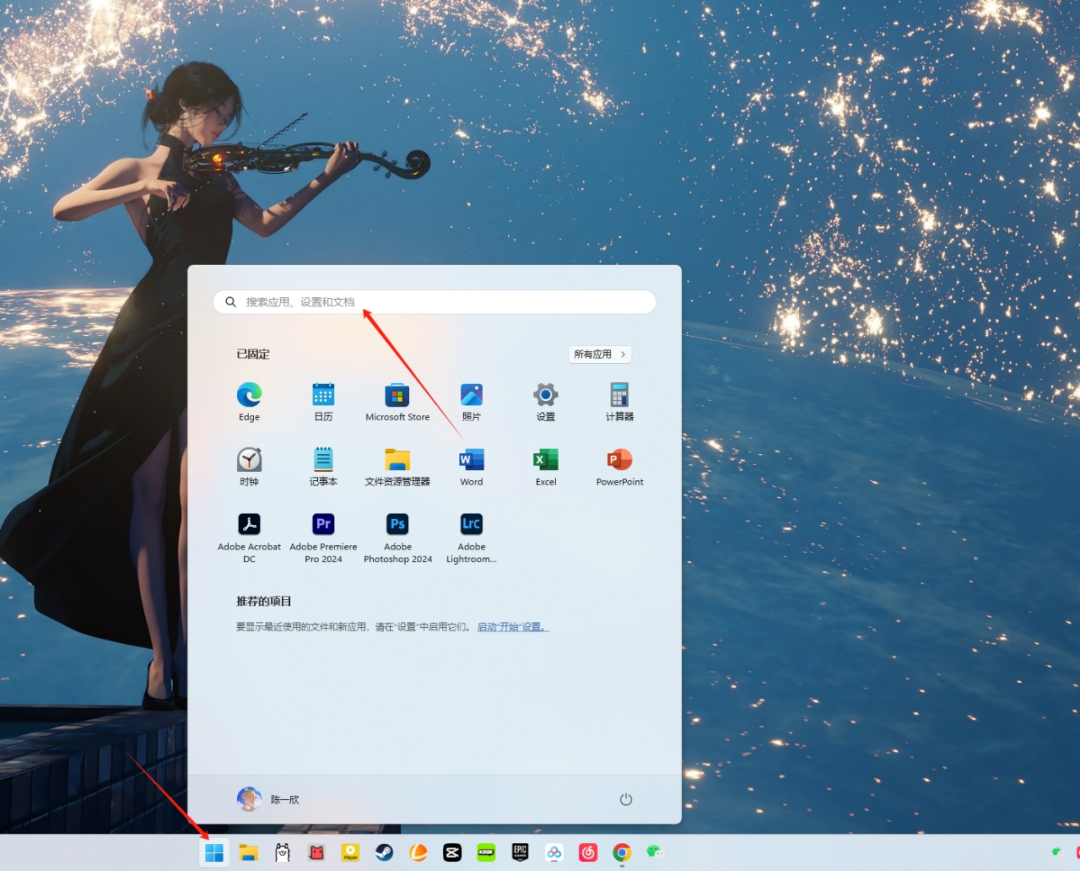

从控制面板编辑系统环境变量。

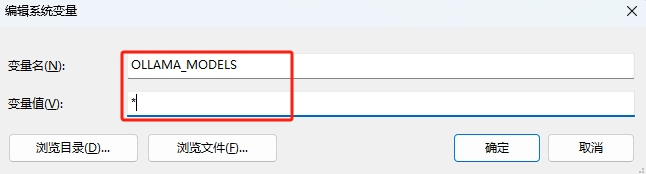

为您的用户账户编辑或新建 Ollama 的环境变量 OLLAMA_ORIGINS,值设为 * 。

点击 OK/应用保存后重启系统。

重新运行 Ollama。

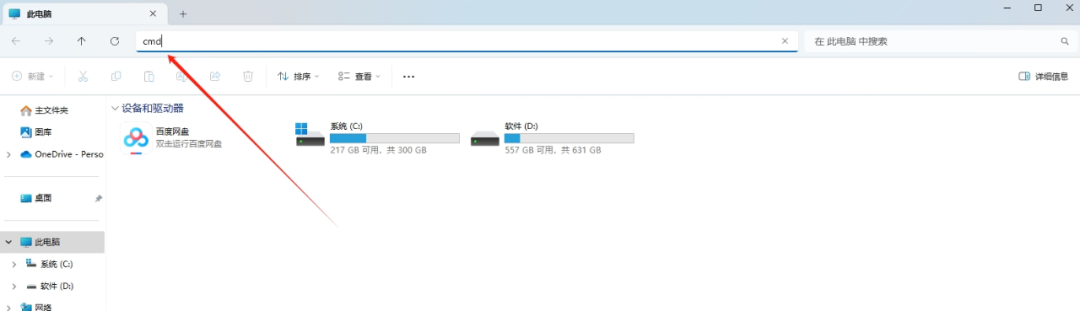

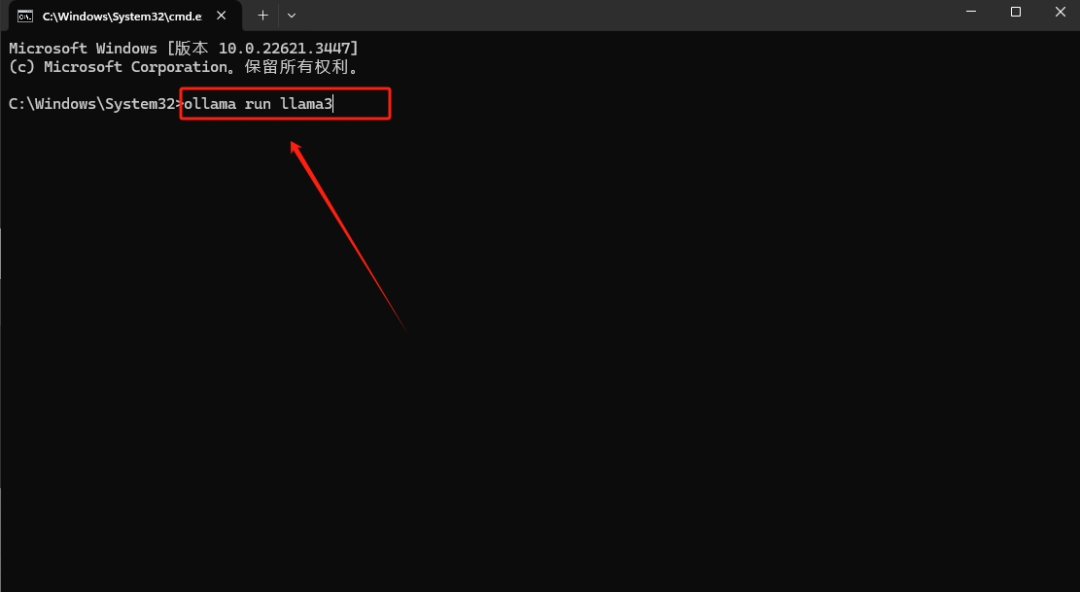

配置好后我们打开我的电脑,并在点击框输入 CMD,回车确定后输入命令:

ollama run llama3

- 1

- 2

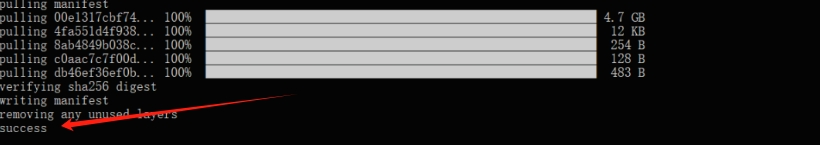

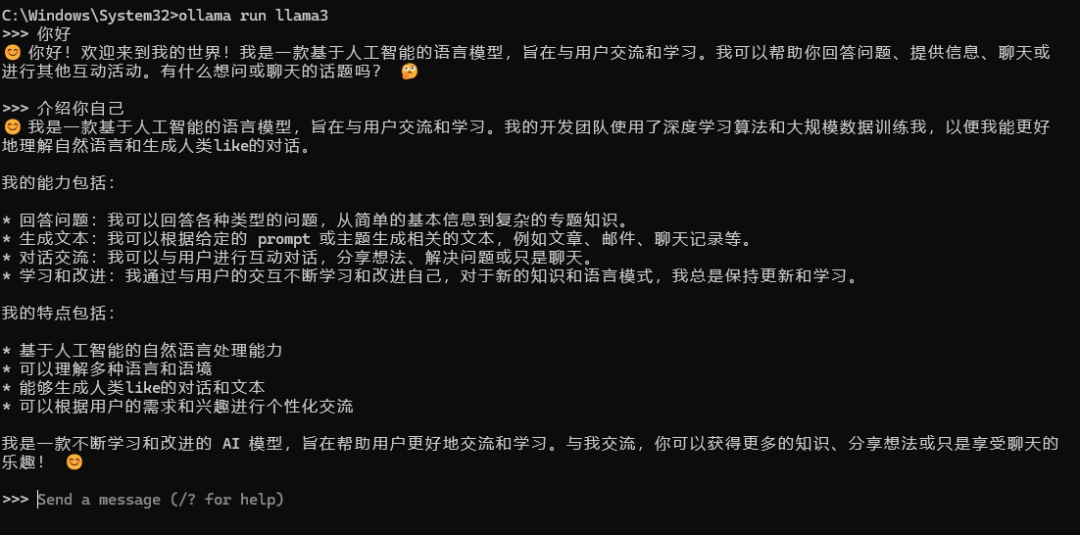

这条命令的作用是检查目录下是否有该模型,没有会自动下载,下载好后自动运行该模型。

下载完成后我们已经可以开始使用了。

5

利用 Ollama 本地部署 Llama3 中文微调版

Llama3 中文微调版是在原版模型上进行了大量中文数据进行增量预训练,更加适合国人使用。在本教程中使用 ymcui 开发的中文微调版本,相对于其他版本,它拥有非常详细的文档供指引,参考和学习。项目地址:

https://github.com/ymcui/Chinese-LLaMA-Alpaca-3?tab=readme-ov-file

- 1

- 2

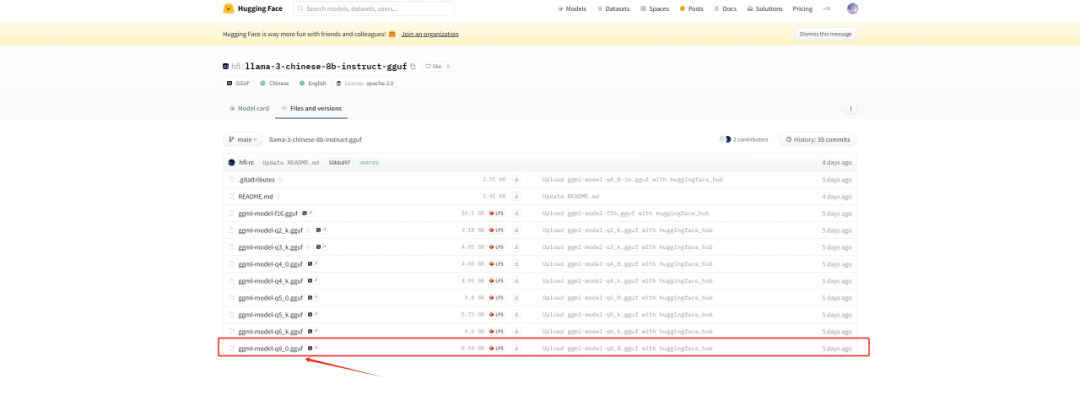

首先,我们输入下面的网址下载模型。

https://huggingface.co/hfl/llama-3-chinese-8b-instruct-gguf/tree/main

- 1

- 2

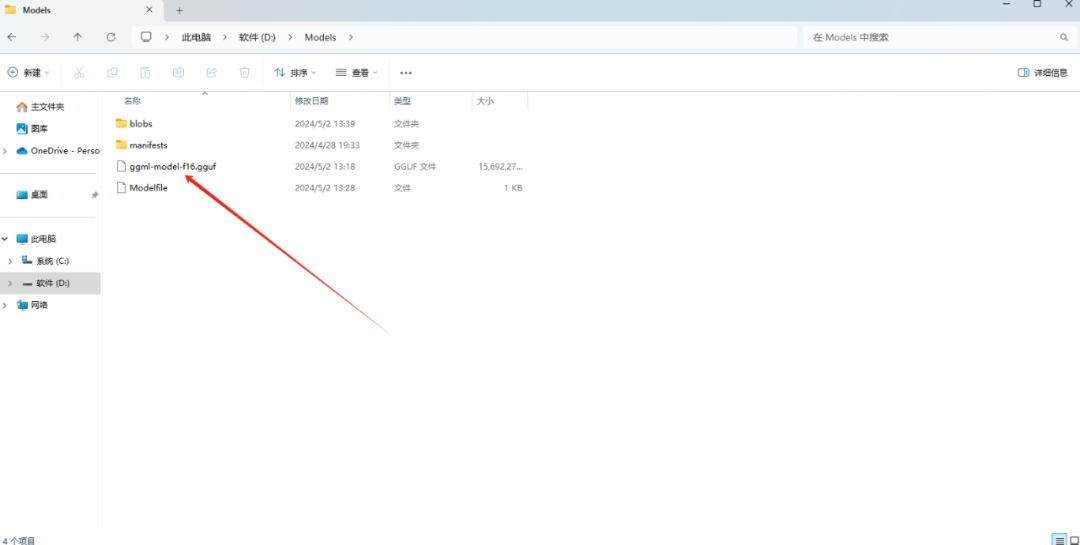

下载好后放入你自己创建的文件夹中,下面做演示(我自己下载的F16版本,请下载q8_0版本,它在大小和模型表现中做到了比较好的平衡。)

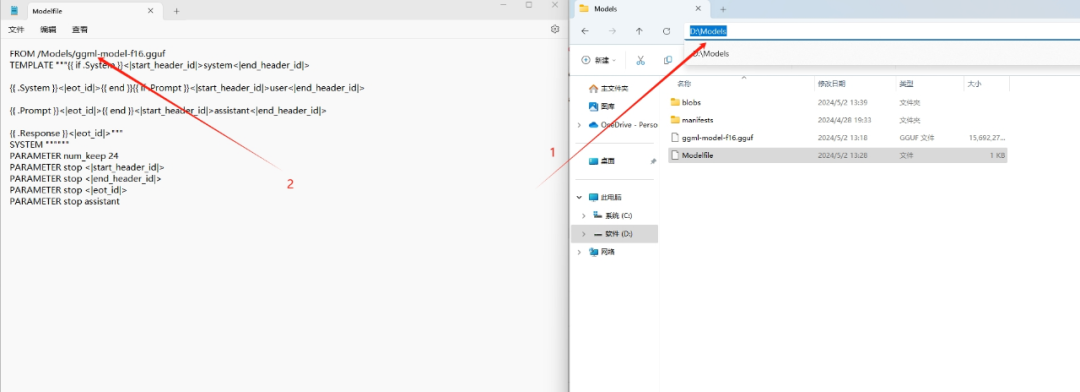

接下来在文本编辑器中编写 Modelfile 文件,其内容如下:

FROM /your-path-to-ggml/ggml-model-q8_0.gguf``TEMPLATE """{{ if .System }}<|start_header_id|>system<|end_header_id|>`` ``{{ .System }}<|eot_id|>{{ end }}{{ if .Prompt }}<|start_header_id|>user<|end_header_id|>`` ``{{ .Prompt }}<|eot_id|>{{ end }}<|start_header_id|>assistant<|end_header_id|>`` ``{{ .Response }}<|eot_id|>"""``SYSTEM """"""``PARAMETER num_keep 24``PARAMETER stop <|start_header_id|>``PARAMETER stop <|end_header_id|>``PARAMETER stop <|eot_id|>``PARAMETER stop assistant``PARAMETER stop Assistant

- 1

- 2

请注意 FROM 定义 GGUF 文件的路径,比如我的 GGUF 文件放在 Models 文件下,路径就改为

FROM /Models/ggml-model-f16.gguf

- 1

- 2

如果你没有其他的文本编辑器可以打开记事本复制输入后保存,然后在重命名中删除文件后缀 txt。

命令行中运行以下命令,创建一个名为 llama3-zh-inst(名字可自定义)的模型实例,加载 Modelfile 配置:

ollama create llama3-zh-inst -f Modelfile

- 1

- 2

创建过程输出日志如;

transferring model data``creating model layer``creating template layer``creating system layer``creating parameters layer``creating config layer``using already created layer sha256:f2a44c6358e8e0a60337f8a1b31f55f457558eeefd4f344272e44b0e73a86a32``using already created layer sha256:8ab4849b038cf0abc5b1c9b8ee1443dca6b93a045c2272180d985126eb40bf6f``writing layer sha256:b821abf159071cfc90f0941b5ca7ef721f229cfcfadcf95b5c58d0ceb3e773c7``writing layer sha256:dc4ec177268acc3382fc6c3a395e577bf13e9e0340dd313a75f62df95c48bc1d``writing manifest``success

- 1

- 2

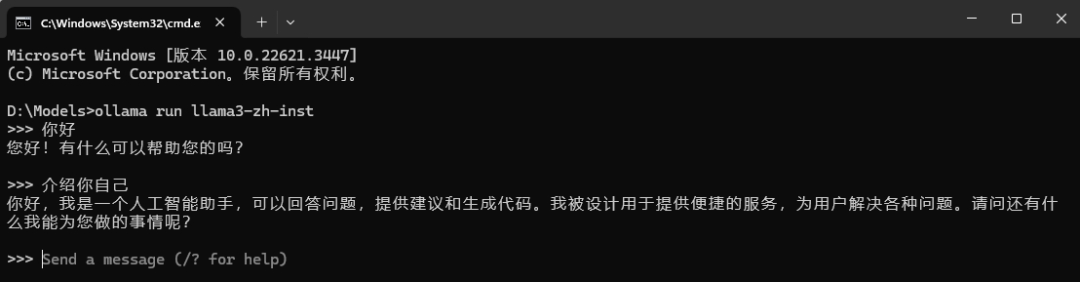

输入以下命令进入聊天程序,已经可以愉快的使用啦。

ollama run llama3-zh-inst

- 1

- 2

6

在 Lobechat 中使用 Llama3

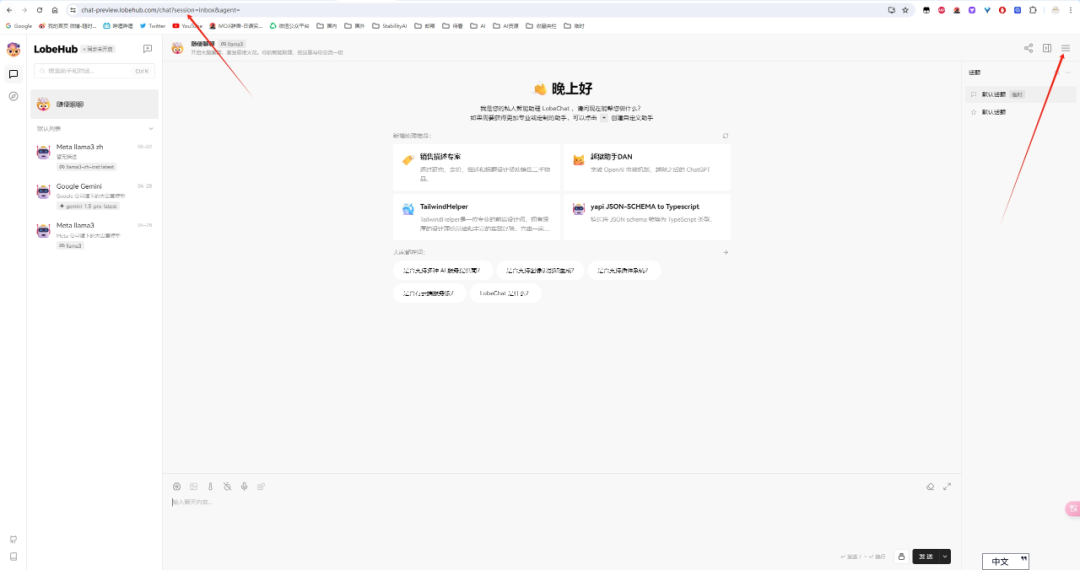

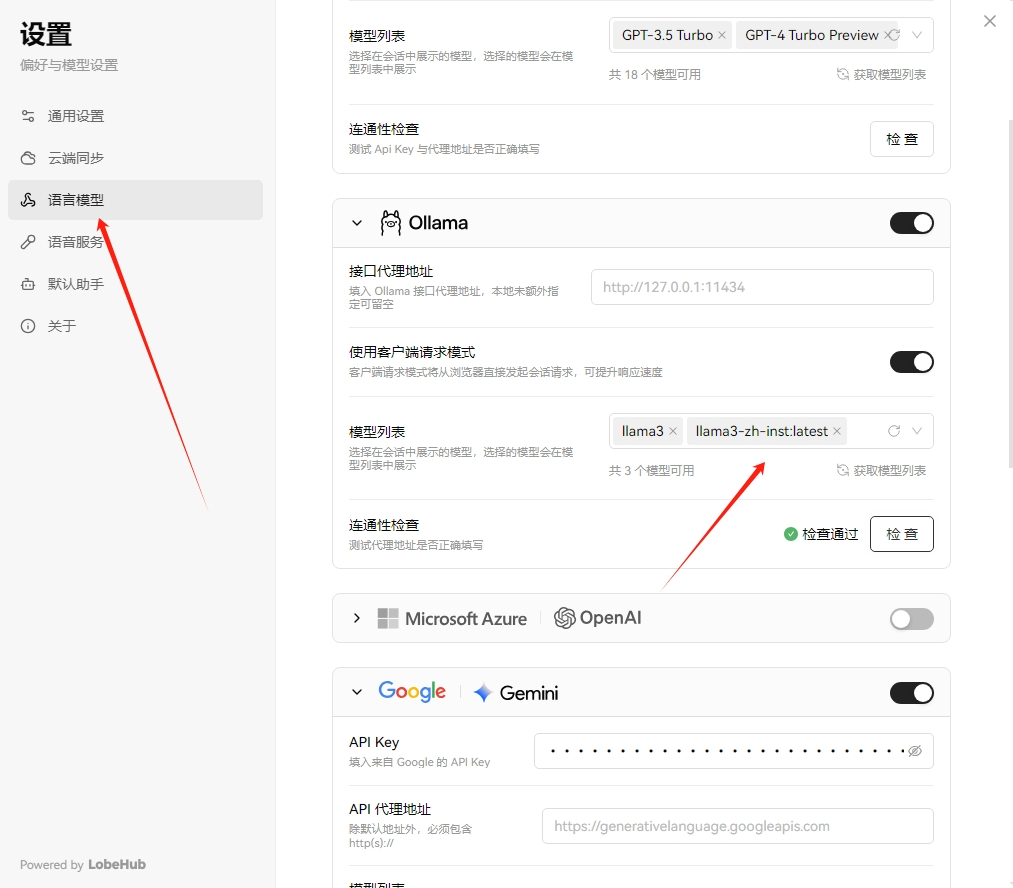

我们运行 Ollama 后, 打开 Lobechat 网站注册,然后打开会话设置。

网址:

https://chat.lobehub.com/welcom

- 1

- 2

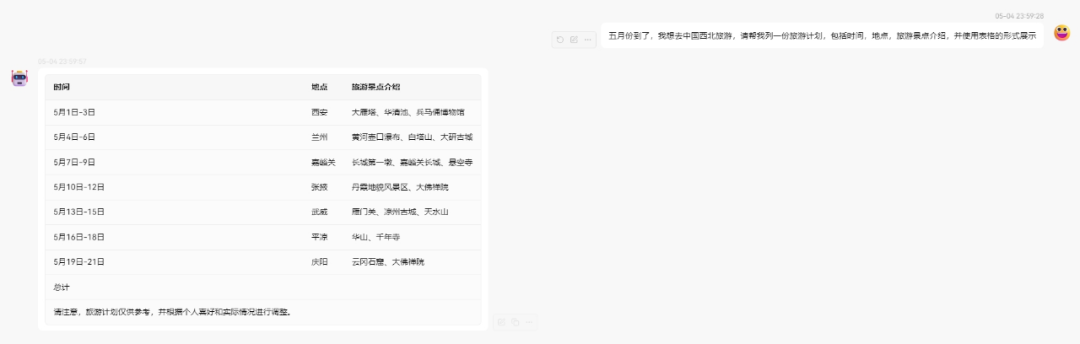

配置好我们的对话机器人后就可以使用了。测试:

零基础如何学习大模型 AI

领取方式在文末

为什么要学习大模型?

学习大模型课程的重要性在于它能够极大地促进个人在人工智能领域的专业发展。大模型技术,如自然语言处理和图像识别,正在推动着人工智能的新发展阶段。通过学习大模型课程,可以掌握设计和实现基于大模型的应用系统所需的基本原理和技术,从而提升自己在数据处理、分析和决策制定方面的能力。此外,大模型技术在多个行业中的应用日益增加,掌握这一技术将有助于提高就业竞争力,并为未来的创新创业提供坚实的基础。

大模型实际应用案例分享

①智能客服:某科技公司员工在学习了大模型课程后,成功开发了一套基于自然语言处理的大模型智能客服系统。该系统不仅提高了客户服务效率,还显著降低了人工成本。

②医疗影像分析:一位医学研究人员通过学习大模型课程,掌握了深度学习技术在医疗影像分析中的应用。他开发的算法能够准确识别肿瘤等病变,为医生提供了有力的诊断辅助。

③金融风险管理:一位金融分析师利用大模型课程中学到的知识,开发了一套信用评分模型。该模型帮助银行更准确地评估贷款申请者的信用风险,降低了不良贷款率。

④智能推荐系统:一位电商平台的工程师在学习大模型课程后,优化了平台的商品推荐算法。新算法提高了用户满意度和购买转化率,为公司带来了显著的增长。

…

这些案例表明,学习大模型课程不仅能够提升个人技能,还能为企业带来实际效益,推动行业创新发展。

学习资料领取

如果你对大模型感兴趣,可以看看我整合并且整理成了一份AI大模型资料包,需要的小伙伴文末免费领取哦,无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

如果二维码失效,可以点击下方链接,一样的哦

【CSDN大礼包】最新AI大模型资源包,这里全都有!无偿分享!!!

本文内容由网友自发贡献,转载请注明出处:【wpsshop博客】

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。