- 1深入解析yolov5,为什么算法都是基于yolov5做改进的?(一)_yolov5s和yolov5x差别是什么

- 2【算法】常用的排序算法简介:冒泡、选择、插入、归并、快速_冒泡排序、选择排序、插入排序、快速排序区别

- 3Maven下载依赖踩坑:Could not transfer artifact org.springframework.bootspring-boot-starter-parent

- 4双向SSM: Vision Mamba Encoder_vision mamba代码

- 5Linux:终端输出保存为txt文件并保持终端输出_linux zhongduan baocun txt

- 62023年湖北工程师职称评审条件,伴德诚

- 7终端安全管理防护的措施之一_有效防止用户非授权登录用户终端保证终端系统及数据安全

- 8认识python教案_python课程教案

- 9深入理解人工智能(Artificial Intelligence,AI)_传统软件与人工智能区别

- 10麦肯锡七步成诗法

Bert实战:使用Bert实现文本分类。,做了三年Python_bert文本实战

赞

踩

parser.add_argument(“–model_type”, default=‘bert’, type=str, required=False,

help="Model type selected in the list: " + ", ".join(MODEL_CLASSES.keys()))

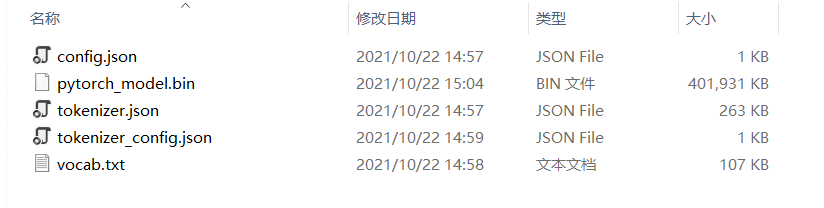

model_name_or_path:预训练模型的存放路径,设置为‘chinese_wwm_pytorch’。

parser.add_argument(“–model_name_or_path”, default=‘chinese_wwm_pytorch’, type=str, required=False,

help="Path to pre-trained model or shortcut name selected in the list: " + ", ".join(

ALL_MODELS))

这个文件下面的文件详见下图:

task_name:任务名称。我写的cnews

parser.add_argument(“–task_name”, default=‘cnews’, type=str, required=False,

help="The name of the task to train selected in the list: " + ", ".join(processors.keys()))

do_train:是否训练。需要训练则设置为true。

parser.add_argument(“–do_train”, default=True,action=‘store_true’,

help=“Whether to run training.”)

do_eval:是否验证,如果设置为true,则将outs的模型一一验证。和do_train可以同时配置为true,这样训练完成后就开始验证。

parser.add_argument(“–do_eval”,default=True, action=‘store_true’,

help=“Whether to run eval on the dev set.”)

evaluate_during_training:是否在训练期间验证。默认没有配置。如果需要配置,则将其设置为true。

parser.add_argument(“–evaluate_during_training”, action=‘store_true’,

help=“Rul evaluation during training at each logging step.”)

do_lower_case:是否转小写。使用uncased模型时需要设置。

parser.add_argument(“–do_lower_case”,action=‘store_true’,

help=“Set this flag if you are using an uncased model.”)

per_gpu_train_batch_size和per_gpu_eval_batch_size:batch_size大小,根据显卡合理设置。

parser.add_argument(“–per_gpu_train_batch_size”, default=4, type=int,

help=“Batch size per GPU/CPU for training.”)

parser.add_argument(“–per_gpu_eval_batch_size”, default=4, type=int,

help=“Batch size per GPU/CPU for evaluation.”)

learning_rate:学习率,默认设置即可。

parser.add_argument(“–learning_rate”, default=2e-5, type=float,

help=“The initial learning rate for Adam.”)

parser.add_argument(“–weight_decay”, default=0.0, type=float,

num_train_epochs:epochs大小。

parser.add_argument(“–num_train_epochs”, default=50.0, type=float,

help=“Total number of training epochs to perform.”)

save_steps:迭代多少次保存一次模型。

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Python开发知识点,真正体系化!

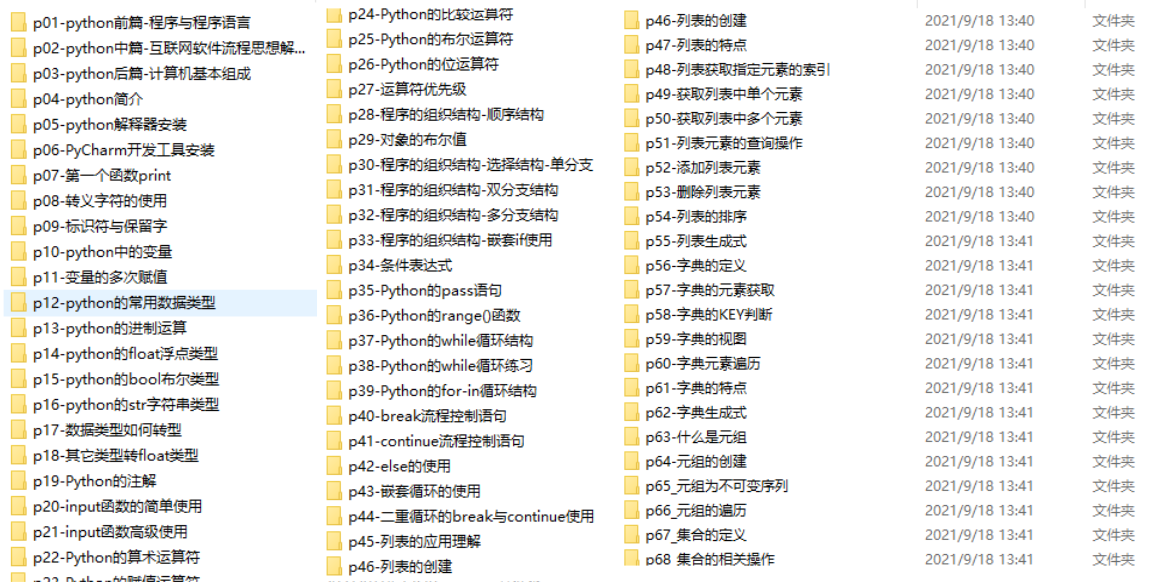

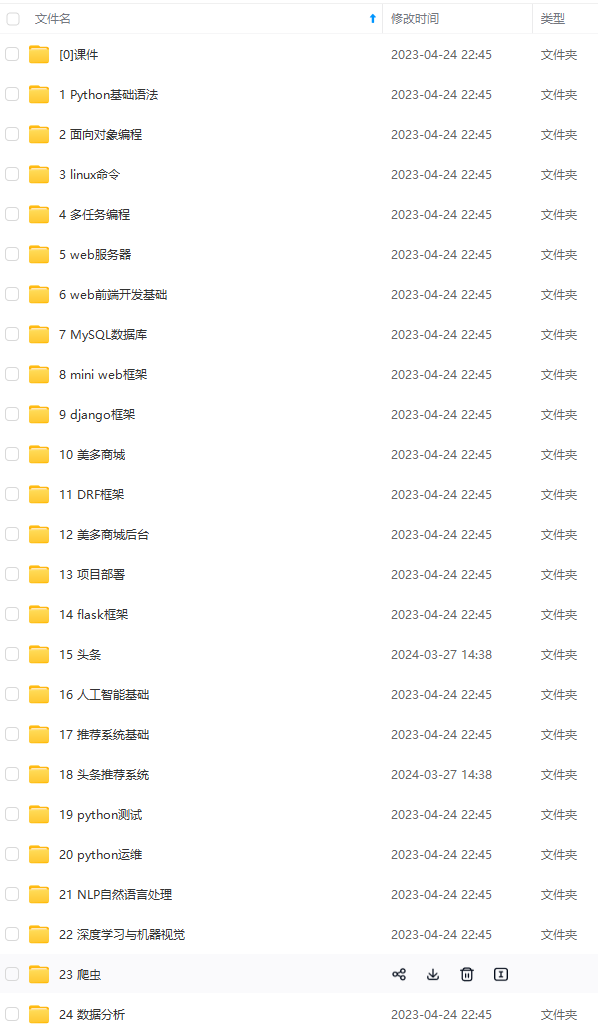

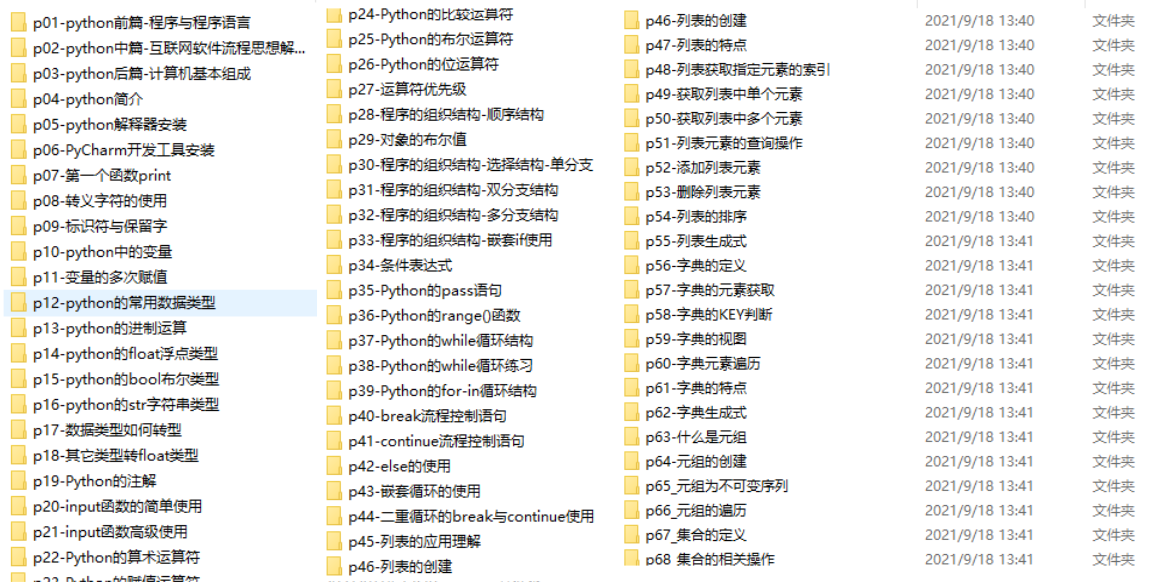

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip1024c (备注Python)

现在能在网上找到很多很多的学习资源,有免费的也有收费的,当我拿到1套比较全的学习资源之前,我并没着急去看第1节,我而是去审视这套资源是否值得学习,有时候也会去问一些学长的意见,如果可以之后,我会对这套学习资源做1个学习计划,我的学习计划主要包括规划图和学习进度表。

分享给大家这份我薅到的免费视频资料,质量还不错,大家可以跟着学习

急去看第1节,我而是去审视这套资源是否值得学习,有时候也会去问一些学长的意见,如果可以之后,我会对这套学习资源做1个学习计划,我的学习计划主要包括规划图和学习进度表。

分享给大家这份我薅到的免费视频资料,质量还不错,大家可以跟着学习