热门标签

热门文章

- 1c语言之贪吃蛇源码,C语言之贪吃蛇经典源码

- 2grafana报错This panel requires Angular (deprecated)

- 3c 字符串数组 复制操作_c语言输入字符串保存到数组中,将奇数位上的字符串复制到另一个数组并输

- 4Android:如何从源码编译OpenCV4Android库_android ndk 编译opencv4.8.1

- 5对Redis的安装及使用,idea上的配置--保姆级教程_idea中 redis

- 6平平科技工作室-其他-QQ消息轰炸机

- 7使用Python完成简单登录系统_python用户登录(输入用户名和密码)

- 8对话AI大模型:Prompts提示指南与应用探索_promptes ai

- 9自从知道了这10个chatGPT网站以后,我就成了同学们眼中的AI大神,关键免费还好用_海螺ai和chatgpt哪个好

- 10Vue3+vite搭建基础架构(5)--- 使用vue-i18n_vite-plugin-vue-i18n

当前位置: article > 正文

语义分割网络论文集锦_swin-unet 会议

作者:繁依Fanyi0 | 2024-05-07 14:36:42

赞

踩

swin-unet 会议

| 年份 | 会议/期刊 | 标题 | 内容 | 架构图 |

| 2015 | CVPR | Fully Convolutional Networks for Semantic Segmentation(FCN) | 主要成就:端到端、像素到像素训练方式下的卷积神经网络超过了现有语义分割方向最先进的技术. 核心思想:搭建了一个全卷积网络,输入任意尺寸的图像,经过有效推理和学习得到相同尺寸的输出. 主要方法:将当前分类网络(ALexNet、VGGNet和GoogleNet)改编成全卷积网络,并进行微调;设计了跳跃连接结构,将全局信息和局部信息连接起来,互相补偿. 实验结果:在PASCAL VOC、NYUDv2和SIFT Flow数据集上得到了SOTA结果. | |

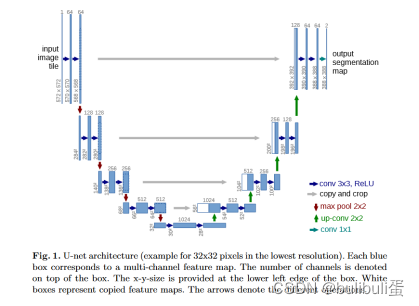

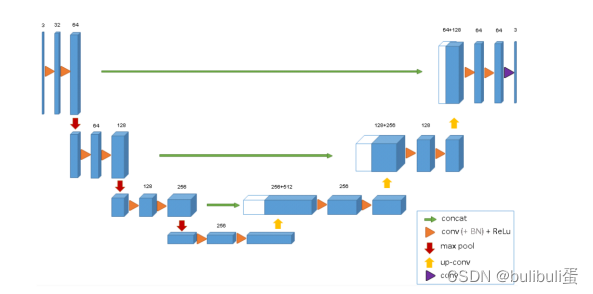

| 2015 | MICCAI | U-Net: Convolutional Networks for Biomedical Image Segmentation |  | |

| 2020 | CVPR | Automated Design of Deep Learning Methods for Biomedical Image Segmentation(nnUNet) | nnU-Net可以自动将其架构适应给定的图像几何,更重要的是,它彻底定义了围绕他们的所有其他步骤。这些步骤包括: 预处理,比如resampling和normalization 训练,比如损失函数,优化器的设置和数据扩充 推断,比如基于图像块的策略,TTA(test-time augmentation)集成和模型集成 后处理,比如增强单连通域 | |

| 2016 | MICCAI | 3D U-Net: Learning Dense Volumetric Segmentation from Sparse Annotation | 1、半自动设置,用户在需要分割的体中标注一些层。网络从这些稀疏标注中学习,并提供一个个密集3D体的分割。 2、全自动设置,我们假设存在一个具有代表性的、稀疏注释的训练集。在这个数据集上训练,网络密集地分割新的立体图像。 |  |

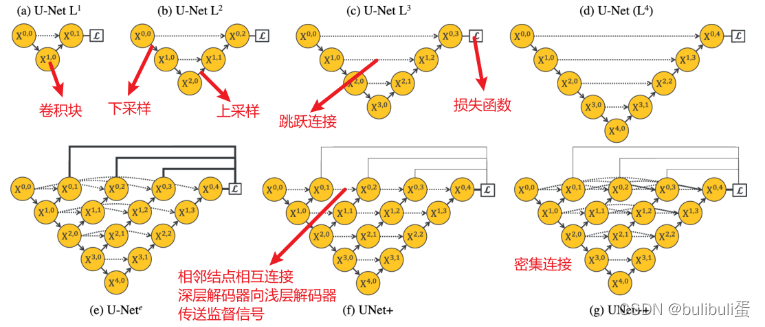

| 2019 | IEEE TMI | UNet++: Redesigning Skip Connections to Exploit Multiscale Features in Image Segmentation | 1、通过不同深度的U-Net的有效集成来缓解未知的网络深度,这些U-Net可以部分共享一个编码器,并且可以通过深度监督(deep supervision)同时进行共同学习; 2、重新设计跳接以在解码器子网络上聚合语义尺度不同的特征,从而产生高度灵活的特征融合方案; 3、设计一种剪枝方案以加快UNet++的推理速度。 |  |

| 2016 | 3DV | V-Net: Fully Convolutional Neural Networks for Volumetric Medical Image Segmentation | 1、网络架构就是3D conv+residual Block版的U-Net,池化用卷积代替,转置卷积上采样 2、 提出了一个新的指标函数,类似IoU、Pa,叫做Dice coefficient。 |  |

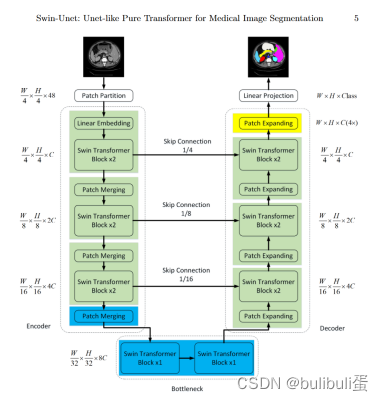

| 2021 | Swin-Unet: Unet-like Pure Transformer for Medical Image Segmentation | ( 1 )基于Swin Transformer模块,我们构建了一个具有跳跃连接的对称编译码器结构。在编码器中,实现了从局部到全局的自注意力;在解码器中,全局特征被上采样到输入分辨率进行相应的像素级分割预测。 ( 2 )在不使用卷积或插值操作的情况下,开发了一个patch扩展层来实现上采样和特征维度的增加。 ( 3 )在实验中发现跳跃连接对于Transformer也是有效的,因此最终构造了一个基于Transformer的U型跳跃编码-解码器结构,命名为Swin - Unet。 |  | |

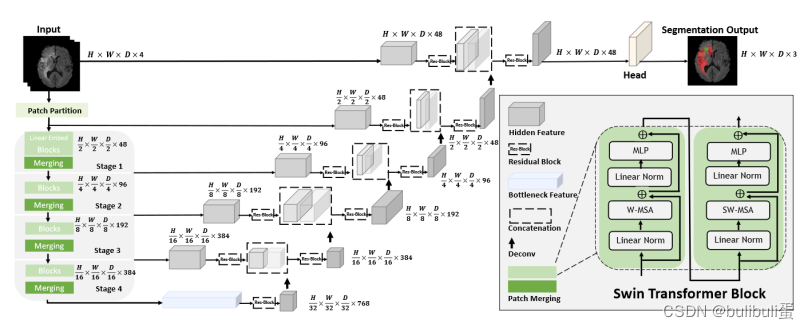

| 2022 | MICCAI | Swin UNETR: Swin Transformers for Semantic Segmentation of Brain Tumors in MRI Images | 和swin unet差不多。 Swin UNETR是一种利用多模态MRI图像的对脑肿瘤进行语义分割的新架构,其具有U型的网络结构,它使用Swin Transformer作为编码器,使用基于CNN的解码器,通过不同分辨率的跳跃连接连接到编码器。 |  |

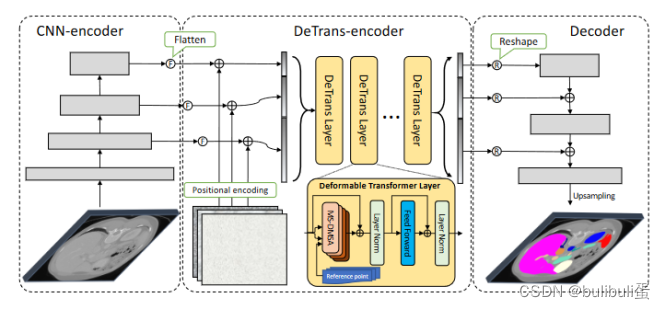

| 2021 | MICCAI | CoTr: Efficiently Bridging CNN and Transformer for 3D Medical Image Segmentation | 1.我们第一个来探索Transformer 的3D医学图像分割,特别是在计算和空间上的效率方法。【transformer优化技巧:可变形注意力】 2.我们引入了可变形自注意力机制来减少Transformer的复杂性,因此使得我们的CoTr可以使用多尺度特征来建模长程依赖。 3 我们的CoTr在3D多器官分割任务上优于基于CNN的、基于Transformer、以及混合模型。 |  |

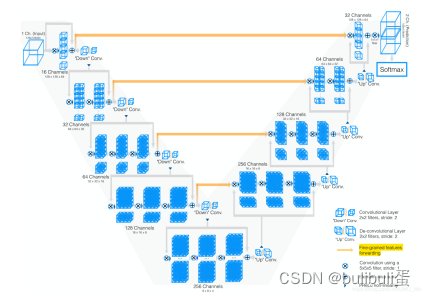

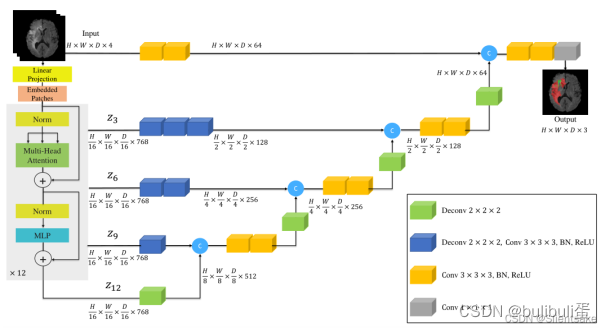

| 2022 | WACV | UNETR: Transformers for 3D Medical Image Segmentation | 利用纯Transformers作为编码器来学习输入量的序列表示并有效地捕获全局多尺度信息。同时也遵循了编码器和解码器的成功的“U型”网络设计,Transformers编码器通过不同分辨率的跳跃连接直接连接到解码器,以计算最终的语义分段输出。 |  |

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/繁依Fanyi0/article/detail/549715

推荐阅读

相关标签