热门标签

热门文章

- 1MySQL分页查询limit数据重复踩坑记_mysql limit重复

- 2YOLO V7源码解析_yolov7代码

- 3【Kafka】消息重复场景及解决

- 4Unity2D游戏开发记录 UI小地图的实现_unity 未探索地图

- 5Photoshop 合并序列帧图片单张多帧图片_ps如何把序列帧拼到一张图上

- 6解决selenium规避被检测到实现自动滑动滑块登录_java-selenium 某些网站的滑块时,滑块成功后被拦截

- 7windows10应用商店加速方法_微软加速路劲

- 8【OpenCV-Python】 直方图均衡化_直方图均衡 遮罩

- 9前端的UI设计与交互之设计原则篇

- 10ExtJs 入门教程十四[数据代理 :DataProxy]_dataproxy_jsp

当前位置: article > 正文

苹果AppleMacOs最新Sonoma系统本地训练和推理GPT-SoVITS模型实践

作者:Cpp五条 | 2024-02-26 03:02:01

赞

踩

苹果AppleMacOs最新Sonoma系统本地训练和推理GPT-SoVITS模型实践

GPT-SoVITS是少有的可以在MacOs系统下训练和推理的TTS项目,虽然在效率上没有办法和N卡设备相提并论,但终归是开发者在MacOs系统构建基于M系列芯片AI生态的第一步。

苹果MacOs系统本地训练和推理GPT-SoVITS模型

环境搭建

首先要确保本地环境已经安装好版本大于6.1的FFMPEG软件:

(base) ➜ ~ ffmpeg -version

ffmpeg version 6.1.1 Copyright (c) 2000-2023 the FFmpeg developers

built with Apple clang version 15.0.0 (clang-1500.1.0.2.5)

configuration: --prefix=/opt/homebrew/Cellar/ffmpeg/6.1.1_3 --enable-shared --enable-pthreads --enable-version3 --cc=clang --host-cflags= --host-ldflags='-Wl,-ld_classic' --enable-ffplay --enable-gnutls --enable-gpl --enable-libaom --enable-libaribb24 --enable-libbluray --enable-libdav1d --enable-libharfbuzz --enable-libjxl --enable-libmp3lame --enable-libopus --enable-librav1e --enable-librist --enable-librubberband --enable-libsnappy --enable-libsrt --enable-libssh --enable-libsvtav1 --enable-libtesseract --enable-libtheora --enable-libvidstab --enable-libvmaf --enable-libvorbis --enable-libvpx --enable-libwebp --enable-libx264 --enable-libx265 --enable-libxml2 --enable-libxvid --enable-lzma --enable-libfontconfig --enable-libfreetype --enable-frei0r --enable-libass --enable-libopencore-amrnb --enable-libopencore-amrwb --enable-libopenjpeg --enable-libopenvino --enable-libspeex --enable-libsoxr --enable-libzmq --enable-libzimg --disable-libjack --disable-indev=jack --enable-videotoolbox --enable-audiotoolbox --enable-neon

libavutil 58. 29.100 / 58. 29.100

libavcodec 60. 31.102 / 60. 31.102

libavformat 60. 16.100 / 60. 16.100

libavdevice 60. 3.100 / 60. 3.100

libavfilter 9. 12.100 / 9. 12.100

libswscale 7. 5.100 / 7. 5.100

libswresample 4. 12.100 / 4. 12.100

libpostproc 57. 3.100 / 57. 3.100

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

如果没有安装,可以先升级HomeBrew,随后通过brew命令来安装FFMPEG:

brew cleanup && brew update

- 1

安装ffmpeg

brew install ffmpeg

- 1

随后需要确保本地已经安装好了conda环境:

(base) ➜ ~ conda info

active environment : base

active env location : /Users/liuyue/anaconda3

shell level : 1

user config file : /Users/liuyue/.condarc

populated config files : /Users/liuyue/.condarc

conda version : 23.7.4

conda-build version : 3.26.1

python version : 3.11.5.final.0

virtual packages : __archspec=1=arm64

__osx=14.3=0

__unix=0=0

base environment : /Users/liuyue/anaconda3 (writable)

conda av data dir : /Users/liuyue/anaconda3/etc/conda

conda av metadata url : None

channel URLs : https://repo.anaconda.com/pkgs/main/osx-arm64

https://repo.anaconda.com/pkgs/main/noarch

https://repo.anaconda.com/pkgs/r/osx-arm64

https://repo.anaconda.com/pkgs/r/noarch

package cache : /Users/liuyue/anaconda3/pkgs

/Users/liuyue/.conda/pkgs

envs directories : /Users/liuyue/anaconda3/envs

/Users/liuyue/.conda/envs

platform : osx-arm64

user-agent : conda/23.7.4 requests/2.31.0 CPython/3.11.5 Darwin/23.3.0 OSX/14.3 aau/0.4.2 s/XQcGHFltC5oP5DK5UVaTDA e/E37crlCLfv4OPFn-Q0QPJw

UID:GID : 502:20

netrc file : None

offline mode : False

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

如果没有安装过conda,推荐去anaconda官网下载安装包:

https://www.anaconda.com

- 1

接着通过conda命令创建并激活基于3.9的Python开发虚拟环境:

conda create -n GPTSoVits python=3.9

conda activate GPTSoVits

- 1

- 2

安装依赖以及Mac版本的Torch

克隆GPT-SoVits项目:

https://github.com/RVC-Boss/GPT-SoVITS.git

- 1

进入项目:

cd GPT-SoVITS

- 1

安装基础依赖:

pip3 install -r requirements.txt

- 1

安装基于Mac的Pytorch:

pip3 install --pre torch torchaudio --index-url https://download.pytorch.org/whl/nightly/cpu

- 1

随后检查一下mps是否可用:

(base) ➜ ~ conda activate GPTSoVits

(GPTSoVits) ➜ ~ python

Python 3.9.18 (main, Sep 11 2023, 08:25:10)

[Clang 14.0.6 ] :: Anaconda, Inc. on darwin

Type "help", "copyright", "credits" or "license" for more information.

>>> import torch

>>> torch.backends.mps.is_available()

True

>>>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

如果没有问题,那么直接在项目目录运行命令进入webui即可:

python3 webui.py

- 1

到底用CPU还是用MPS

在推理环节上,有个细节非常值得玩味,那就是,到底是MPS效率更高,还是直接用CPU效率更高,理论上当然是MPS了,但其实未必,我们可以修改项目中的config.py文件来强行指定api推理设备:

if torch.cuda.is_available():

infer_device = "cuda"

elif torch.backends.mps.is_available():

infer_device = "mps"

else:

infer_device = "cpu"

- 1

- 2

- 3

- 4

- 5

- 6

或者修改inference_webui.py文件来指定页面推理设备:

if torch.cuda.is_available():

device = "cuda"

elif torch.backends.mps.is_available():

device = "mps"

else:

device = "cpu"

- 1

- 2

- 3

- 4

- 5

- 6

基于cpu的推理效率:

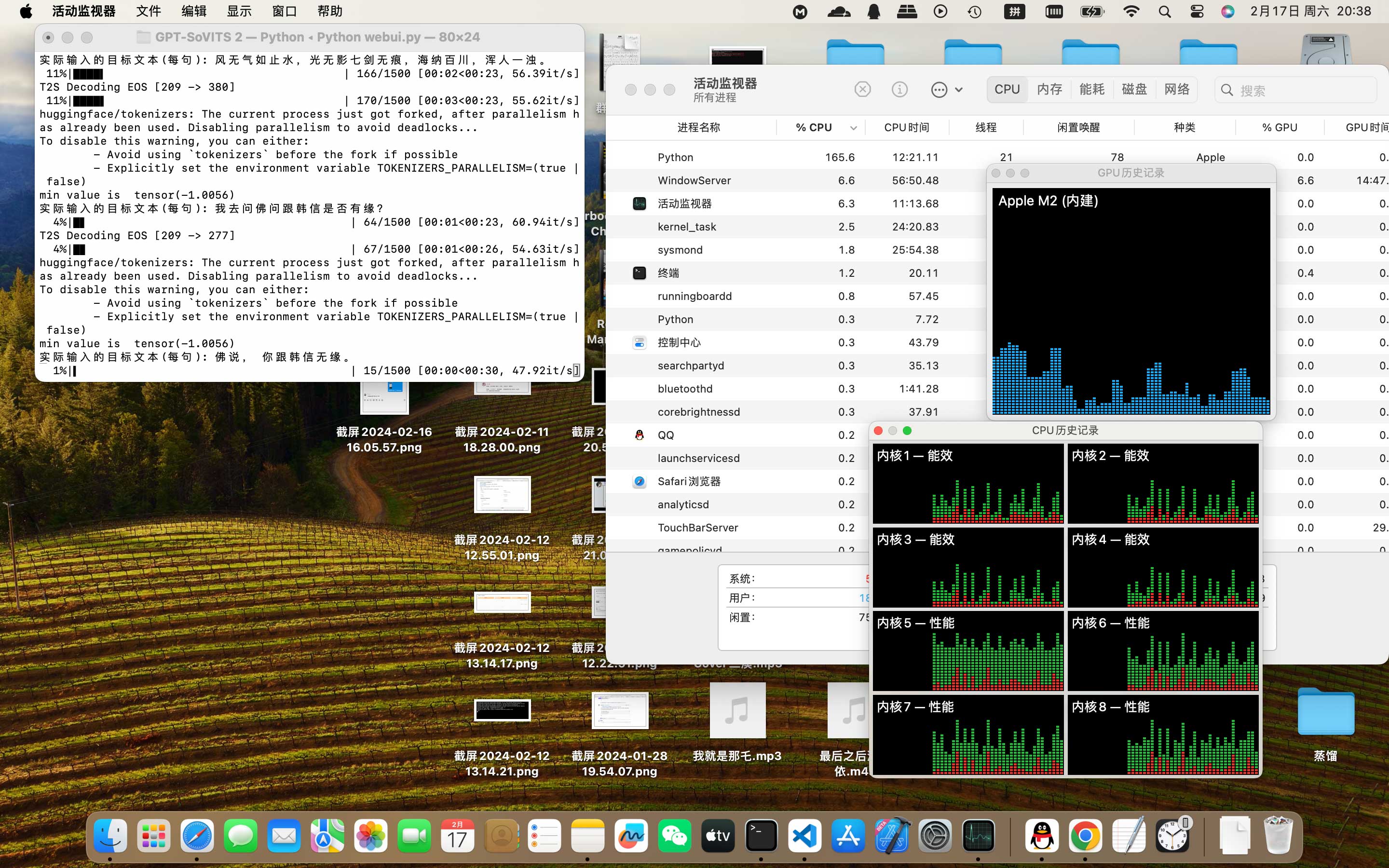

CPU推理时Python全程内存占用3GB,内存曲线全程绿色,推理速度长时间保持55it/s。

作为对比,使用MPS进行推理,GPU推理时,Python进程内存占用持续稳步上升至14GB,推理速度最高30it/s,偶发1-2it/s。

但实际上,在Pytorch官方的帖子中:

https://github.com/pytorch/pytorch/issues/111517

- 1

提到了解决方案,即修改cmakes的编译方式。

修改后推理对比:

cpu推理:

['zh']

19%|███████▍ | 280/1500 [00:12<00:47, 25.55it/s]T2S Decoding EOS [102 -> 382]

19%|███████▍ | 280/1500 [00:12<00:56, 21.54it/s]

gpu推理:

21%|████████▌ | 322/1500 [00:08<00:32, 36.46it/s]T2S Decoding EOS [102 -> 426]

22%|████████▋ | 324/1500 [00:08<00:29, 39.26it/s]

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

但MPS方式确实有内存泄露的现象。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Cpp五条/article/detail/143484

推荐阅读

相关标签