热门标签

热门文章

- 1常用python代码大全-python使用csv模块进行CSV文件操作_csv文件读取的逐行处理

- 2华安泰2014摄影作品征集:盛夏里的青春_盛夏照片的命名

- 3Android屏幕适配 px,dp,dpi及density的关系与深入理解(转载)_android dpi

- 4Android黑白照片上色APP,黑白图片上色工具

- 5【AI从入门到入土系列教程】Ollama教程——进阶篇:【兼容OpenAI的API】高效利用兼容OpenAI的API进行AI项目开发_ollama openai

- 6dify-on-wechat中涉及企业微信几个函数解析_dify集成企业微信

- 7超详细的NLP实战案例解析——使用前馈神经网络进行姓氏分类_用nlp分析身份、

- 8现代IC/LSI工艺PCB封装大全

- 9一文学会Open5GS和UERANSIM安装及使用

- 10暑期大数据人工智能企业项目试岗实训班

当前位置: article > 正文

如何使用Langchain-Chatchat跑本地模型_langchain如何调用本地chatglm模型

作者:一键难忘520 | 2024-07-13 21:26:54

赞

踩

langchain如何调用本地chatglm模型

以Linux系统为例

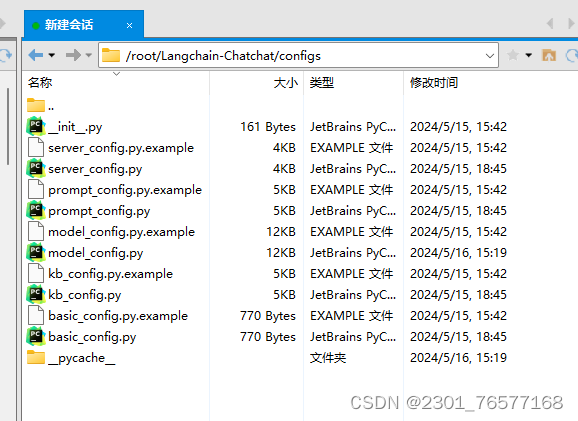

首先cd /root/Langchain-Chatchat/configs (此处需要看你linux本地存储位置)

找到model_config.py文件,右键用记事本打开(使用xftp可视化文件管理)

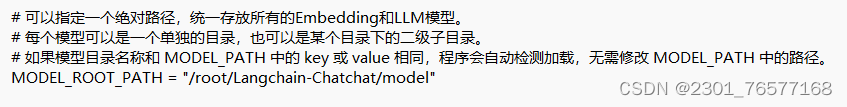

此处更换为模型的绝对路径(也可以不更换,因为最后模型路径我更改为绝对路径了,并不会使用MODEL_ROOT_PATH)

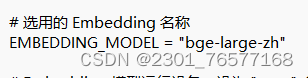

此处更换为Embedding模型名称

![]()

LLM_MODELS更换为你本地的模型名称,此处以chatglm3-6B为例

下滑至

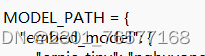

指定embedding模型绝对路径

![]()

指定上面需要用到模型的绝对路径

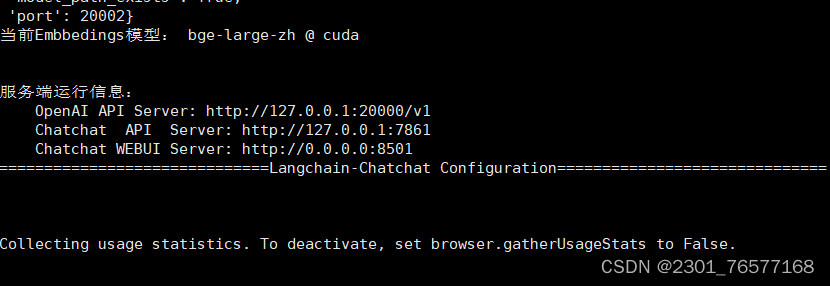

保存后运行 python startup.py -a

成功运行

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/一键难忘520/article/detail/821634

推荐阅读

相关标签