- 1System.InvalidCastException:“无法将类型为“Microsoft.Office.Interop.Excel.ApplicationClass”的 COM 对象强制转换为接口类

- 2HTC vive pro & unity开发者软件/SDK版本注意事项_htc vive unity配置

- 3php毕业设计 基于php+mysql的在线购物商城毕业设计开题报告功能参考_php mysql navicat hbuilder购买系统开题报告

- 4UE蓝图 函数调用(CallFunction)节点和源码

- 5【毕业设计】基于微信小程序体育场地预约系统(源码+LW+部署+讲解)_基于微信小程序体育馆预约系统

- 6mysql 安装问题:由于找不到MSVCP120.dll,无法继续执行代码.重新安装程序可能会解决此问题。_mysql找不到msvcp120

- 7sdkmanager工具安装

- 8redis持久化失败问题(MISCONF Redis is configured to save RDB snapshots, but ......)问题解决

- 9计算机系统:EEPROM详解

- 10虚拟机Ubuntu18.04为Jetson AGX Xavier使用jetpack4.4刷机_agx orin装jetpack4。4

计算机视觉中的Transformer

赞

踩

作者:Cheng He

编译:ronghuaiyang

导读

将Transformer应用到CV任务中现在越来越多了,这里整理了一些相关的进展给大家。

Transformer结构已经在许多自然语言处理任务中取得了最先进的成果。Transformer 模型的一个主要的突破可能是今年年中发布的GPT-3,被授予NeurIPS2020“最佳论文“。

在计算机视觉领域,CNN自2012年以来已经成为视觉任务的主导模型。随着出现了越来越高效的结构,计算机视觉和自然语言处理越来越收敛到一起,使用Transformer来完成视觉任务成为了一个新的研究方向,以降低结构的复杂性,探索可扩展性和训练效率。

以下是几个在相关工作中比较知名的项目:

DETR(End-to-End Object Detection with Transformers),使用Transformers进行物体检测和分割。

Vision Transformer (AN IMAGE IS WORTH 16X16 WORDS: Transformer FOR IMAGE RECOGNITION AT SCALE),使用Transformer 进行图像分类。

Image GPT(Generative Pretraining from Pixels),使用Transformer进行像素级图像补全,就像其他GPT文本补全一样。

End-to-end Lane Shape Prediction with Transformers,在自动驾驶中使用Transformer进行车道标记检测

结构

总的来说,在CV中采用Transformer的相关工作中主要有两种模型架构。一种是纯Transformer结构,另一种是将CNNs/主干网与Transformer相结合的混合结构。

纯Transformer

混合型:(CNNs+ Transformer)

Vision Transformer是基于完整的自注意力的Transformer结构没有使用CNN,而DETR是使用混合模型结构的一个例子,它结合了卷积神经网络(CNNs)和Transformer。

一些问题

为什么要在CV中使用Transformer?如何使用

benchmark上的结果是什么样的?

*What are the constraints and challenges of using Transformer in CV?*

哪种结构更高效和灵活?为什么?

你会在ViT、DETR和Image GPT的下面的深入研究中找到答案。

Vision Transformer

Vision Transformer(ViT)将纯Transformer架构直接应用到一系列图像块上进行分类任务,可以取得优异的结果。它在许多图像分类任务上也优于最先进的卷积网络,同时所需的预训练计算资源大大减少(至少减少了4倍)。

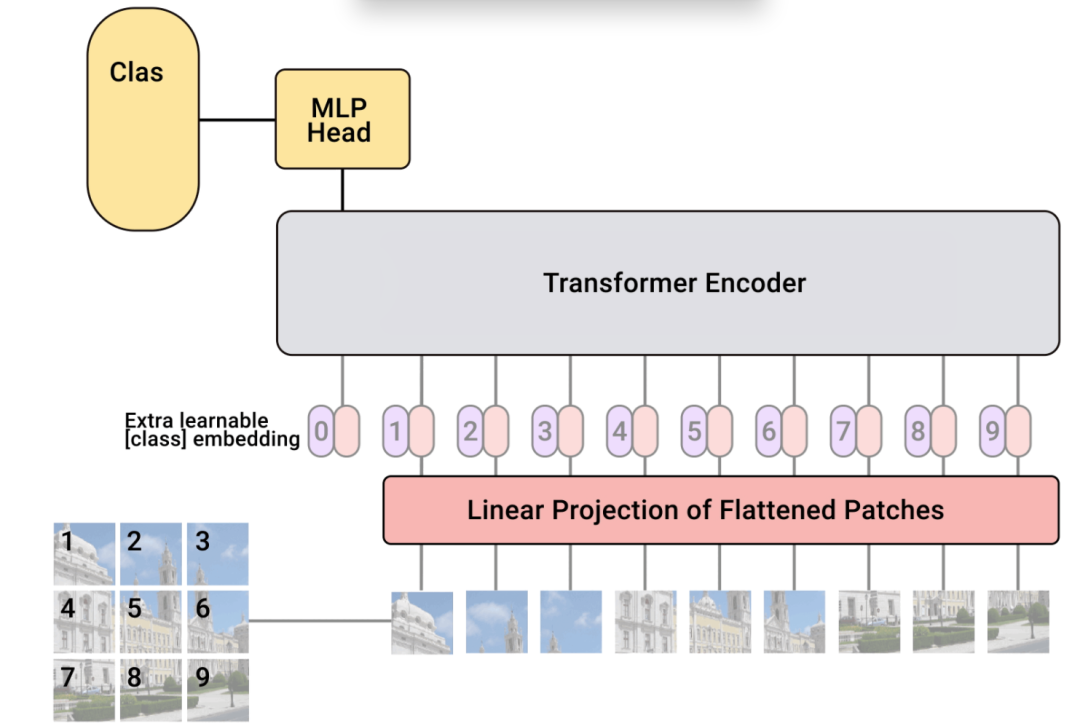

图像序列patches

它们是如何将图像分割成固定大小的小块,然后将这些小块的线性投影连同它们的图像位置一起输入变压器的。然后剩下的步骤就是一个干净的和标准的Transformer编码器和解码器。

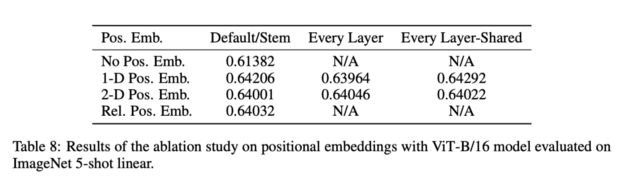

在图像patch的嵌入中加入位置嵌入,通过不同的策略在全局范围内保留空间/位置信息。在本文中,他们尝试了不同的空间信息编码方法,包括无位置信息编码、1D/2D位置嵌入编码和相对位置嵌入编码。

一个有趣的发现是,与一维位置嵌入相比,二维位置嵌入并没有带来显著的性能提升。

数据集

该模型是从多个大型数据集上删除了重复数据预训练得到的,以支持微调(较小数据集)下游任务。

ILSVRC-2012 ImageNet数据集有1k类和130万图像

ImageNet-21k具有21k类和1400万图像

JFT拥有18k类和3.03亿高分辨率图像

模型的变体

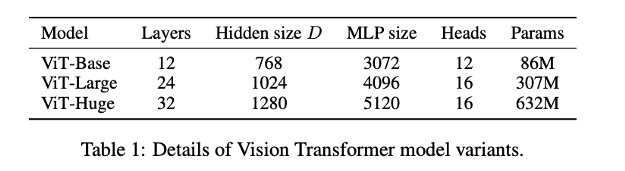

像其他流行的Transformer 模型(GPT、BERT、RoBERTa)一样,ViT(vision transformer)也有不同的模型尺寸(基础型、大型和巨大型)和不同数量的transformer层和heads。例如,ViT-L/16可以被解释为一个大的(24层)ViT模型,具有16×16的输入图像patch大小。

注意,输入的patch尺寸越小,计算模型就越大,这是因为输入的patch数目N = HW/P*P,其中(H,W)为原始图像的分辨率,P为patch图像的分辨率。这意味着14 x 14的patch比16 x 16的图像patch在计算上更昂贵。

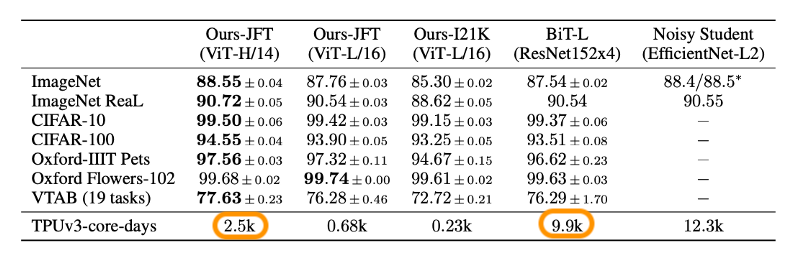

Benchmark结果

以上结果表明,该模型在多个流行的基准数据集上优于已有的SOTA模型。

在JFT-300M数据集上预训练的vision transformer(ViT-H/14, ViT-L/16)优于所有测试数据集上的ResNet模型(ResNet152x4,在相同的JFT-300M数据集上预训练),同时在预训练期间占用的计算资源(TPUv3 core days)大大减少。即使是在ImageNet-21K上预训练的ViT也比基线表现更好。

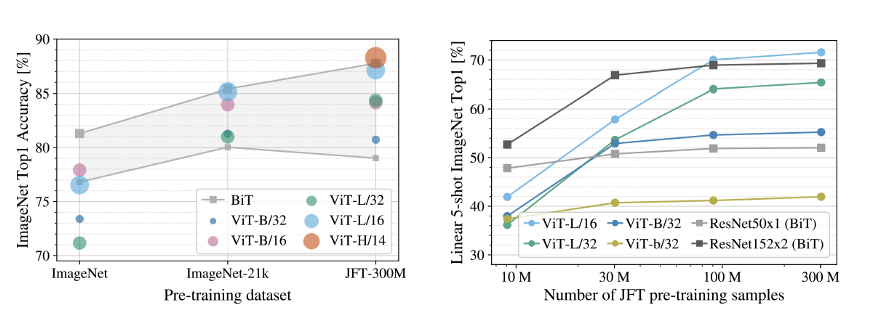

模型性能 vs 数据集大小

上图显示了数据集大小对模型性能的影响。当预训练数据集的大小较小时,ViT的表现并不好,当训练数据充足时,它的表现优于以前的SOTA。

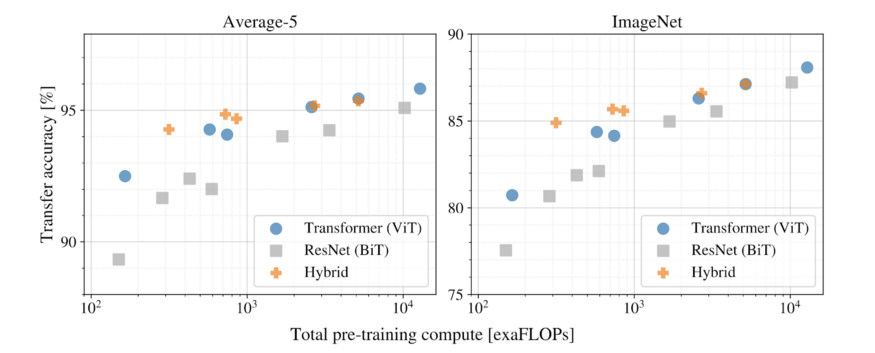

哪种结构更高效?

如一开始所提到的,使用transformer进行计算机视觉的架构设计也有不同,有的用Transformer完全取代CNNs (ViT),有的部分取代,有的将CNNs与transformer结合(DETR)。下面的结果显示了在相同的计算预算下各个模型结构的性能。

以上实验表明:

纯Transformer架构(ViT)在大小和计算规模上都比传统的CNNs (ResNet BiT)更具效率和可扩展性

混合架构(CNNs + Transformer)在较小的模型尺寸下性能优于纯Transformer,当模型尺寸较大时性能非常接近

ViT (vision transformer)的重点

使用Transformer架构(纯或混合)

输入图像由多个patch平铺开来

在多个图像识别基准上击败了SOTA

在大数据集上预训练更便宜

更具可扩展性和计算效率

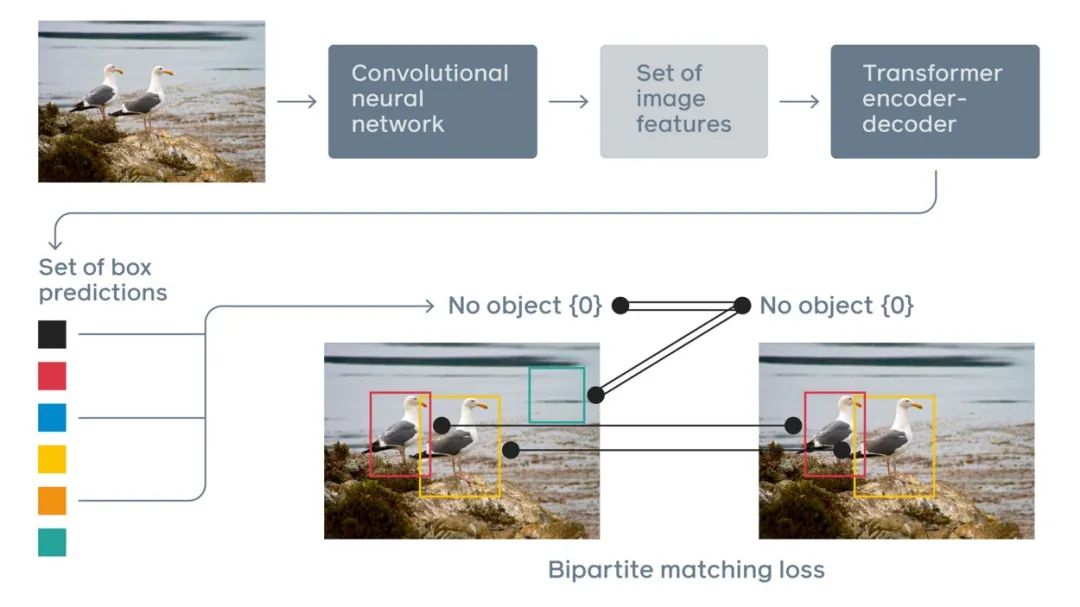

DETR

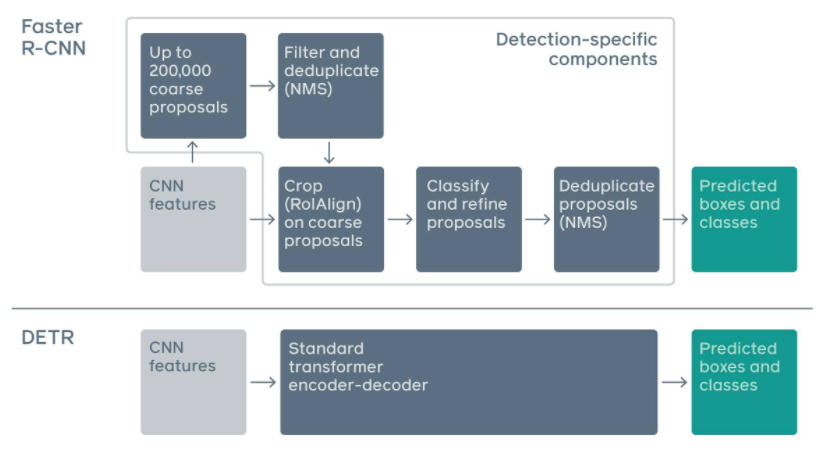

DETR是第一个成功地将Transformer作为pipeline中的主要构建块的目标检测框架。它与以前的SOTA方法(高度优化的Faster R-CNN)的性能匹配,具有更简单和更灵活的pipeline。

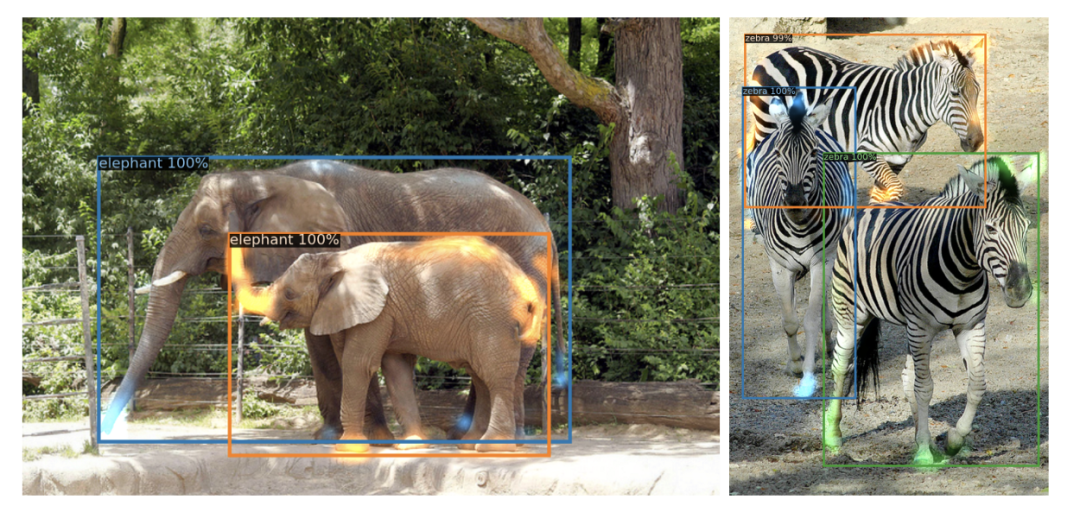

上图为DETR,一种以CNN和Transformer为主要构建块的混合pipeline。以下是流程:

CNN被用来学习图像的二维表示并提取特征

CNN的输出是扁平化的,并辅以位置编码,以馈入标准Transformer的编码器

Transformer的解码器通过输出嵌入到前馈网络(FNN)来预测类别和包围框

更简单的Pipeline

传统的目标检测方法,如Faster R-CNN,有多个步骤进行锚的生成和NMS。DETR放弃了这些手工设计的组件,显著地简化了物体检测pipeline。

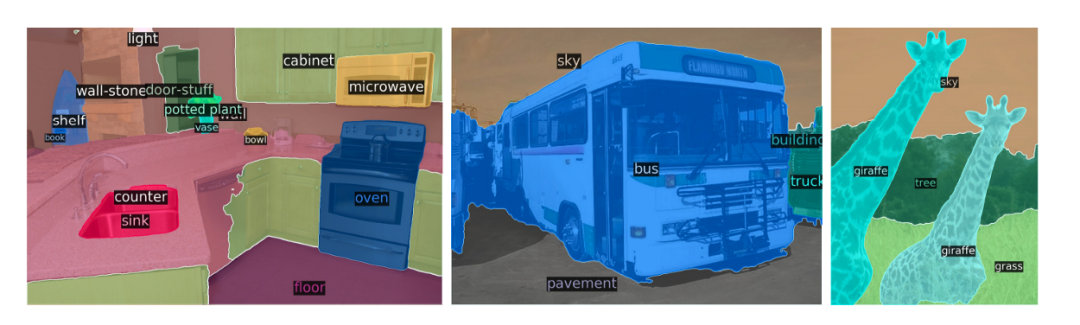

当扩展到全景分割时,惊人的结果

在这篇论文中,他们进一步扩展了DETR的pipeline用于全景分割任务,这是一个最近流行和具有挑战性的像素级识别任务。为了简单解释全景分割的任务,它统一了2个不同的任务,一个是传统的语义分割(为每个像素分配类标签),另一个是实例分割(检测并分割每个对象的实例)。使用一个模型架构来解决两个任务(分类和分割)是非常聪明的想法。

上图显示了全景分割的一个例子。通过DETR的统一pipeline,它超越了非常有竞争力的基线。

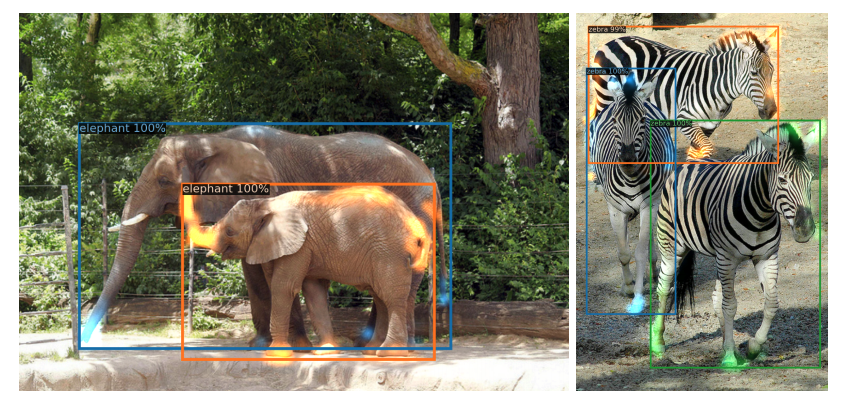

注意力可视化

下图显示了Transformer解码器对预测的注意力。不同物体的注意力分数用不同的颜色表示。

通过观察颜色/注意力,你会惊讶于模型的能力,通过自注意在全局范围内理解图像,解决重叠的包围框的问题。尤其是斑马腿上的橙色,尽管它们与蓝色和绿色局部重叠,但还是可以很好的分类。

DETR的要点

使用Transformer得到更简单和灵活的pipeline

在目标检测任务上可以匹配SOTA

并行的更有效的直接输出最终的预测集

统一的目标检测和分割架构

大目标的检测性能显著提高,但小目标检测性能下降

Image GPT

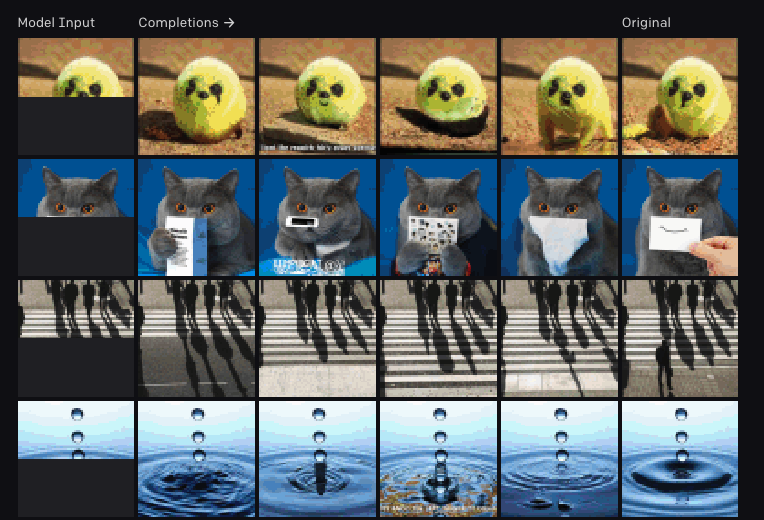

Image GPT是一个在像素序列上用图像补全训练的GPT-2 transformer 模型。就像一般的预训练的语言模型,它被设计用来学习高质量的无监督图像表示。它可以在不知道输入图像二维结构的情况下自回归预测下一个像素。

来自预训练的图像GPT的特征在一些分类基准上取得了最先进的性能,并在ImageNet上接近最先进的无监督精度。

下图显示了由人工提供的半张图像作为输入生成的补全模型,随后是来自模型的创造性补全。

Image GPT的要点:

使用与NLP中的GPT-2相同的transformer架构

无监督学习,无需人工标记

需要更多的计算来生成有竞争力的表示

学习到的特征在低分辨率数据集的分类基准上实现了SOTA性能

总结

Transformer在自然语言处理中的巨大成功已经在计算机视觉领域得到了探索,并成为一个新的研究方向。

Transformer被证明是一个简单和可扩展的框架,用于计算机视觉任务,如图像识别、分类和分割,或仅仅学习全局图像表示。

与传统方法相比,在训练效率上具有显著优势。

在架构上,可以采用纯Transformer的方式使用,也可以与cnn结合使用混合的方式使用。

它也面临着挑战,比如在DETR中检测小目标的性能较低,在Vision Transformer (ViT)中,当预训练数据集较小时,性能也不是很好。

Transformer正在成为学习序列数据(包括文本、图像和时间序列数据)的更通用的框架。

—END—

英文原文:https://towardsdatascience.com/transformer-in-cv-bbdb58bf335e

推荐阅读:

什么是时空序列问题?这类问题主要应用了哪些模型?主要应用在哪些领域?

公众号:AI蜗牛车

保持谦逊、保持自律、保持进步

发送【蜗牛】获取一份《手把手AI项目》(AI蜗牛车著)

发送【1222】获取一份不错的leetcode刷题笔记

发送【AI四大名著】获取四本经典AI电子书