- 1cedit多行文本设置透明背景会重叠_python:电商用户评价文本分析(wordcloud+jieba)...

- 2通过命令查看某个git项目中每个人的提交代码行数_git 查看新增代码行数

- 3Vue 组件的单元测试_vue 单元测试

- 4来聊聊 OpenJDK 和 JVM 虚拟机_temurin jdk

- 5【TTS】EmotiVoice : a Multi-Voice and Prompt-Controlled TTS Engine

- 6解决“python-roslaunch : 依赖: python-roslib 但是它将不会被安装”问题_command 'roslaunch' not found, but can be installe

- 7Spark Join

- 8前端小项目代码:用JQuery实现增删改查的静态页面_jq 静态页面查询显示

- 9svn 锁定_svn锁定操作的作用是什么

- 10uniapp通过renderjs加载3D模型,支持FBX、GLB和GLTF模型,模型可自动适应。_h5 预览glb文件

快手开源 I2V-Adapter,即插即用、轻量级模块让静态图像秒变动态视频

赞

踩

导读

快手开源图像生成视频技术I2V-Adapter。I2V-Adapter是基于Stable Diffusion的文生视频扩散模型的轻量级适配模块,该模块能够在不需要改变现有文本到视频生成(T2V)模型原始结构和预训练参数的情况下,将静态图像转换成动态视频。

一、研究背景

电影,从黑白默片的古朴典雅到特效大片的视觉盛宴,是人类艺术史上不可或缺的一环。然而,其诞生之初,竟源于一场关于马匹奔跑时四蹄离地状态的打赌。1872年,斯坦福与科恩的这场打赌,让摄影师穆布里奇利用24架照相机捕捉了马匹奔跑的连续瞬间,进而通过连续放映这些照片,赋予了静态图像生命,开创了电影艺术的先河。

如今,在计算机视觉领域,静态图像到动态视频(I2V)任务同样面临着巨大的挑战。其核心在于如何从单一的静态图像中提炼出动态的时间维度信息,并确保所生成的视频在真实性和视觉连贯性上达到高度一致。为了实现这一目标,当前的I2V方法大多依赖于复杂的模型架构和庞大的训练数据集。例如Stable Video Diffusion(SVD),通常采用的策略是扩展文本到视频生成(T2V)模型的输入层维度,通过在扩展的维度上输入参考图像来注入图像信息。然而,这种方法需要对模型架构进行修改,导致整个模型需要重新训练,带来了巨大的计算和时间成本。Stable Video Diffusion模型需要训练1.5亿个参数,累计训练迭代次数高达33万次,并消耗了1000万的数据量。更为复杂的是,由于重训练涉及到了控制图像空间排布的空间模块和风格化组件,如ControlNet和DreamBooth等,不再适配该模型,限制了其应用范围和效率。

二、研究方案

基础模型

相较于图像生成,视频生成的独特挑战在于建模视频帧间的时序连贯性。现有大多数方案都基于预训练的文本生成视频(T2I)扩散模型(例如Stable Diffusion 1.5和SDXL)加入时序模块对视频中的时序信息进行建模。例如AnimateDiff,一个为定制化T2V任务而设计的模型,它通过引入与T2I模型解耦的时序模块建模了时序信息并且保留了原始T2I模型的能力,能够结合定制化T2I模型生成流畅的视频。于是,研究者认为,预训练时序模块可以作为通用时序表征,并应用于其他视频生成场景,例如 I2V 生成,且无需任何微调。

I2V-Adapter正式开源

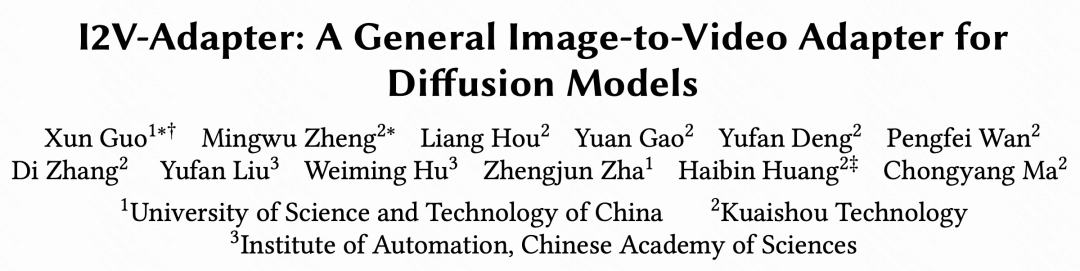

为了突破这一技术瓶颈,快手AI团队在最新研究成果《I2V-Adapter: A General Image-to-Video Adapter for Video Diffusion Models》中,提出了一种适用于基于Stable Diffusion的文生视频扩散模型的轻量级适配模块(即I2V-Adapter),该模块能够在不需要改变现有文本到视频生成(T2V)模型原始结构和预训练参数的情况下,将静态图像转换成动态视频。这一成果不仅展示了I2V技术的巨大潜力,也为该领域的研究提供了新的思路。目前该论文已被SIGGRAPH 2024接受,项目也已开源。

GitHub地址:https://github.com/KwaiVGI/I2V-Adapter

论文地址:https://arxiv.org/abs/2312.16693

I2V任务相对于T2V的一大主要难点在于保持输入图像的ID信息,现有方案为解决这一问题,往往需要改变模型的结构与参数,训练代价大且兼容性较差。

I2V-Adapter提出将输入图像作为视频首帧与噪声并行输入给网络,在模型的空间模块(Spatial Block)中的自注意力层(Self Attention),所有帧都会额外查询一次首帧信息,即key,value特征都来自于不加噪的首帧,输出结果与原始模型的自注意力结构相加。此模块中的输出映射矩阵使用零初始化以实现T2V初始化,并且只训练输出映射矩阵与query映射矩阵以实现高效的训练效率。为了进一步加强模型对输入图像语义信息的理解,研究论文还在交叉注意力层(Cross Attention)中引入了一种Content-Adapter(本文使用的是预训练的IP-Adapter)注入图像的语义特征。

Frame Similarity Prior

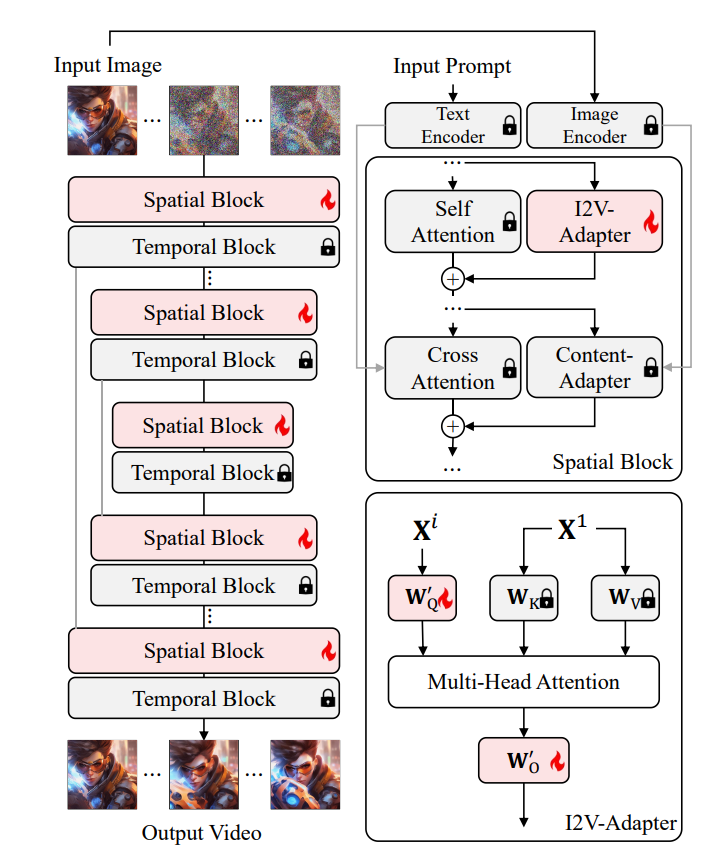

为了进一步增强生成结果的稳定性,I2V-Adapter提出了帧间相似性先验(Frame Similarity Prior),用于在生成视频的稳定性和运动强度之间取得平衡。 其关键假设是,在相对较低的高斯噪声水平上,一段视频的不同帧之间足够接近,如下图所示:

因此,可以把加噪后的输入图像作为后续帧的先验输入。为了排除高频信息的误导,研究者还使用了高斯模糊算子(GaussianBlur)和随机掩码M混合输入x。具体运算由下式给出:

![]()

实际效果

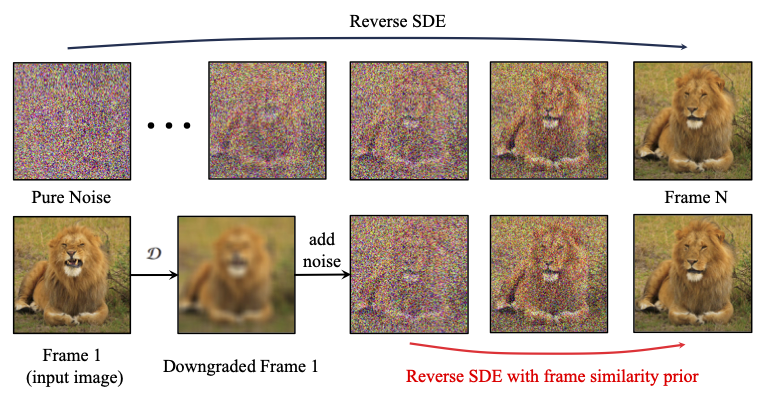

快手AI团队为了全面评估生成视频的质量,设定了四种定量指标,包括DoverVQA(美学评分)、CLIPTemp(首帧一致性)、FlowScore(运动幅度)以及WarppingError(运动误差)。这些指标从不同维度对生成的视频进行了全方位的评价。在最近的研究中,I2V-Adapter模型在各项指标上均展现出了卓越的性能。如表1所示,I2V-Adapter在美学评分上获得了最高分,显示出其生成的视频在视觉美学上具有出色的表现。同时,在首帧一致性方面,I2V-Adapter同样表现出色,远超其他对比方案。值得一提的是,I2V-Adapter生成的视频不仅运动幅度最大,而且运动误差相对较低。这意味着该模型在生成高度动态视频的同时,还能精准地保持时序运动的准确性。

Image Animation(左为输入,右为输出):

w/ Personalized T2Is(左为输入,右为输出):

w/ ControlNet(左为输入,右为输出):

三、业务应用

I2V-Adapter展现了其卓越的多功能性,不仅适用于广泛的I2V任务场景,还能与定制化的T2I模型结合,实现独具特色的风格化I2V任务。更值得一提是,它还能与ControlNet兼容,为用户带来高度可控的I2V体验。

|

|

|

|

| I2V-Adapter | w/ Personalized T2I | w/ ControlNet |

快手与联发科技深化合作,共同推进视频生成技术的革新

视频生成技术如今已不仅仅局限于App应用层面,它在端侧同样取得了令人瞩目的成就。近日,快手与全球领先的半导体公司联发科技达成技术合作,共同探索并推进视频生成技术的革新。通过此次合作,快手将其先进的AI模型I2V Adapter与联发科技的Dimensity平台强大的AI计算能力结合,实现将静态照片转化为生动影片。用户只需简单挑选照片,平台便能智能识别照片中的人物和场景,通过深度分析精准捕捉关键帧,并据此生成自然流畅、栩栩如生的视频效果。

此外,该平台还支持个性化定制,提供了丰富多样的动画风格、精选的背景音乐和个性化的文字添加功能,让用户能够自由发挥创意,打造出独一无二的影片作品。无论是记录生活点滴,还是展现个人风采,这一平台都能满足用户的多样化需求,让视频生成变得更加简单、有趣和个性化。

四、展望未来

I2V-Adapter以其独特的即插即用特性,为图像到视频生成任务带来了革命性的轻量级扩散模型模块。它巧妙地保留了原始文生视频模型的结构与参数不变,仅通过引入额外设计的注意力机制,使得生成的视频帧能够与用户输入的图像视频首帧交互,从而产生时序连贯且与首帧一致的视频。令人瞩目的是,通过定量实验验证,I2V-Adapter在仅训练1%的参数量和使用18%的数据量的情况下,便达到了与SVD相媲美的图像到视频生成能力。此外,其灵活的解耦设计赋予了该方案出色的兼容性,使得DreamBooth、Lora与ControlNet等模块能够无缝集成,为用户提供高度定制化和可控的图像到视频生成体验。