热门标签

热门文章

- 1SQL必须懂的高级查询_sql高级查询

- 2matlab-1-函数图像的绘制

- 3Python及Pycharm专业版下载安装教程(Python 3.11版)附JetBrains学生认证教程_python专业版下载教程

- 4粉笔公考——申论的逻辑_申论文章的逻辑粉笔

- 5AI大模型探索之路-应用篇9:Langchain框架LangSmith模块-AI模型监控神器_tavily api key

- 6什么是Eureka?

- 7恶意代码攻击实验(冰河木马和广外男孩的使用)

- 8Centos7.9云计算CloudStack4.15手把手安装部署指南 (1)_cloudstack安装部署

- 9第十二届蓝桥杯电子赛 EDA设计 省赛 客观题真题与答案分析_蓝桥杯eda 答案

- 10【目标跟踪 MOT】DeepSORT-利用深度关联度量实现简单的在线实时跟踪_在线跟踪方法

当前位置: article > 正文

Mac M2 本地下载 Xinference_xinference mac

作者:正经夜光杯 | 2024-06-24 11:33:02

赞

踩

xinference mac

想要在Mac M2 上部署一个本地的模型。看到了Xinference 这个工具

一、Xorbits Inference 是什么

Xorbits Inference(Xinference)是一个性能强大且功能全面的分布式推理框架。可用于大语言模型(LLM),语音识别模型,多模态模型等各种模型的推理。通过 Xorbits Inference,你可以轻松地一键部署你自己的模型或内置的前沿开源模型。无论你是研究者,开发者,或是数据科学家,都可以通过 Xorbits Inference 与最前沿的 AI 模型,发掘更多可能。

本地部署参考了这两个文档

部署文档

部署文档

接入 Xinference 部署的本地模型 | 中文 | Dify

二、本地部署

安装命令

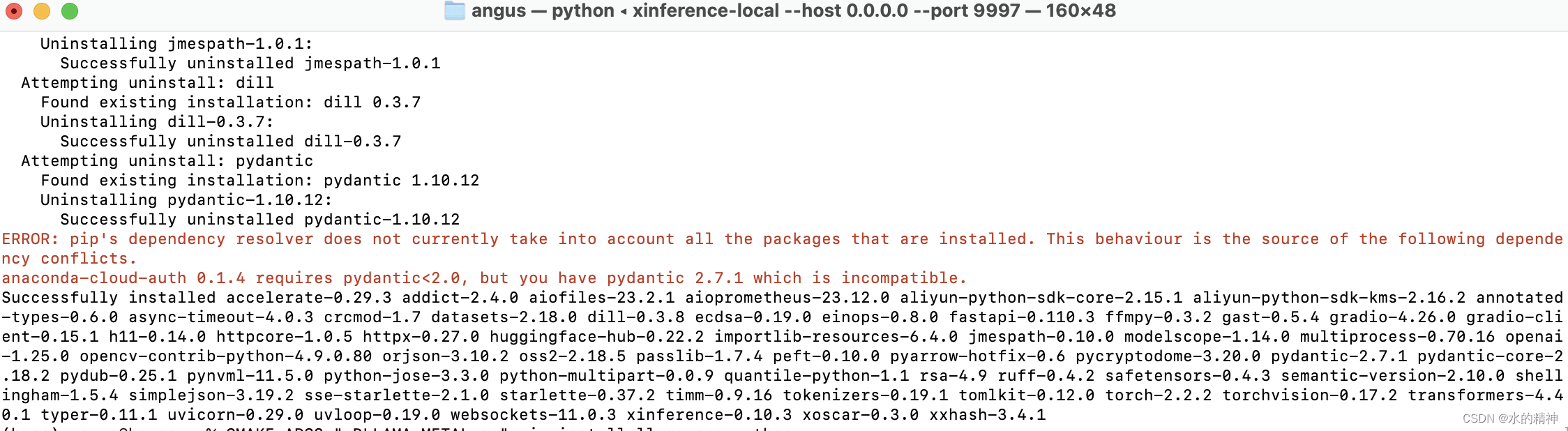

pip install xinference安装成功

硬件加速

CMAKE_ARGS="-DLLAMA_METAL=on" pip install llama-cpp-python安装成功

启动(启动的时候,指定从魔搭上拉取模型。注意这里,国内的话用魔搭拉取会顺畅一些,国外的话可以不指定,取huggingface上去拉去模型)

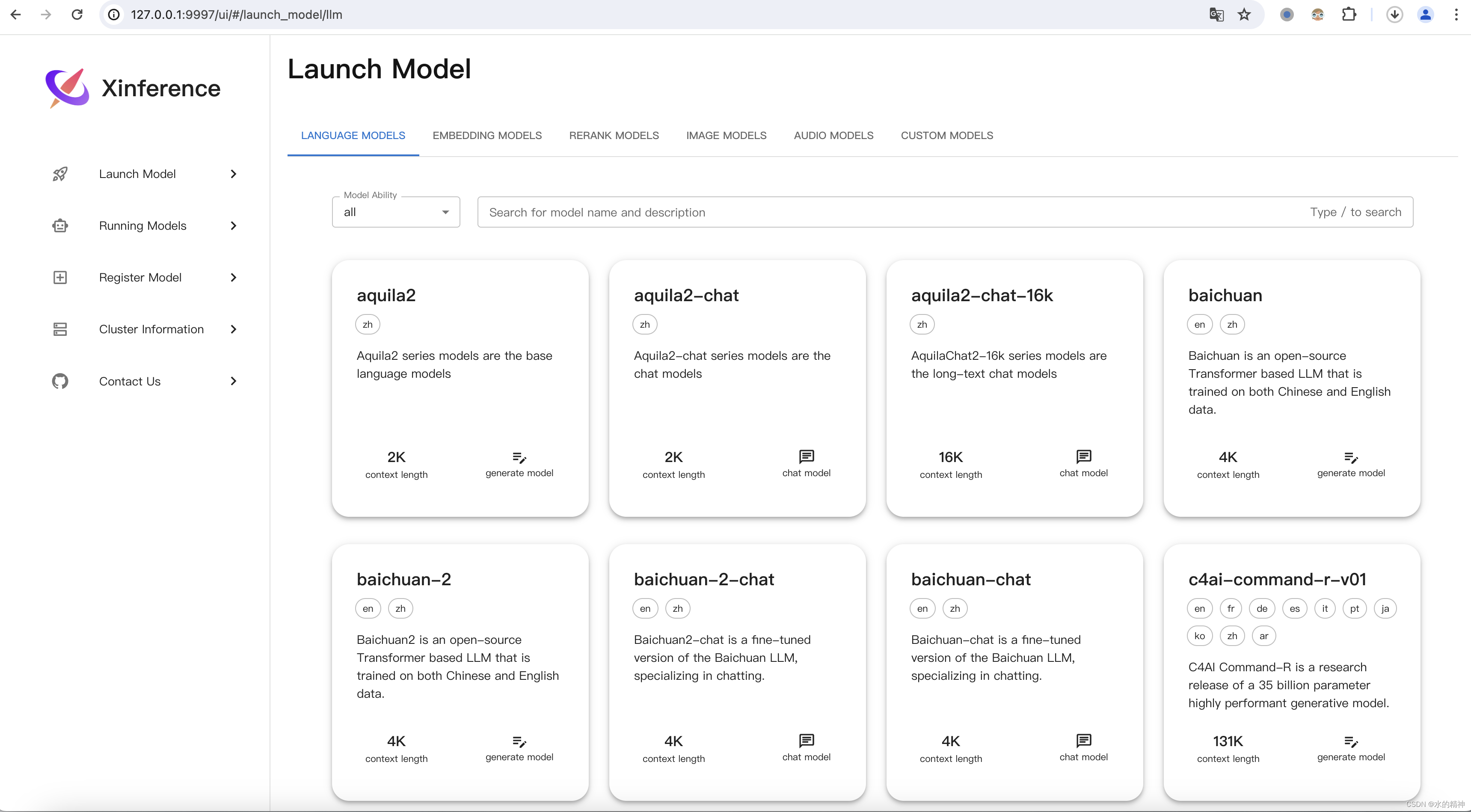

XINFERENCE_MODEL_SRC=modelscope xinference-local --host 0.0.0.0 --port 9997

本地访问

http://0.0.0.0:9997

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/正经夜光杯/article/detail/752660

推荐阅读

相关标签