- 12024年安卓最新Android开发过程中异常的处理方法,海尔面试一般都会问什么_android事件异常

- 2预编码ZF,MMSE,THP准则线性预编码误码率仿真_脏纸编码

- 3小米辟谣裁员传闻:正常年终绩效评估人员调整;马斯克称特斯拉已掌握Sora类似技术;Nginx核心开发者因安全分歧出走| 极客头条...

- 4MySQL的增删查改(CRUD)_掌握基本的crud操作、条件查询、分页查询、自定义sql

- 5回溯算法之N皇后问题的求解_在一个4*4的棋盘上,摆放4个旗子,使得棋盘上每一行dfsjava

- 6Seed-TTS语音编辑有多强?对比实测结果让你惊叹!

- 7【全面实测】Kimi和ChatGPT-4o读Paper实力对

- 8动感英语笔记_阅读是一种教育——全省义务教育阶段英语学科阅读教育综合教研活动(笔记)...

- 9鸿蒙OpenHarmony:【常见编译问题和解决方法】_sync failed. unable to provide the cpp language se

- 10基于Hadoop实现的基于协同过滤的就业推荐系统,Hadoop技术在协同过滤就业推荐系统中的应用及推荐原理解析_推荐系统中的应用:介绍推荐系统的基本原理,并讨论如何使用hadoop处理大规模的用户

谷歌硬刚GPT-4o!60秒视频生成模型虽迟但到,还把上下文窗口卷到了200万

赞

踩

OpenAI出手再次惊艳世界,谷歌果然坐不住了。

GPT-4o掀起的一片“AGI已至”的惊呼声中,刚刚,Google DeepMind首席执行官哈萨比斯亲自携谷歌版《Her》登场:

同样能 会

会 还有

还有 ,不仅能几乎没有延迟地和人类流畅交流,通过摄像头,这个名为Project Astra的AI助手甚至能直接帮忙读代码:

,不仅能几乎没有延迟地和人类流畅交流,通过摄像头,这个名为Project Astra的AI助手甚至能直接帮忙读代码:

谷歌还祭出了自己的硬件优势,带来一波AR和大模型的梦幻联动。

一边撸狗一边玩转大模型已经成为现实(手动狗头)。

这一波操作下来,战果如何尚未可知,网友们反正是兴奋了起来:

而正面硬刚GPT-4o,还只是谷歌铆足了劲,在I/O大会上释出的冰山一角。

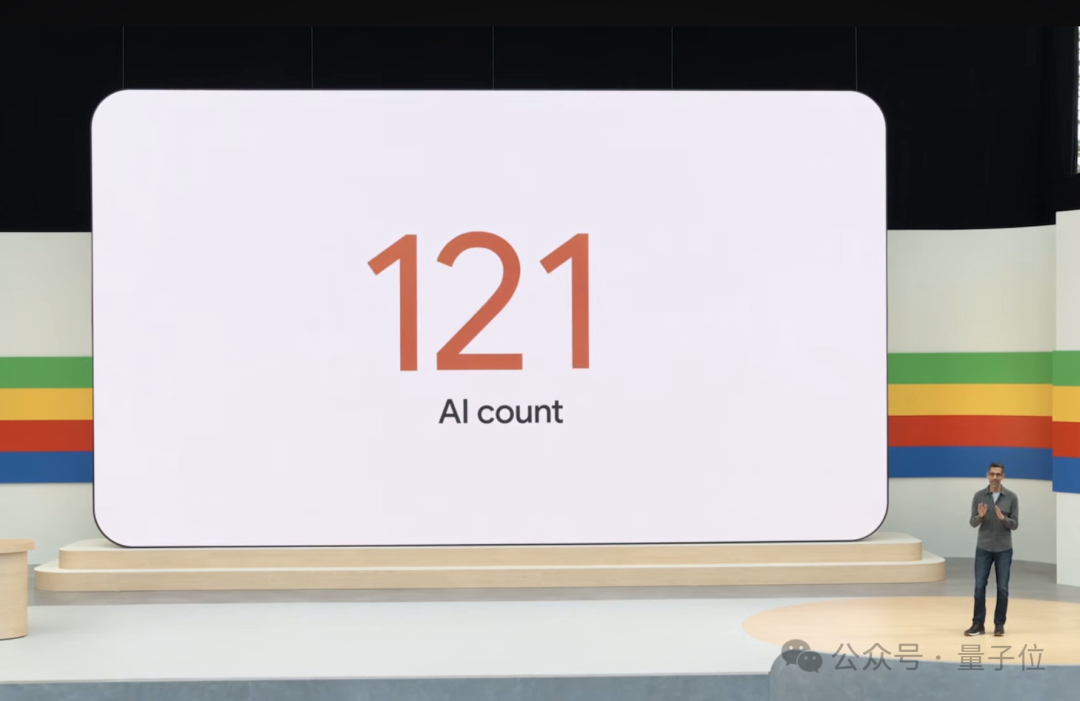

两个小时的主题演讲里,AI被提及了121次,CEO劈柴哥还犹嫌不足。

于是,对标Sora能生成一分钟长视频的视频生成模型Veo来了:

Gemini 1.5 Pro不仅面向所有人开放,上下文窗口还从100万token直接一步迈向200万,一口气能读1500页PDF。

连Android,现在也紧紧跟谷歌大模型Gemini绑定,摇身一变成为以AI为内核的操作系统。

总之,信息量多到爆炸 ,相比之下,OpenAI不到半个小时的发布真的很随性了

,相比之下,OpenAI不到半个小时的发布真的很随性了 。

。

谷歌版《Her》登场

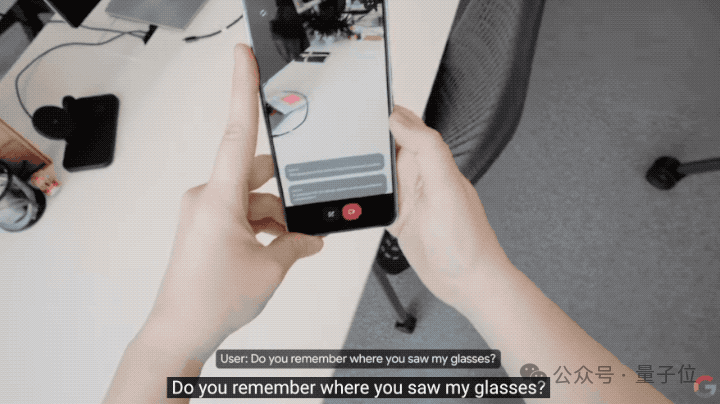

第一时间引发最多讨论的,当然是谷歌版《Her》——Project Astra。

Project Astra基于Gemini系列模型打造,谷歌表示,研究人员们希望这样的智能助手,能真正在人们的日常生活中提供帮助。

有意思的是,OpenAI总裁哥Brockman昨天在场外补充了有关GPT-4o多模态能力的更详细视频,而谷歌这边,哈萨比斯也是第一时间在X上更新了与这样一个智能助手的互动。

看样子,Ta不仅能完成帮忙找眼镜这样的基础工作。

帮忙搞点文艺创作,解答一下专业书上看不懂的内容,也都是信手拈来。

还有Google DeepMind的工作人员干脆和Project Astra一起看起了I/O大会直播:

不少网友都认为,这是谷歌对OpenAI的GPT-4o的正面回应。

不过嘛,网友们也关注到了不少问题,比如,Project Astra的延迟似乎还是比GPT-4o长,谷歌的演示中也没有体现是否能打断智能助手说话。

值得关注的是,Project Astra背后,是Gemini系列模型的进一步升级迭代。

比如,Gemini 1.5 Pro的上下文窗口来到了惊人的200万token。

谷歌还最新推出了Gemini 1.5 Flash这一轻量级模型,并开源了27B的Gemma 2和视觉语言模型PailGemma。

60秒长视频生成

你可能已经默默在心里比较了一番Project Astra和GPT-4o的高下。

但桥豆麻袋,说起来,谷歌被OpenAI突然狙击,可不止这一回。

还记得在春节期间抢尽谷歌风头的Sora吗?

谷歌的回应,虽迟但到——

谷歌最强视频生成模型Veo来了。

Veo可以生成1080p的高质量视频,生成视频的长度也看齐Sora:最长超过1分钟。

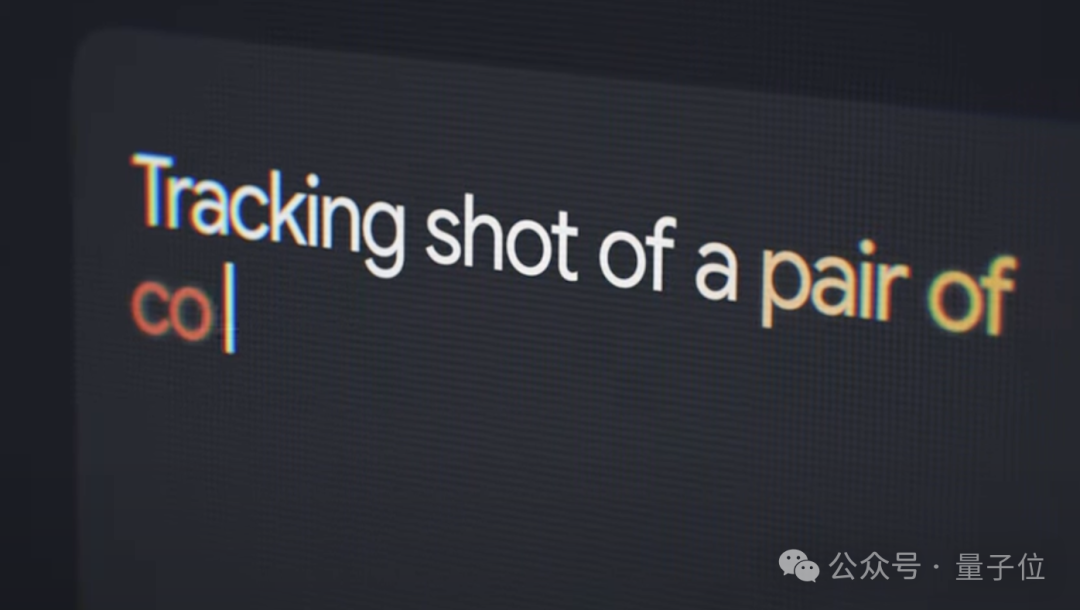

谷歌还强调,Veo生成的画面一致性出色,并且可以hold住各种风格。比如“延时拍摄”和“航拍”这种术语,直接写在提示词里,Veo都能get。

目前,谷歌已经和电影制作者展开了合作,在电影项目中探索Veo的应用。

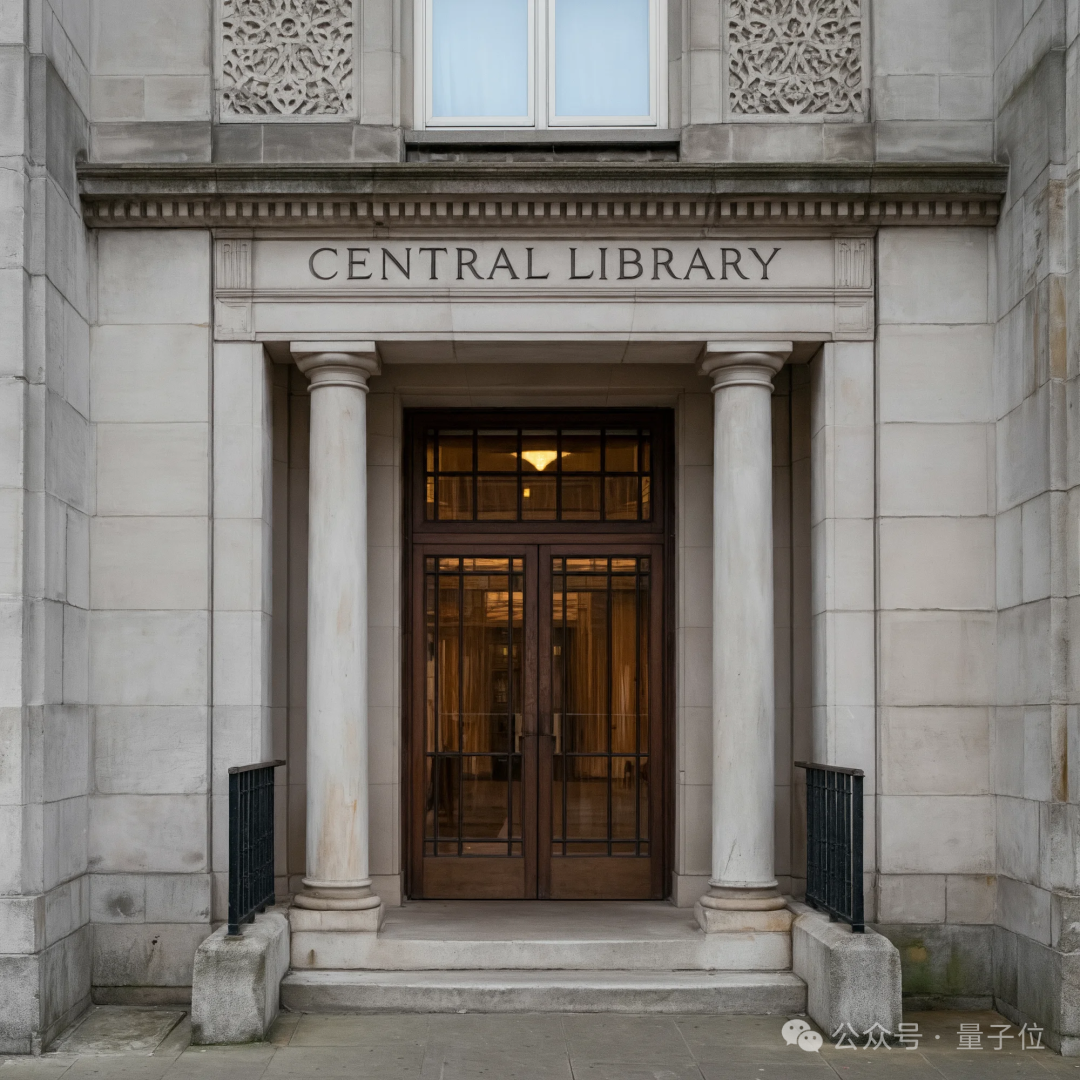

与此同时,谷歌的图片生成模型Imagen也迎来更新,Imagen 3发布。

官方提到,与此前的模型相比,Imagen 3的视觉伪影更少,生成的图像细节拉满,并且在生成文字方面效果也很好。

△提示词:一张庄严的图书馆入口的照片,刻有“中央图书馆”字样

另外,谷歌此次还推出了音乐生成模型Lyria。

Gemini进入全线产品

在这些跟OpenAI叫板的“肌肉”展示之外,谷歌对大模型应用的看重,也在此次I/O大会中尽显。

英伟达科学家Jim Fan就他的I/O观后感中表示:

谷歌做对的一件事是:他们终于开始努力把AI集成到搜索框中。

还不止是搜索,这一次,谷歌可以说是把Gemini塞进了全线产品中,包括谷歌搜索、Android,以及谷歌邮箱、谷歌Photos等。下面我们划划重点。

1、谷歌搜索

基于Gemini,谷歌搜索推出AI概述(AI Overview)新功能,彻底化身AI搜索。

用户在搜索框输入问题,马上就能得到一个AI总结的答案,包括相关链接。

而且是超长问题都能处理的那种,比如:

查找波士顿最好的瑜伽或普拉提工作室,并提供他们的入门优惠详情以及从灯塔山步行所需时间。

AI Overview秒秒钟就会列出五星好评且距离灯塔山近的店,并附带课程标价,连店在地图上的位置都标记了出来:

对于这种复杂问题的搜索,谷歌表示采用了多步推理技术,可以将复杂问题拆解成一个个小问题,然后自动对问题进行排序回答。

多步推理加持下,AI Overview已经脱离了纯粹的搜索——把制定计划一并搬进了搜索引擎里。

比如直接让它为一个团体制定一个为期三天的易于执行的餐饮计划。

AI Overview一键给出了方案,每个方案都可以点击修改,下方还可以一键将食材加入购物车:

还没完,当你没有想法、问的问题比较笼统时,谷歌搜索还会AI自动将搜索结果整理成一个个“群组”,为你提供建议。

比如问:在达拉斯找一个餐厅庆祝周年纪念日。

搜索出的结果会按照音乐餐厅、具有历史魅力的餐厅等一键分组。再往下翻,页面会从餐饮逐渐扩展到电影、酒店、购物等。

此外,谷歌搜索还支持视频搜索了。

演示中,唱片机出故障,只需一边录制视频一边说出疑问,谷歌AI Overview就会立刻分析故障原因,并给出处理建议。

谷歌搜索AI Overview功能将在本周开始在美国推出,后面将陆续推至其他国家。

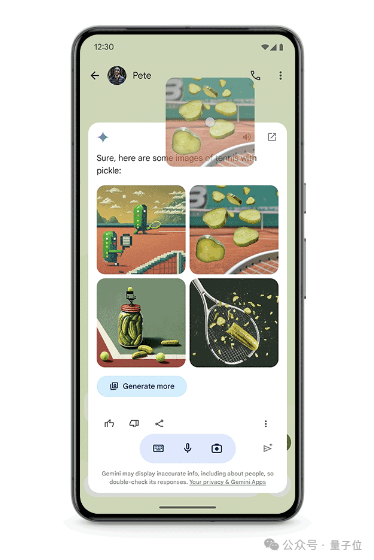

2、Android 15

谷歌把Gemini也带到了安卓系统中。

凭借直接内置的Circle to Search功能,用户使用简单的手势“圈”一下手机上看到的任何内容,就能进行搜索。

比如圈出练习题,就能一键获取答案。

目前这一功能,已在Pixel和三星的部分设备上使用。

此外,还可以在一个应用之上随时调出Gemini助手层,随时使用。你还可以将Gemini生成的图片直接拖到Gmail等应用中,直接询问某个视频中的具体信息,不用滑动翻文档询问某个PDF中的信息……

甚至连电话反诈,都用上Gemini了:听到关键字“把钱转到安全账号”,马上就能给出警报。

总之,官方强调,现在,Gemini在手机上现在不止是一个App,更是安卓体验的基础。

3、谷歌Photos

谷歌Photos基于Gemini也推出了新功能——Ask Photos,可以一键从图库中帮你找到想要的照片和视频。

比如你想知道自己的baby是什么时候学会游泳的,Ask Photos会从你在谷歌Photos中存储的成百上千张照片中查找出含游泳、游泳证书等相关图片,最后总结给出回复:

Ask Photos这一功能将在今年夏天推出。

4、谷歌Workspace

Gemini也接入到了谷歌Workspace提供的一套生产力和协作工具中,包括谷歌邮箱、谷歌Docs、谷歌Calendar等。

这使得在这些工具间进行跨应用工作变得更加容易。

例如在谷歌邮箱中自动分析邮件以及附件,识别整理好收据,然后一键在Drive和Sheets中处理。

5、NotebookLM

谷歌AI笔记应用NotebookLM也大升级。

如下图所示,当你提出一个问题后,背后的Gemini模型就会结合NotebookLM中的笔记内容,进行多模态的语音对话式回答。

也就是说,所有笔记都可以变成交互式教材。

第六代TPU

最后,在硬件部分,谷歌也带来了新消息:

第六代TPU Trillium将在今年向云客户提供。

与TPU v5e,Trillium的峰值计算性能提高4.7倍,HBM和带宽增加了1倍,芯片间互联(ICI)带宽也增加了1倍。另外,Trillium的能效比TPU v5e高出了67%以上。

有关谷歌I/O的更多细节,可以戳:

https://blog.google/technology/developers/google-io-2024-collection/

那么今日份的发布会笔记,就先做到这里了。

你觉得谷歌这波表现如何?

从美股盘后的情况来看,似乎有点emmm……

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

-END-

声明:本文内容由网友自发贡献,转载请注明出处:【wpsshop博客】

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。