热门标签

热门文章

- 1Vue Baidu Map--点标记bm-marker的使用、注意事项

- 2python cocos2dx_VS2017中搭建Cocos2dx开发环境图文详解

- 3VSCode 中,TS 提示 ”无法找到 *.vue 声明文件“ 的解决方案,ts(2307)_无法找到.vue声明文件

- 4sysystemd日志 journalctl日志持久化存储(journal日志、持久化日志)(/etc/systemd/journald.conf)log日志容量上限、无法持久化失败

- 5canvas画布 案例——1、心电图 2、绘制矩形——柱状图 3、挂钟 4、饼状图 5、评分空间——五角星 6、动图

- 6[转载]git 添加源地址和查看源地址_git 查看源地址

- 7深度学习:开启人工智能的未来探索之旅

- 8js之es新特性

- 9Unity编辑器扩展?什么是PropertyDrawer? 自定义脚本变量绘制?_unity propertydrawer dll

- 10文件操作:打开、关闭、读取、定位_c:\\users\\lenovo\\desktop

当前位置: article > 正文

DNN、CNN、RNN、LSTM的区别,最全最详细解答_dnn和cnn

作者:盐析白兔 | 2024-02-19 19:28:56

赞

踩

dnn和cnn

**

DNN、CNN、RNN、LSTM的区别,最全最详细解答

**

神经网络的变种目前有,

如误差反向传播(Back Propagation,BP)神经网路、

概率神经网络、

RNN-循环神经网络

DNN-深度神经网络

CNN-卷积神经网络(-适用于图像识别)、

LSTM-时间递归神经网络(-适用于语音识别)等。

但最简单且原汁原味的神经网络则是

多层感知器(Muti-Layer Perception ,MLP)。

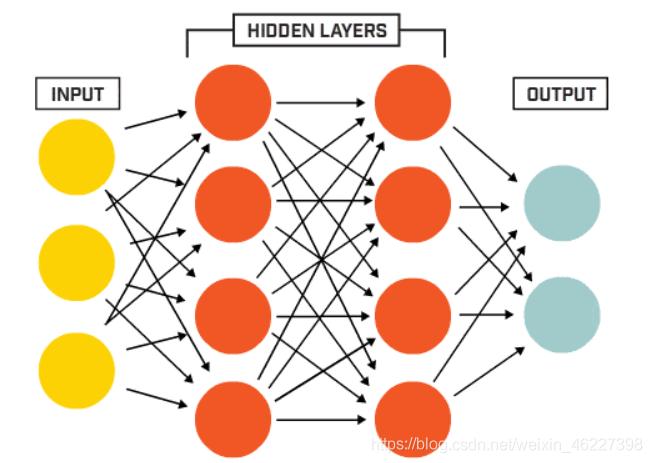

MLP神经网络的结构和原理

最典型的MLP包括包括三层:输入层、隐层和输出层,MLP神经网络不同层之间是全连接的(全连接的意思就是:上一层的任何一个神经元与下一层的所有神经元都有连接)。

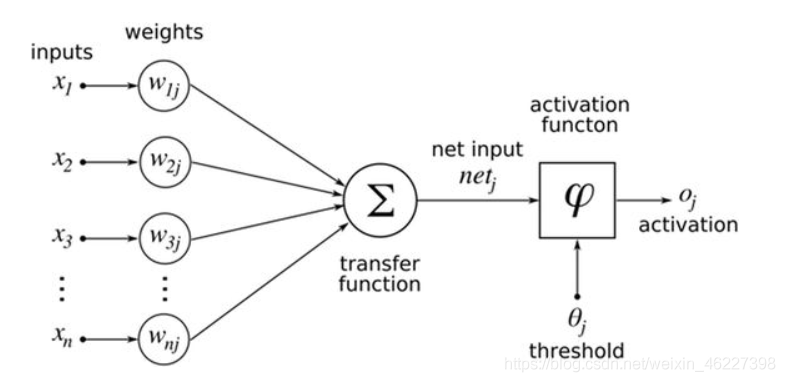

由此可知,神经网络主要有三个基本要素:权重、偏置和激活函数

权重:神经元之间的连接强度由权重表示,权重的大小表示可能性的大小

偏置:偏置的设置是为了正确分类样本,是模型中一个重要的参数,即保证通过输入算出的输出值不能随便激活。

激活函数:起非线性映射的作用,其可将神经元的输出幅度限制在一定范围内,一般限制在(-1~1)或(0~1)之间。最常用的激活函数是Sigmoid函数,其可将(-∞,+∞)的数映射到(0~1)的范围内。

MLP的最经典例子就是

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/盐析白兔/article/detail/116468

推荐阅读

相关标签